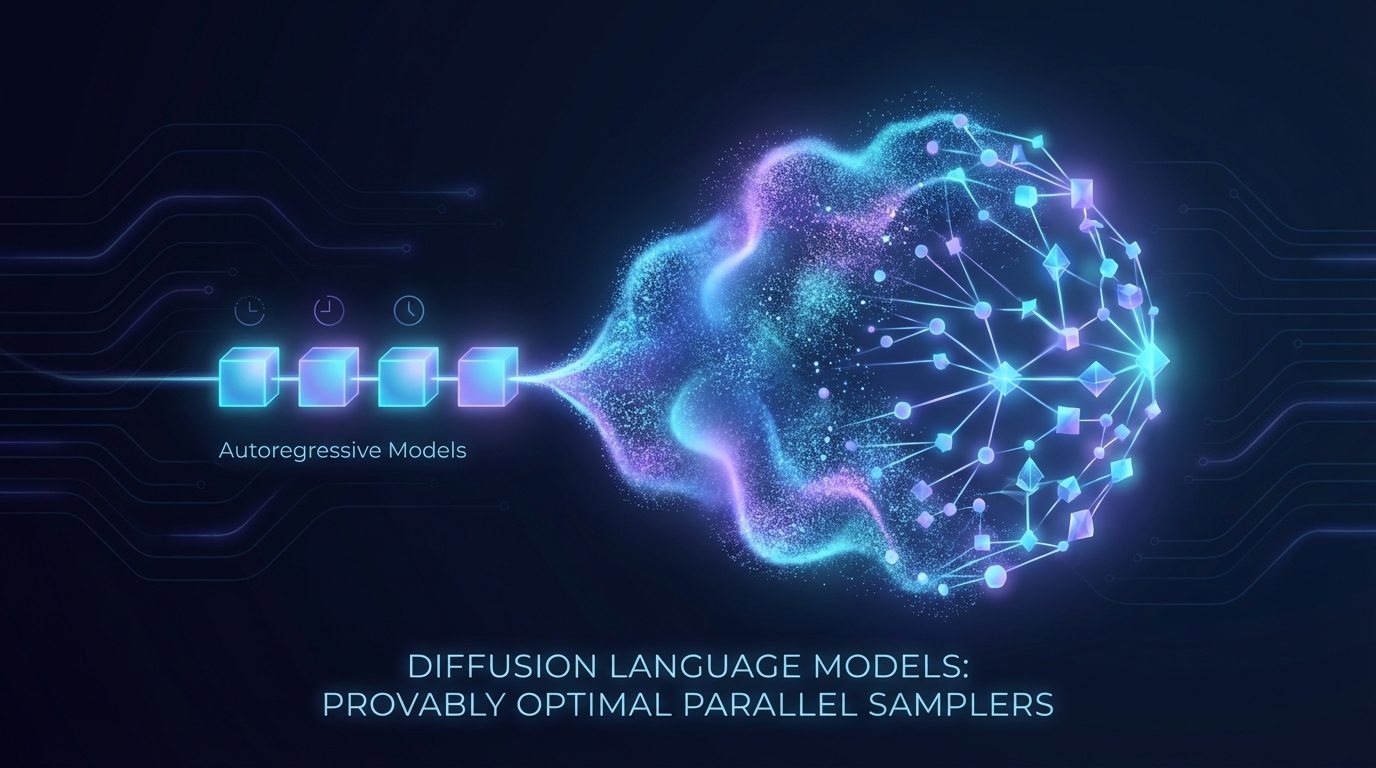

Modelos de Linguagem de Difusão são Provavelmente Amostras Paralelas Ótimas

Pesquisas recentes destacam a eficiência dos modelos de linguagem de difusão (DLMs) na geração de tokens em paralelo, desafiando os modelos autoregressivos tradicionais. Ao formalizar um modelo de amostragem paralela, o estudo comprova que os DLMs com cadeias de raciocínio de comprimento polinomial podem igualar os passos sequenciais ótimos dos algoritmos paralelos. No entanto, sem modificações nos tokens revelados, os DLMs podem apresentar pegadas intermediárias significativas. A introdução de métodos de remapeamento ou revisão permite que os DLMs mantenham uma complexidade espacial ideal e amplie sua expressividade. Essa pesquisa ressalta o potencial dos DLMs como amostradores paralelos superiores e defende a incorporação de capacidades de revisão.