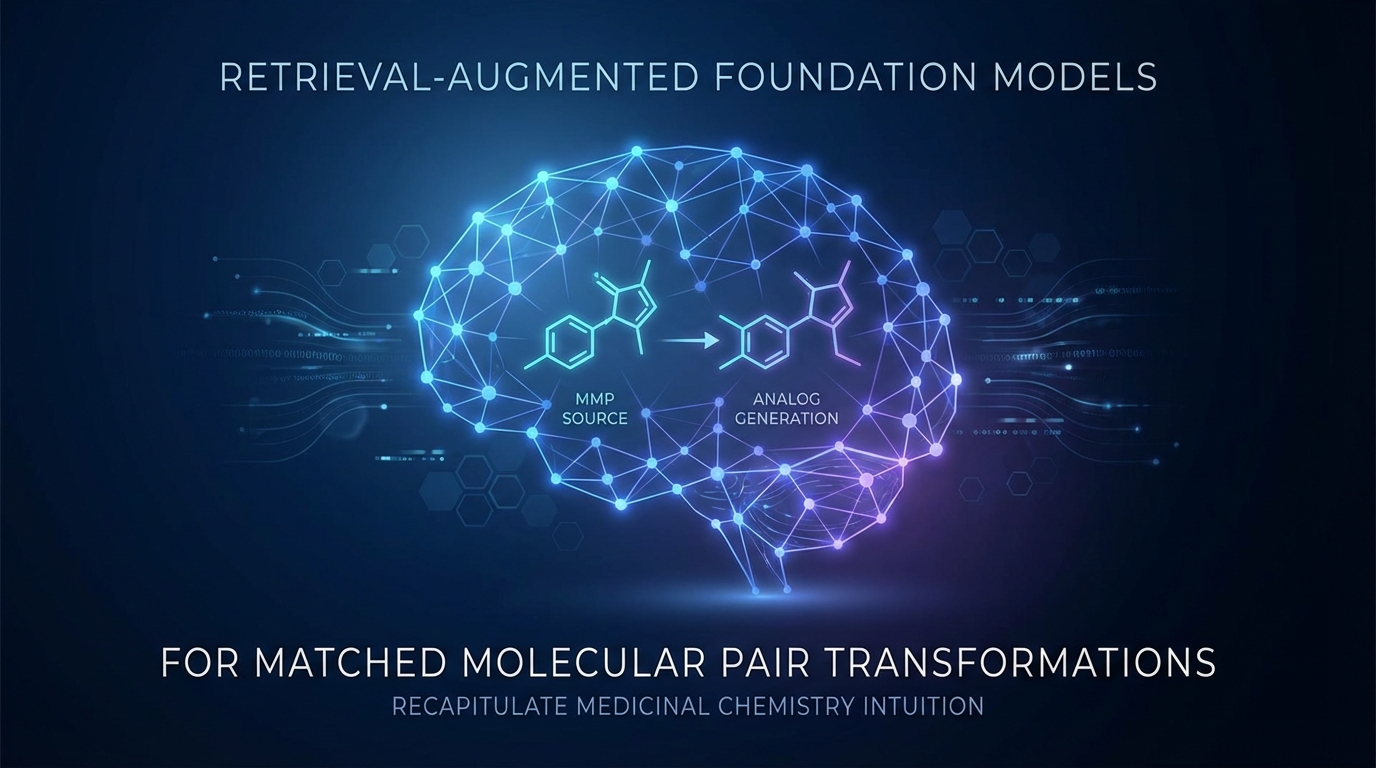

Modelos Fundamentais Aumentados por Recuperação para Transformações de Pares Moleculares Correspondentes a Recapturar a Intuição da Química Medicinal

Pesquisadores desenvolveram um novo modelo de base para gerar análogos químicos utilizando pares moleculares correspondentes (MMPs). Este modelo possibilita a geração de variáveis diversas com base em padrões de transformação definidos pelo usuário, aumentando a controlabilidade. O método, denominado MMPT-RAG, incorpora referências externas para melhorar a relevância contextual. Experimentos indicam avanços significativos na diversidade e novidade dos compostos gerados, tornando-o uma ferramenta valiosa para a química medicinal na descoberta prática de medicamentos.