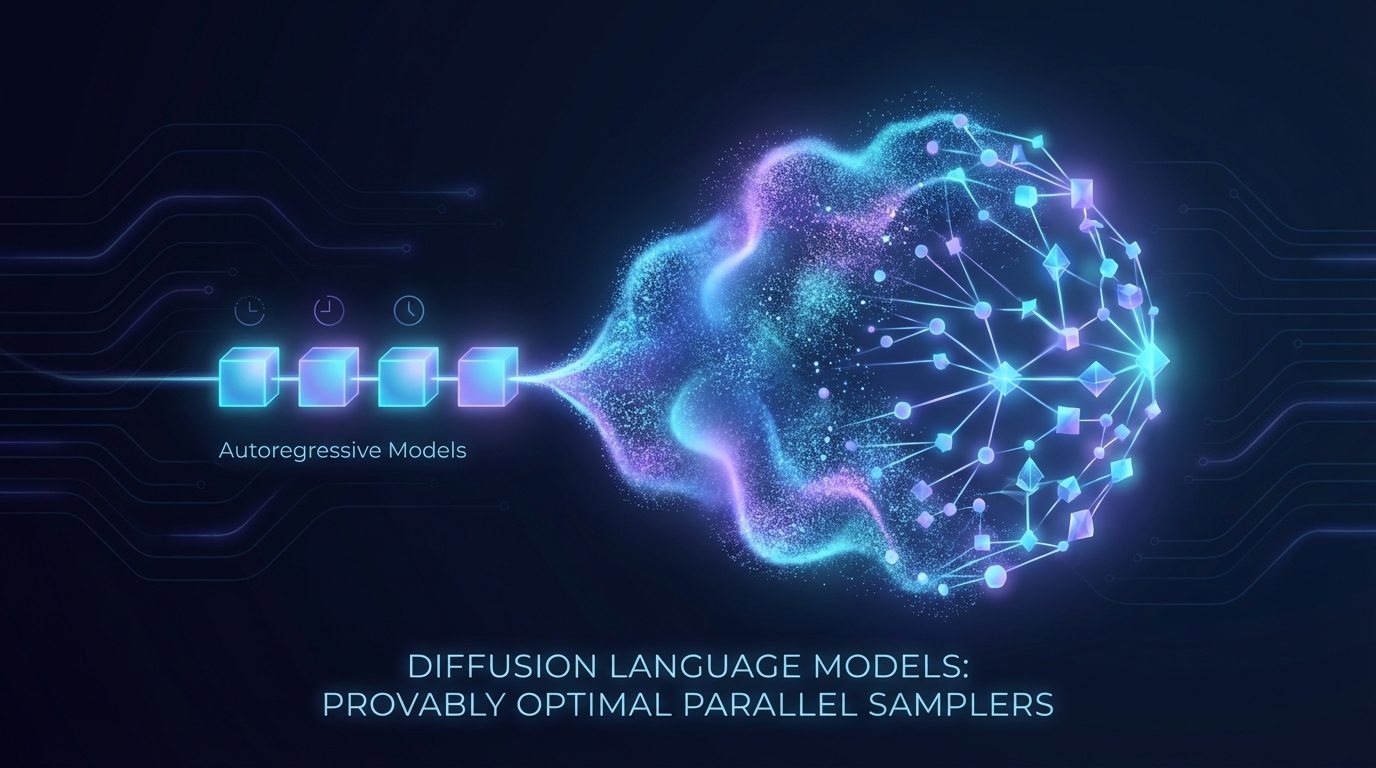

I modelli di linguaggio di diffusione sono provabilmente campionatori paralleli ottimali

Ricerche recenti mettono in luce l'efficienza dei modelli di linguaggio a diffusione (DLM) nella generazione di token in parallelo, sfidando i tradizionali modelli autoregressivi. Formalizzando un modello di campionamento parallelo, lo studio dimostra che i DLM con catene di pensiero di lunghezza polinomiale possono eguagliare i passi sequenziali ottimali degli algoritmi paralleli. Tuttavia, senza modifiche ai token rivelati, i DLM possono presentare impronte intermedie significative. L'introduzione di metodi di remasking o revisione consente ai DLM di mantenere una complessità spaziale ottimale e migliora la loro espressività. Questa ricerca sottolinea il potenziale dei DLM come campionatori paralleli superiori e promuove l'integrazione di capacità di revisione.