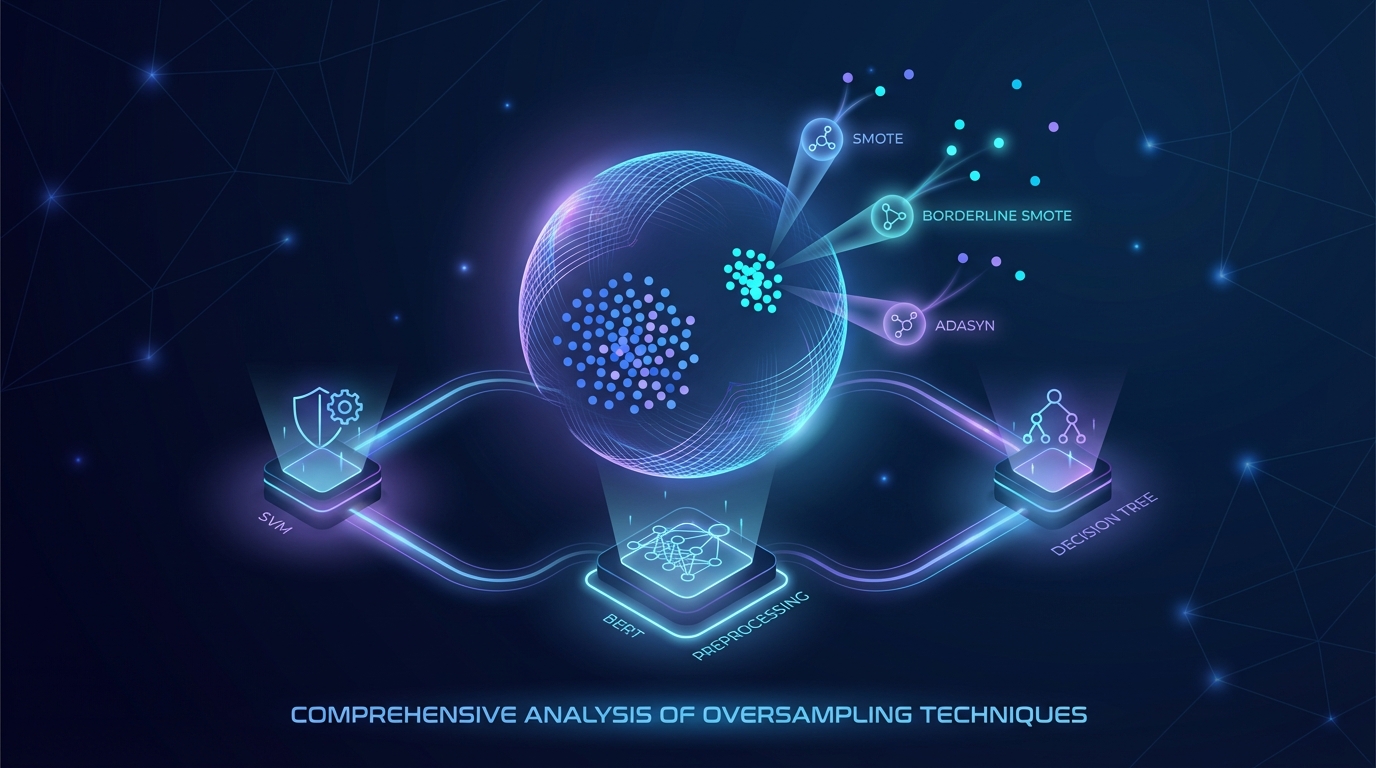

Analisi completa delle tecniche di oversampling per affrontare l'imbalance di classe mediante modelli di machine learning

Immagine generata da Gemini AI

Uno studio valuta le tecniche di oversampling (SMOTE, Borderline SMOTE, ADASYN) per affrontare il problema dell'imbalanced delle classi nel machine learning. Utilizzando BERT per il preprocessing, l'analisi coinvolge modelli come SVM, Decision Tree e Logistic Regression. Di particolare rilievo, l'SVM con Borderline SMOTE ha raggiunto un'accuratezza del 71,9% e un MCC di 0,53, evidenziando un miglioramento delle prestazioni del modello.

Analisi delle Tecniche di Oversampling Rivela Approfondimenti per l'Imbalance di Classe nel Machine Learning

Ricerche recenti hanno approfondito l'efficacia delle tecniche di oversampling nell'affrontare l'imbalance di classe nei dataset di machine learning, rivelando guadagni significativi nelle prestazioni del modello. Lo studio si è concentrato su metodi come SMOTE (Synthetic Minority Oversampling Technique), Borderline SMOTE e ADASYN (Adaptive Synthetic Sampling), testati in combinazione con vari algoritmi di machine learning tra cui Support Vector Machine (SVM) e Decision Tree.

Risultati Chiave

L'esperimento ha prodotto risultati notevoli, in particolare con il modello SVM che utilizza Borderline SMOTE, il quale ha raggiunto un tasso di accuratezza del 71,9% e un Matthews Correlation Coefficient (MCC) di 0,53. Questi metriche indicano un miglioramento significativo nella capacità del modello di classificare accuratamente le istanze sia nelle classi maggioritarie che minoritarie.

Argomenti correlati:

📰 Fonte originale: https://doi.org/10.2174/0126662558347788241127051934

Tutti i diritti e i crediti appartengono all'editore originale.