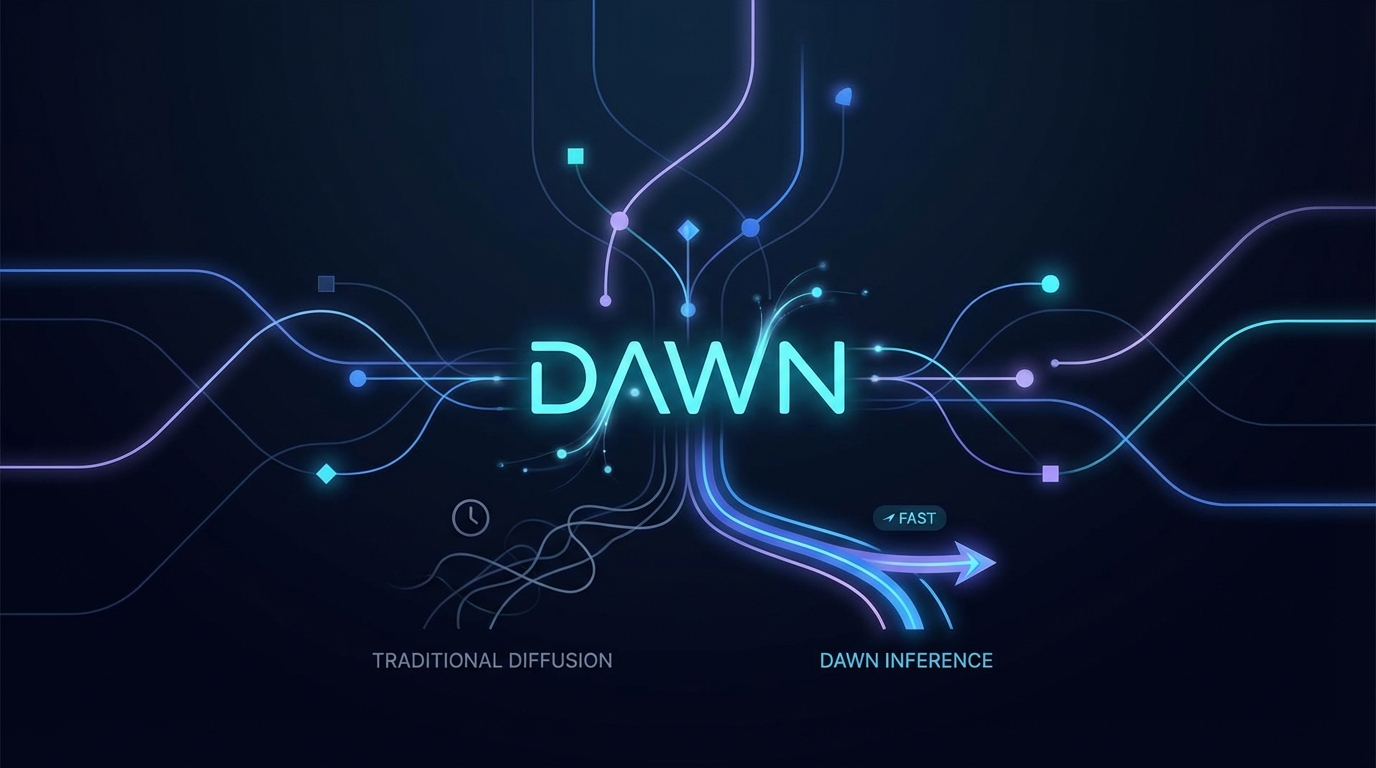

DAWN: Inferencia Rápida Consciente de Dependencias para Modelos de Lenguaje de Difusión

El artículo presenta DAWN, un nuevo método para mejorar la velocidad de inferencia en modelos de lenguaje de difusión de gran tamaño (dLLMs) sin comprometer la calidad de salida. DAWN aborda las ineficiencias de la decodificación paralela tradicional al modelar las dependencias entre tokens, lo que permite un desmascaramiento de tokens más confiable. Los resultados experimentales muestran que DAWN mejora la velocidad de inferencia en un rango de 1.80 a 8.06 veces en comparación con los métodos existentes, manteniendo la calidad de generación. El código está disponible en GitHub para su implementación.