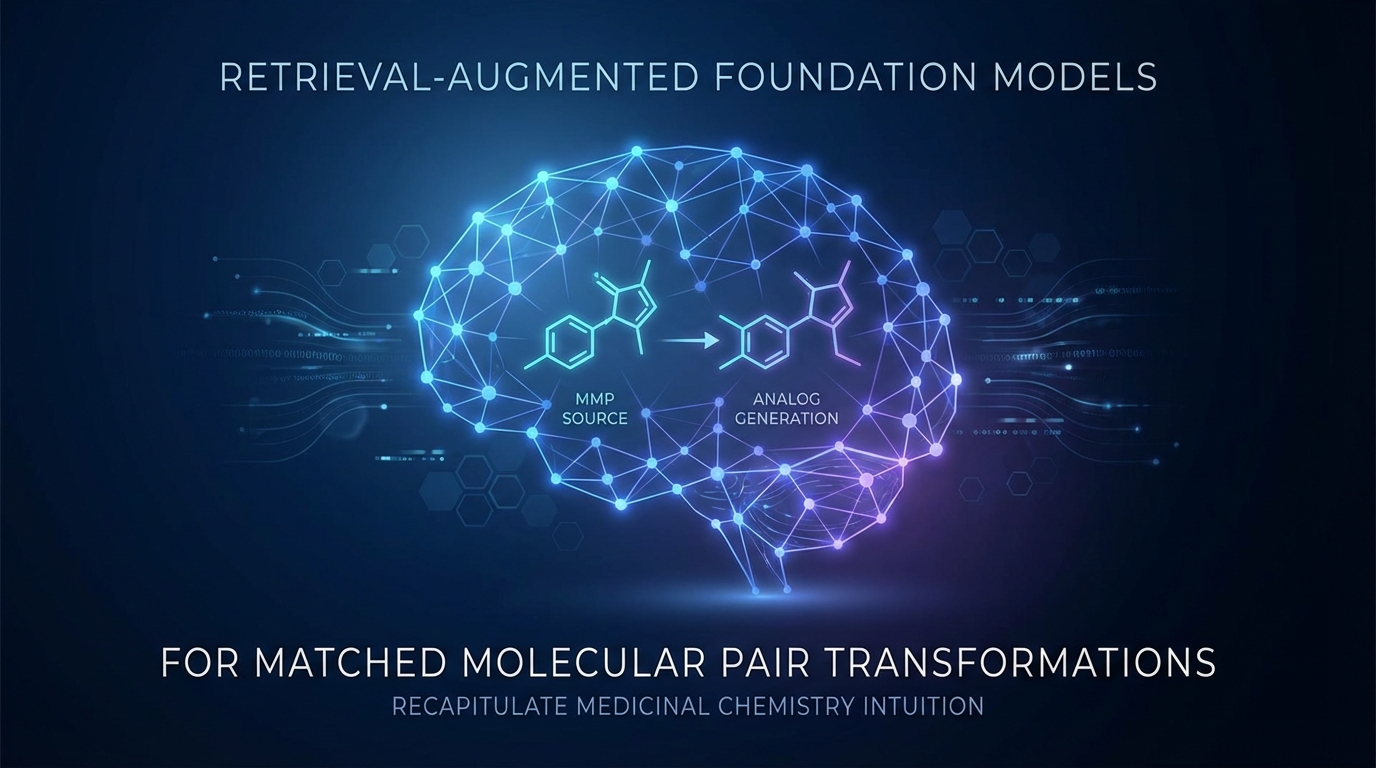

Modelos de Fundación Aumentados por Recuperación para Transformaciones de Parejas Moleculares Coincidentes que Recapitulaban la Intuición de la Química Medicinal

Investigadores han desarrollado un nuevo modelo fundamental para la generación de análogos químicos utilizando pares moleculares emparejados (MMPs). Este modelo permite la generación de variables diversas basadas en patrones de transformación definidos por el usuario, lo que mejora la capacidad de control. El método, denominado MMPT-RAG, incorpora referencias externas para aumentar la relevancia contextual. Los experimentos indican avances significativos en la diversidad y novedad de los compuestos generados, lo que lo convierte en una herramienta valiosa para la química medicinal en el descubrimiento práctico de fármacos.