Dependencia del tamaño del conjunto en métodos de post-procesamiento de aprendizaje profundo que minimizan una puntuación (in)justa: ejemplos motivadores y una solución de prueba de concepto

Imagen generada por Gemini AI

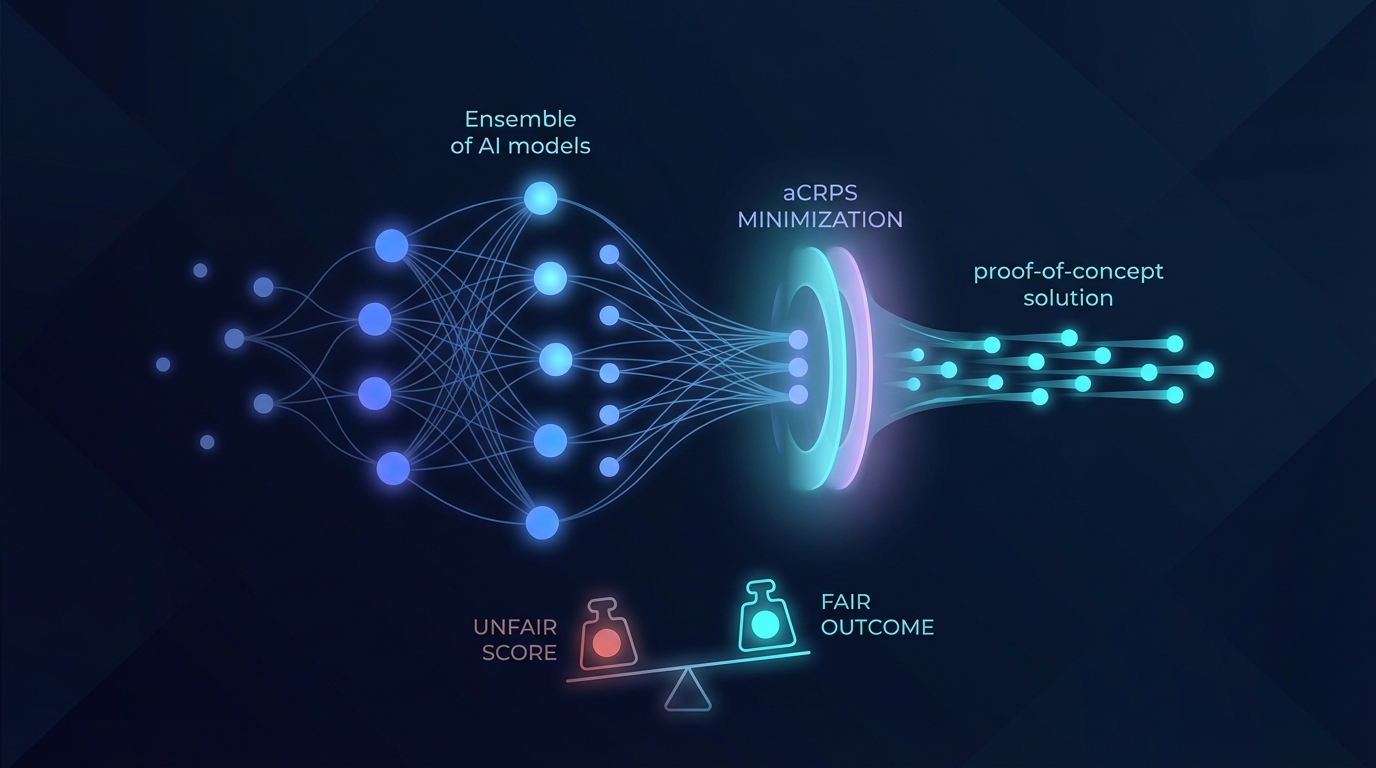

El artículo aborda los desafíos de utilizar la puntuación de probabilidad continua ajustada (aCRPS) para entrenar pronósticos en conjuntos, especialmente cuando se introducen dependencias estructurales entre los miembros. Se destacan dos enfoques problemáticos: la calibración lineal de los miembros y un método de aprendizaje profundo que puede generar problemas de sobredispersión. Los autores proponen los "transformadores de trayectoria", adaptando el marco PoET para mantener la independencia condicional en las predicciones. Este método reduce de manera efectiva los sesgos sistemáticos y mejora la fiabilidad de las previsiones de temperatura media semanal del sistema ECMWF, sin importar el tamaño del conjunto (3 frente a 9 miembros en el entrenamiento; 9 frente a 100 en tiempo real).

Nueva Investigación Destaca la Dependencia del Tamaño del Conjunto en Métodos de Post-Procesamiento de Aprendizaje Profundo

Hallazgos recientes revelan que la efectividad de ciertos métodos de post-procesamiento de aprendizaje profundo en la previsión por conjuntos puede verse significativamente influenciada por el tamaño del conjunto. El estudio se centra en puntajes justos, particularmente el puntaje de probabilidad continua ajustada (aCRPS), diseñado para evaluar las previsiones del conjunto sin sesgo en relación con el tamaño del conjunto.

La investigación investiga dos enfoques destinados a minimizar el aCRPS esperado para conjuntos finitos:

- Calibración Lineal Miembro por Miembro: Este método acopla los miembros del conjunto a través de una dependencia compartida en la media de la muestra del conjunto.

- Aprendizaje Profundo con Autoatención de Transformadores: Esta técnica vincula a los miembros del conjunto utilizando mecanismos de autoatención a través de la dimensión del conjunto.

Ambos métodos demostraron sensibilidad al tamaño del conjunto, indicando que las mejoras en el aCRPS podrían ser engañosas, a menudo acompañadas de una falta de fiabilidad sistemática y sobre-dispersión en las previsiones.

Transformadores de Trayectoria como Solución

Para abordar estos problemas, los investigadores introdujeron transformadores de trayectoria, una adaptación de prueba de concepto del marco de Post-procesamiento de Conjuntos con Transformadores (PoET). Este enfoque emplea autoatención a través de los plazos de anticipación mientras mantiene la independencia condicional necesaria para las evaluaciones de aCRPS.

Aplicados a previsiones semanales de temperatura media a 2 metros del sistema de previsión subseasonal del ECMWF, los transformadores de trayectoria redujeron efectivamente los sesgos sistemáticos del modelo y mejoraron la fiabilidad de las previsiones, independientemente del tamaño del conjunto utilizado en el entrenamiento.

Temas relacionados:

📰 Fuente original: https://arxiv.org/abs/2602.15830v1

Todos los derechos y créditos pertenecen al editor original.