DAWN: Inferencia Rápida Consciente de Dependencias para Modelos de Lenguaje de Difusión

Imagen generada por Gemini AI

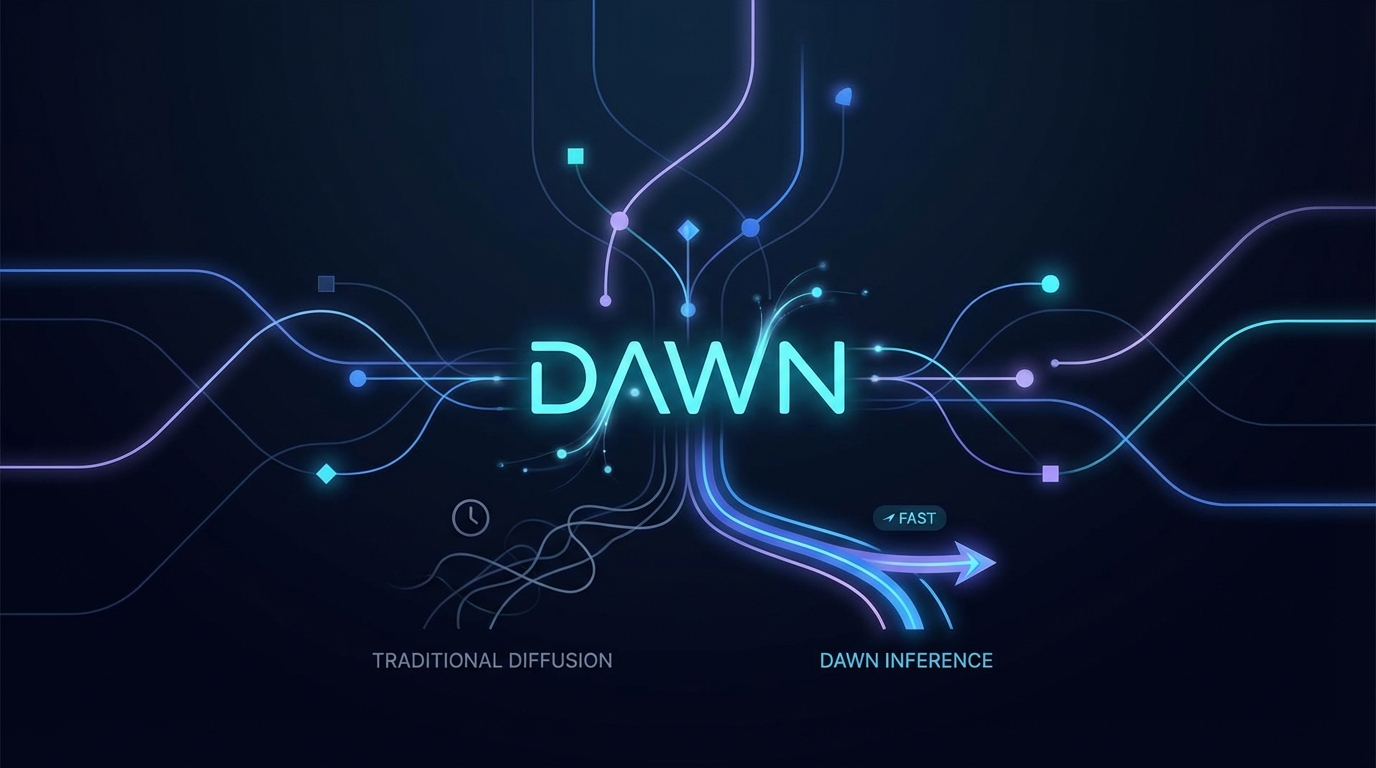

El artículo presenta DAWN, un nuevo método para mejorar la velocidad de inferencia en modelos de lenguaje de difusión de gran tamaño (dLLMs) sin comprometer la calidad de salida. DAWN aborda las ineficiencias de la decodificación paralela tradicional al modelar las dependencias entre tokens, lo que permite un desmascaramiento de tokens más confiable. Los resultados experimentales muestran que DAWN mejora la velocidad de inferencia en un rango de 1.80 a 8.06 veces en comparación con los métodos existentes, manteniendo la calidad de generación. El código está disponible en GitHub para su implementación.

El Nuevo Método de Decodificación DAWN Mejora la Velocidad de Inferencia para LLMs de Difusión

Investigadores han presentado DAWN, una técnica de decodificación novedosa destinada a optimizar la velocidad de inferencia para modelos de lenguaje grandes de difusión (dLLMs). Este método aborda las ineficiencias de las estrategias de decodificación paralela existentes.

DAWN emplea un enfoque sin entrenamiento y consciente de las dependencias que construye un gráfico de dependencias para priorizar las relaciones entre tokens. Se centra en dos ideas clave:

- Las posiciones que dependen de ciertos tokens no enmascarados generan salidas más confiables.

- Desenmascarar múltiples tokens fuertemente acoplados simultáneamente puede llevar a errores en la generación.

DAWN selecciona de manera efectiva las posiciones de desenmascaramiento más confiables en cada iteración, permitiendo altos niveles de paralelismo mientras mantiene la calidad del texto. Los experimentos han demostrado que DAWN puede acelerar la inferencia en un factor de 1.80 a 8.06 veces en comparación con las referencias existentes, sin comprometer la calidad de salida. El código de DAWN está disponible públicamente en GitHub.

Temas relacionados:

📰 Fuente original: https://arxiv.org/abs/2602.06953v1

Todos los derechos y créditos pertenecen al editor original.