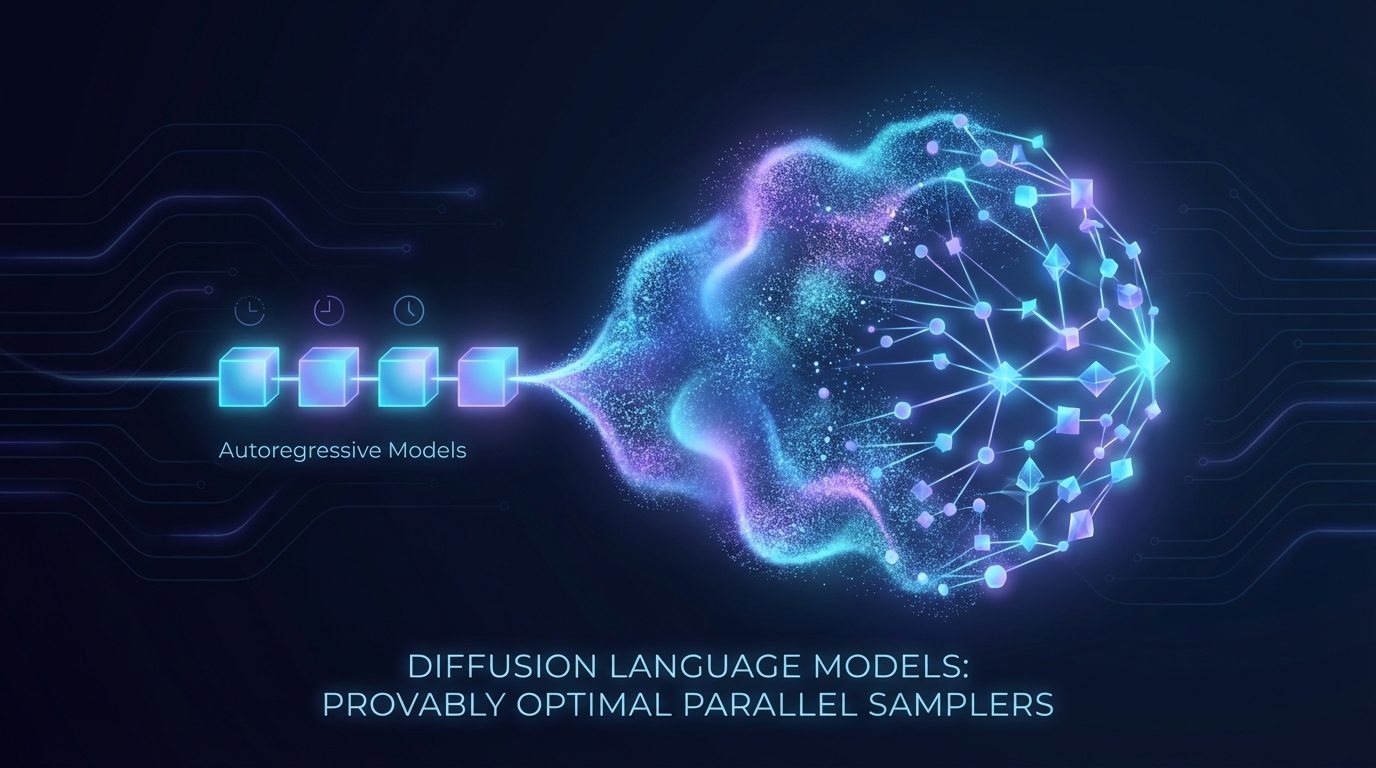

Les modèles de diffusion de langage sont des échantillonneurs parallèles optimalement prouvés.

Des recherches récentes mettent en lumière l'efficacité des modèles de langage par diffusion (DLM) dans la génération de tokens en parallèle, remettant en question les modèles autoregressifs traditionnels. En formalisant un modèle d'échantillonnage parallèle, l'étude démontre que les DLM avec une chaîne de pensée de longueur polynomiale peuvent atteindre des étapes séquentielles optimales des algorithmes parallèles. Cependant, sans modifications apportées aux tokens révélés, les DLM peuvent présenter des empreintes intermédiaires significatives. L'introduction de méthodes de remasque ou de révision permet aux DLM de maintenir une complexité spatiale optimale tout en améliorant leur expressivité. Cette recherche souligne le potentiel des DLM en tant qu'échantillonneurs parallèles supérieurs et plaide en faveur de l'intégration de capacités de révision.