Analyse complète des techniques de suréchantillonnage pour traiter le déséquilibre des classes en utilisant des modèles d'apprentissage automatique

Image générée par Gemini AI

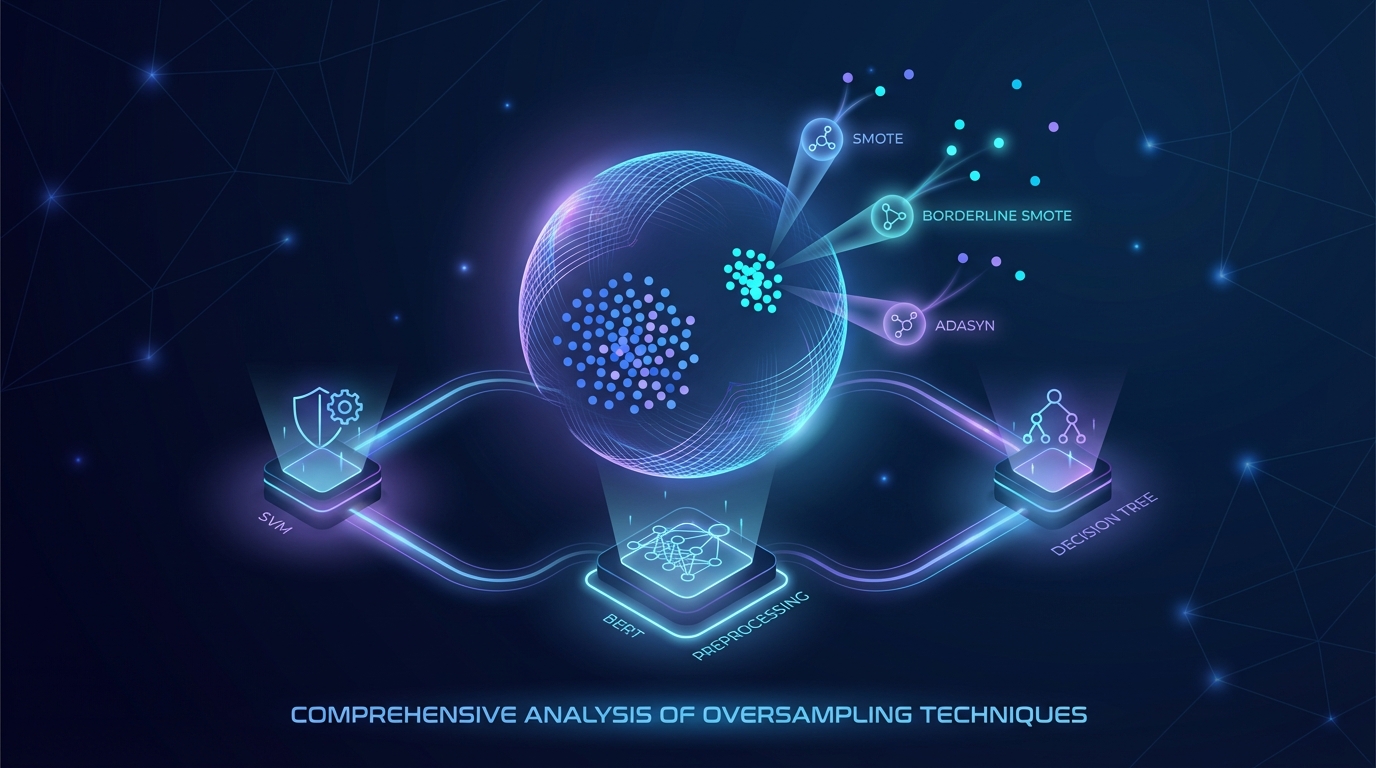

Une étude évalue les techniques de suréchantillonnage (SMOTE, Borderline SMOTE, ADASYN) pour traiter le déséquilibre des classes en apprentissage machine. En utilisant BERT pour le prétraitement, elle analyse des modèles tels que SVM, Arbre de Décision et Régression Logistique. Fait remarquable, le SVM couplé à Borderline SMOTE a atteint une précision de 71,9 % et un coefficient de corrélation de Matthews (MCC) de 0,53, mettant en lumière une amélioration significative des performances du modèle.

Analyse des techniques de suréchantillonnage révèle des insights pour le déséquilibre des classes en apprentissage automatique

Des recherches récentes ont exploré l'efficacité des techniques de suréchantillonnage pour traiter le déséquilibre des classes dans les ensembles de données d'apprentissage automatique, révélant des gains significatifs en termes de performance du modèle. L'étude s'est concentrée sur des méthodes telles que SMOTE (Techniques de Suréchantillonnage de Minorités Synthétiques), Borderline SMOTE, et ADASYN (Échantillonnage Synthétique Adaptatif), testées en conjonction avec divers algorithmes d'apprentissage automatique, y compris les Machines à Vecteurs de Support (SVM) et les Arbres de Décision.

Résultats Clés

L'expérience a produit des résultats notables, en particulier avec le modèle SVM utilisant Borderline SMOTE, qui a atteint un taux de précision de 71,9 % et un Coefficient de Corrélation de Matthews (MCC) de 0,53. Ces métriques indiquent une amélioration significative de la capacité du modèle à classifier avec précision les instances à la fois dans les classes majoritaires et minoritaires.

Sujets connexes :

📰 Source originale : https://doi.org/10.2174/0126662558347788241127051934

Tous les droits et crédits appartiennent à l'éditeur original.