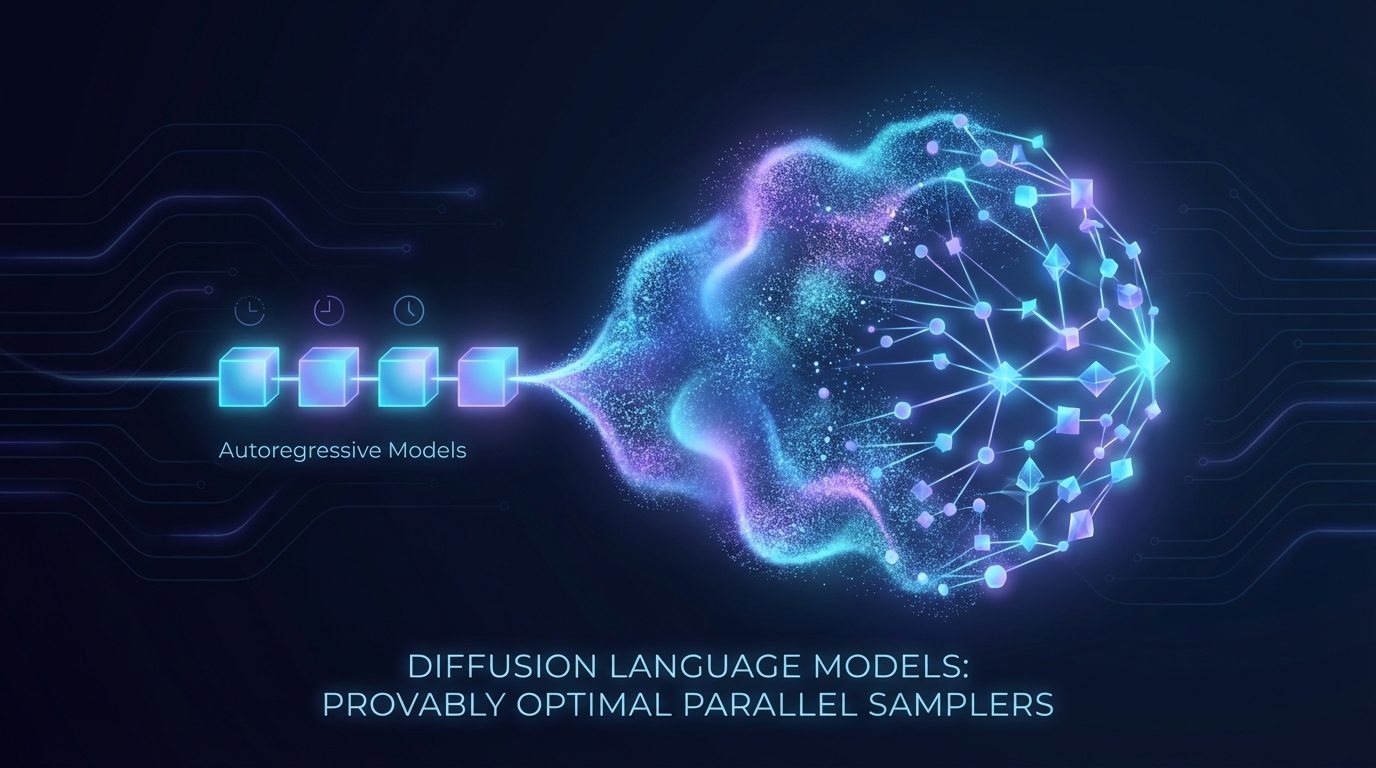

Los Modelos de Lenguaje de Difusión son Probablemente Muestreadores Óptimos en Paralelo

Investigaciones recientes destacan la eficiencia de los modelos de lenguaje por difusión (DLMs) en la generación paralela de tokens, desafiando los modelos autorregresivos tradicionales. Al formalizar un modelo de muestreo paralelo, el estudio demuestra que los DLMs con cadenas de pensamiento de longitud polinómica pueden igualar los pasos secuenciales óptimos de los algoritmos paralelos. Sin embargo, sin modificaciones en los tokens revelados, los DLMs pueden presentar huellas intermedias significativas. La introducción de métodos de remascarado o revisión permite a los DLMs mantener una complejidad espacial óptima y mejora su capacidad expresiva. Esta investigación subraya el potencial de los DLMs como muestreadores paralelos superiores y aboga por la incorporación de capacidades de revisión.