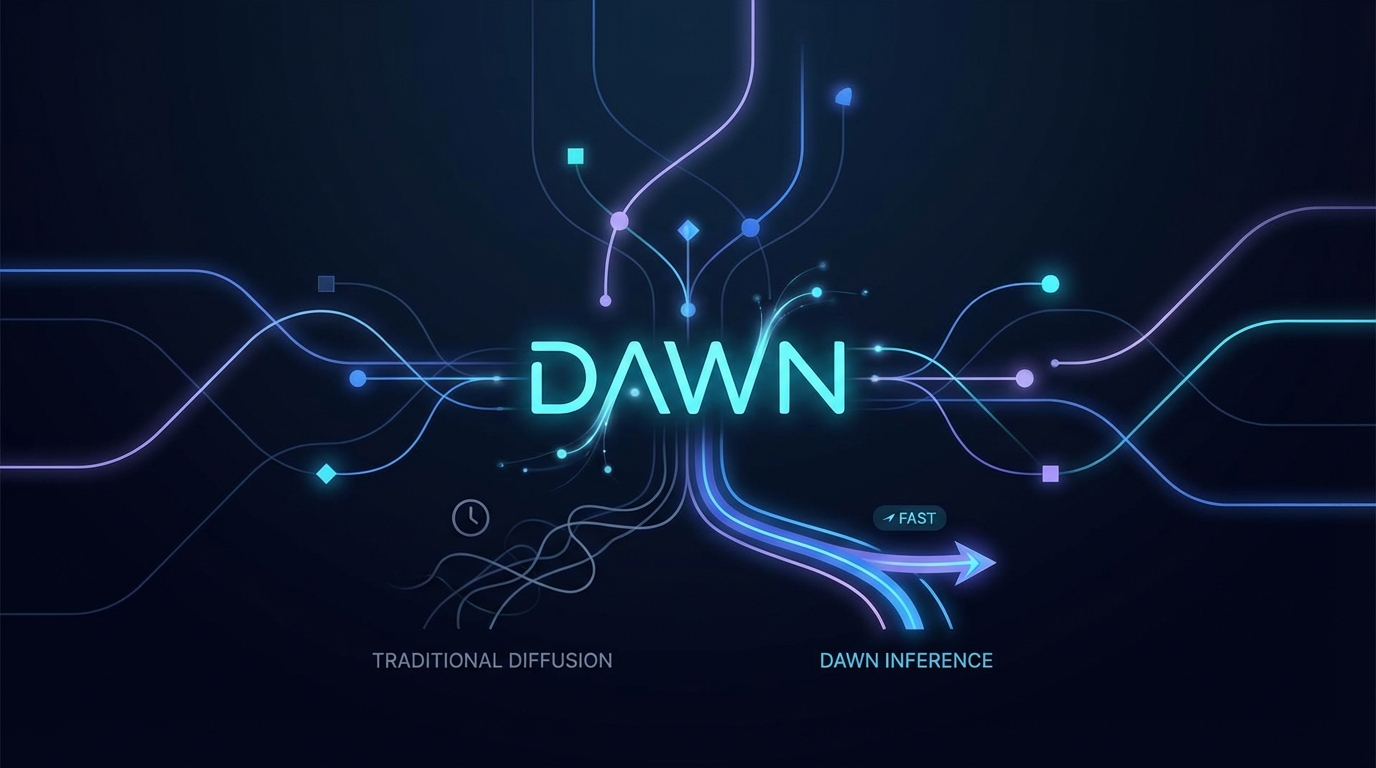

DAWN: Ускоренный вывод с учетом зависимостей для диффузионных LLM

В статье представлен DAWN — новый метод, который повышает скорость вывода в больших языковых моделях диффузии (dLLMs) без ущерба для качества результатов. DAWN решает проблемы традиционного параллельного декодирования, моделируя зависимости между токенами, что позволяет более надежно производить процесс «размытия» токенов. Экспериментальные результаты показывают, что DAWN увеличивает скорость вывода в 1,80-8,06 раза по сравнению с существующими методами, при этом сохраняя качество генерации. Код доступен на GitHub для реализации.