DAWN: Ускоренный вывод с учетом зависимостей для диффузионных LLM

Изображение создано Gemini AI

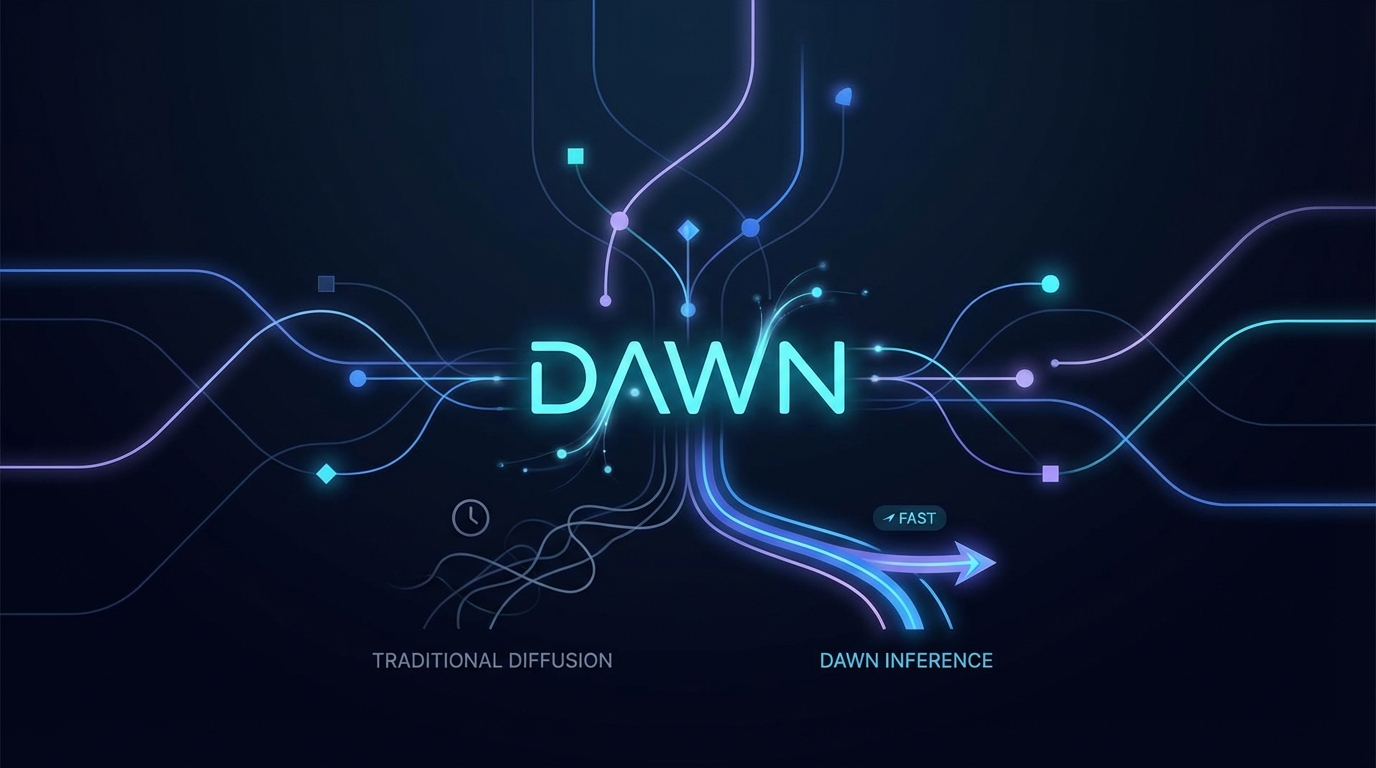

В статье представлен DAWN — новый метод, который повышает скорость вывода в больших языковых моделях диффузии (dLLMs) без ущерба для качества результатов. DAWN решает проблемы традиционного параллельного декодирования, моделируя зависимости между токенами, что позволяет более надежно производить процесс «размытия» токенов. Экспериментальные результаты показывают, что DAWN увеличивает скорость вывода в 1,80-8,06 раза по сравнению с существующими методами, при этом сохраняя качество генерации. Код доступен на GitHub для реализации.

Новый метод декодирования DAWN увеличивает скорость вывода для диффузионных LLM

Исследователи представили DAWN, новую технику декодирования, направленную на оптимизацию скорости вывода для диффузионных больших языковых моделей (dLLMs). Этот метод решает проблемы неэффективности существующих стратегий параллельного декодирования.

DAWN использует подход без обучения, учитывающий зависимости, который строит граф зависимостей для приоритизации отношений токенов. Он основывается на двух ключевых выводах:

- Позиции, которые зависят от определённых немаскированных токенов, дают более надежные результаты.

- Одновременное немаскирование нескольких сильно связанных токенов может привести к ошибкам в генерации.

DAWN эффективно выбирает самые надежные позиции для немаскирования на каждой итерации, обеспечивая высокий уровень параллелизма при сохранении качества текста. Эксперименты показали, что DAWN может ускорить вывод в 1.80 до 8.06 раз по сравнению с существующими базовыми решениями, не ухудшая качество вывода. Код для DAWN доступен публично на GitHub.

Связанные темы:

📰 Первоисточник: https://arxiv.org/abs/2602.06953v1

Все права и авторство принадлежат первоначальному издателю.