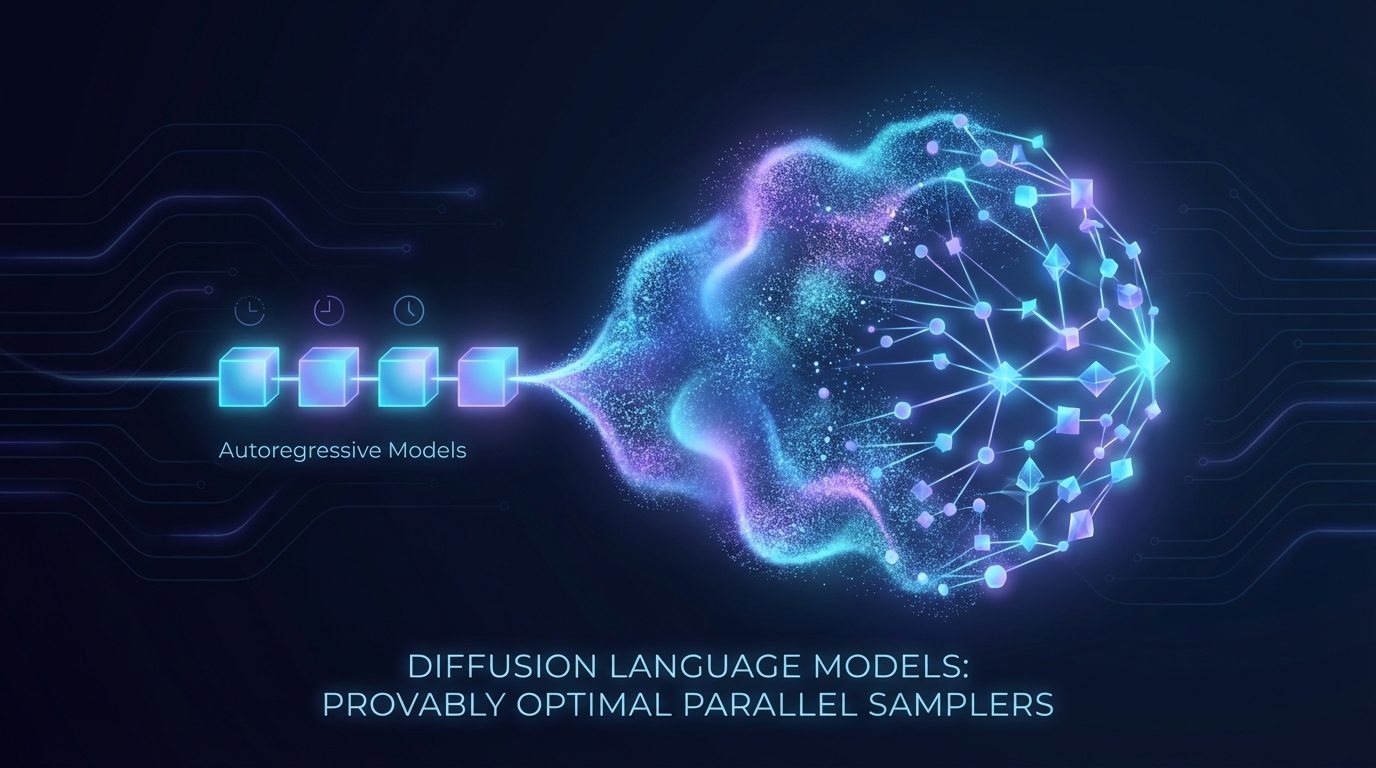

Языковые модели диффузии являются доказательно оптимальными параллельными образцами

Недавние исследования подчеркивают эффективность диффузионных языковых моделей (DLM) в параллельной генерации токенов, ставя под сомнение традиционные авторегрессионные модели. Формализуя модель параллельного семплирования, авторы исследования доказывают, что DLM с многочленной длиной цепочки размышлений могут соответствовать оптимальным последовательным шагам параллельных алгоритмов. Однако без модификаций раскрытых токенов DLM могут иметь значительные промежуточные затраты памяти. Введение методов ремаскирования или ревизии позволяет DLM поддерживать оптимальную пространственную сложность и улучшает их выразительность. Это исследование подчеркивает потенциал DLM как превосходных параллельных семплеров и призывает к интеграции возможностей ревизии.