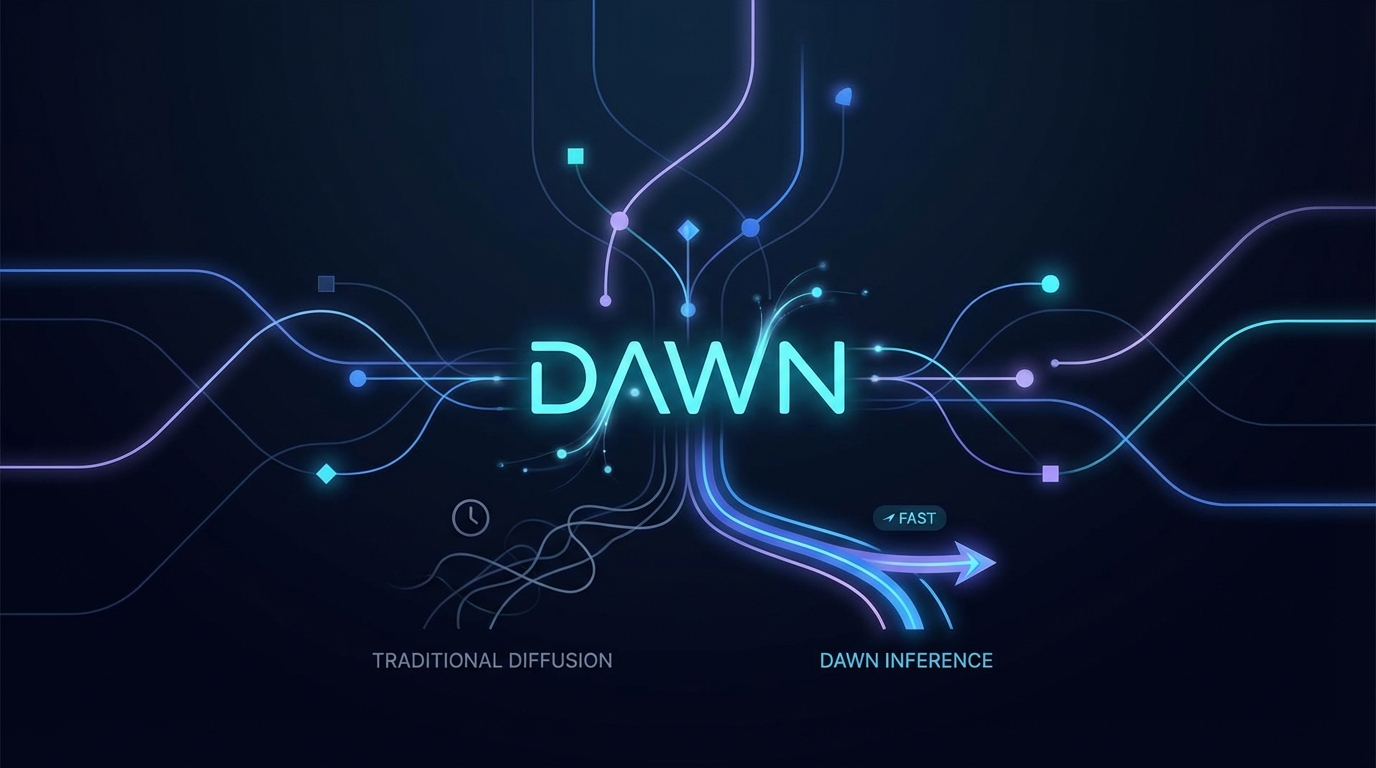

DAWN: Inferenza Veloce Consapevole delle Dipendenze per Modelli di Linguaggio di Diffusione

L'articolo presenta DAWN, un nuovo metodo per migliorare la velocità di inferenza nei modelli di linguaggio di grandi dimensioni basati su diffusione (dLLM), senza compromettere la qualità dell'output. DAWN affronta le inefficienze del decodificatore parallelo tradizionale modellando le dipendenze tra i token, consentendo così un mascheramento dei token più affidabile. I risultati sperimentali dimostrano che DAWN migliora la velocità di inferenza da 1,80 a 8,06 volte rispetto ai metodi esistenti, mantenendo al contempo la qualità della generazione. Il codice è disponibile su GitHub per l'implementazione.