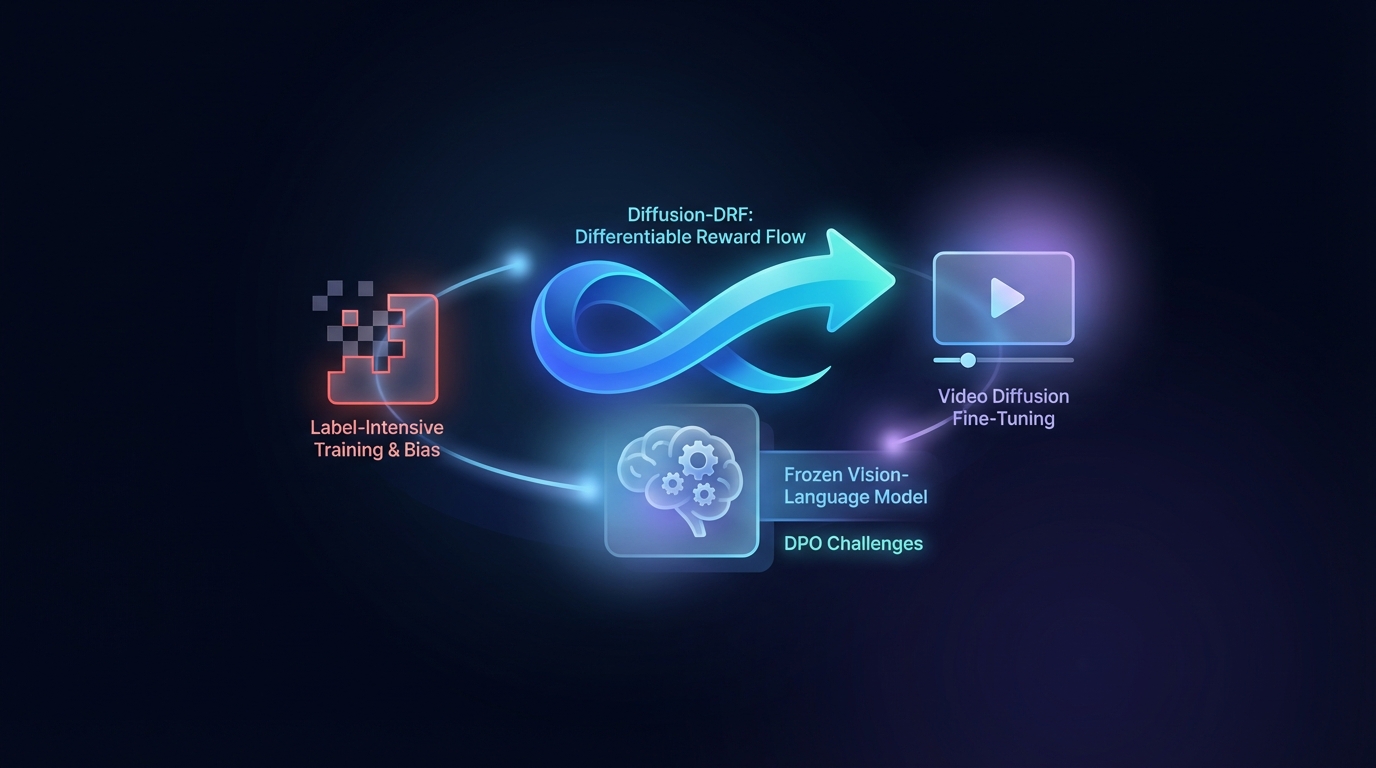

Diffusion-DRF: Flusso di Ricompensa Differenziabile per il Fine-Tuning della Diffusione Video

L'ottimizzazione diretta delle preferenze (DPO) migliora la generazione di video a partire da testo, ma si trova di fronte a sfide legate a un addestramento intensivo di etichette e ai bias. Il metodo proposto, Diffusion-DRF, utilizza un modello Vision-Language congelato come critico differenziabile, consentendo una retropropagazione efficiente dei feedback attraverso i modelli di diffusione video. Questo approccio migliora la qualità dei video e l'allineamento semantico, riducendo al contempo i problemi legati al "reward hacking". Inoltre, è adattabile ad altri compiti basati sulla diffusione senza la necessità di modelli di ricompensa aggiuntivi.