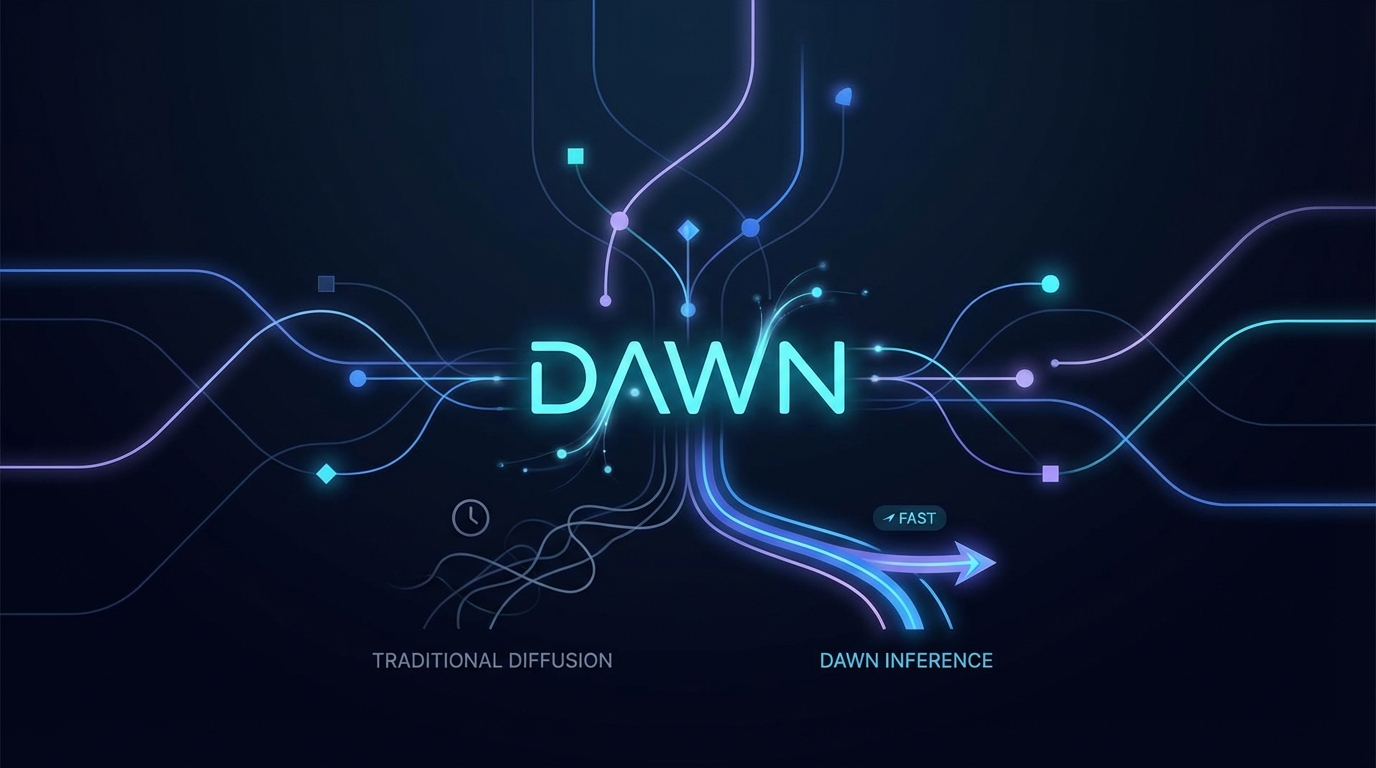

DAWN: Abhängigkeitsbewusste schnelle Inferenz für Diffusions-LLMs

Der Artikel stellt DAWN vor, eine neue Methode zur Verbesserung der Inferenzgeschwindigkeit in diffusionsbasierten großen Sprachmodellen (dLLMs), ohne die Ausgabequalität zu beeinträchtigen. DAWN behebt die Ineffizienzen des herkömmlichen parallelen Decodings, indem es die Abhängigkeiten zwischen den Tokens modelliert, was zu einer zuverlässigeren Entmaskierung der Tokens führt. Experimentelle Ergebnisse zeigen, dass DAWN die Inferenzgeschwindigkeit im Vergleich zu bestehenden Methoden um das 1,80- bis 8,06-Fache steigert, während die Qualität der Generierung erhalten bleibt. Der Code steht auf GitHub zur Verfügung, um die Implementierung zu erleichtern.