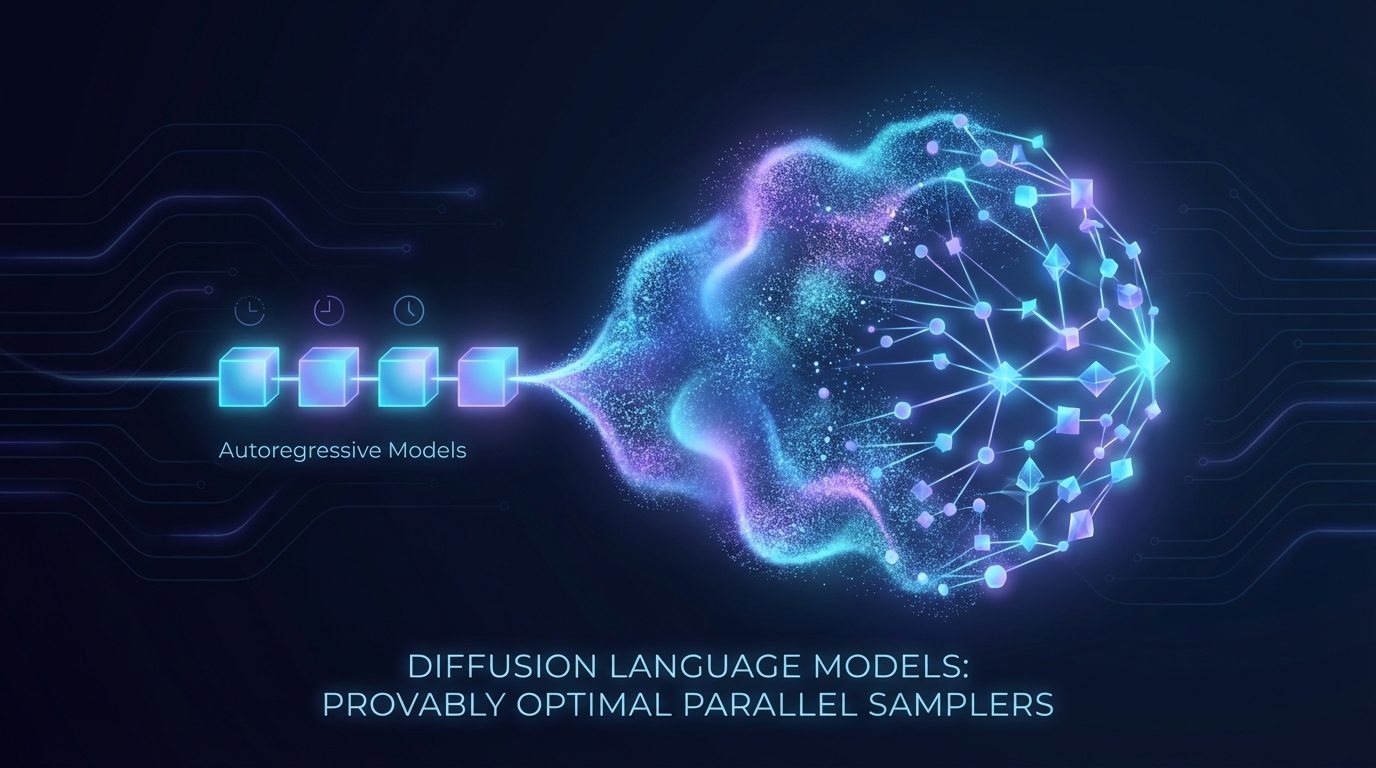

Diffusionsprachemodelle sind nachweislich optimale parallele Sampler

Jüngste Forschungen zeigen die Effizienz von Diffusions-Sprachmodellen (DLMs) bei der parallelen Token-Generierung und stellen damit die traditionellen autoregressiven Modelle in Frage. Durch die Formalisierung eines parallelen Sampling-Modells belegt die Studie, dass DLMs mit polynomial langer Ketten-Denkschule die optimalen sequenziellen Schritte paralleler Algorithmen erreichen können. Allerdings können DLMs ohne Anpassungen bei den offenbarten Tokens signifikante Zwischenablagen aufweisen. Die Einführung von Remasking- oder Überarbeitungsmethoden ermöglicht es DLMs, eine optimale räumliche Komplexität zu bewahren und ihre Ausdruckskraft zu erhöhen. Diese Forschung hebt das Potenzial von DLMs als überlegene parallele Sampler hervor und plädiert für die Integration von Überarbeitungsfähigkeiten.