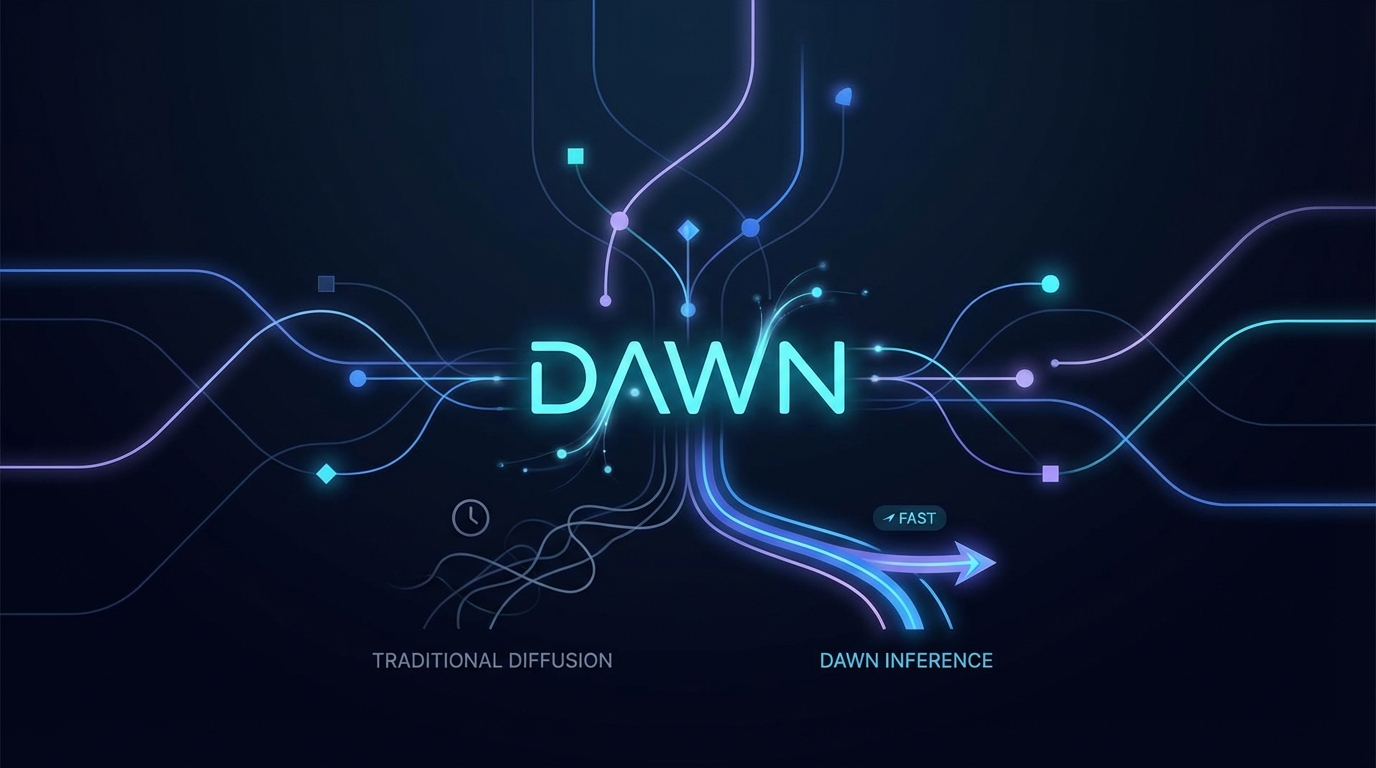

DAWN : Inférence rapide consciente des dépendances pour les LLMs de diffusion

L'article présente DAWN, une nouvelle méthode visant à améliorer la vitesse d'inférence des modèles de langage à diffusion (dLLMs) sans compromettre la qualité des résultats. DAWN s'attaque aux inefficacités du décodage parallèle traditionnel en modélisant les dépendances entre les tokens, permettant ainsi un démasquage des tokens plus fiable. Les résultats expérimentaux montrent que DAWN augmente la vitesse d'inférence de 1,80 à 8,06 fois par rapport aux méthodes existantes, tout en maintenant la qualité de la génération. Le code est disponible sur GitHub pour une mise en œuvre facile.