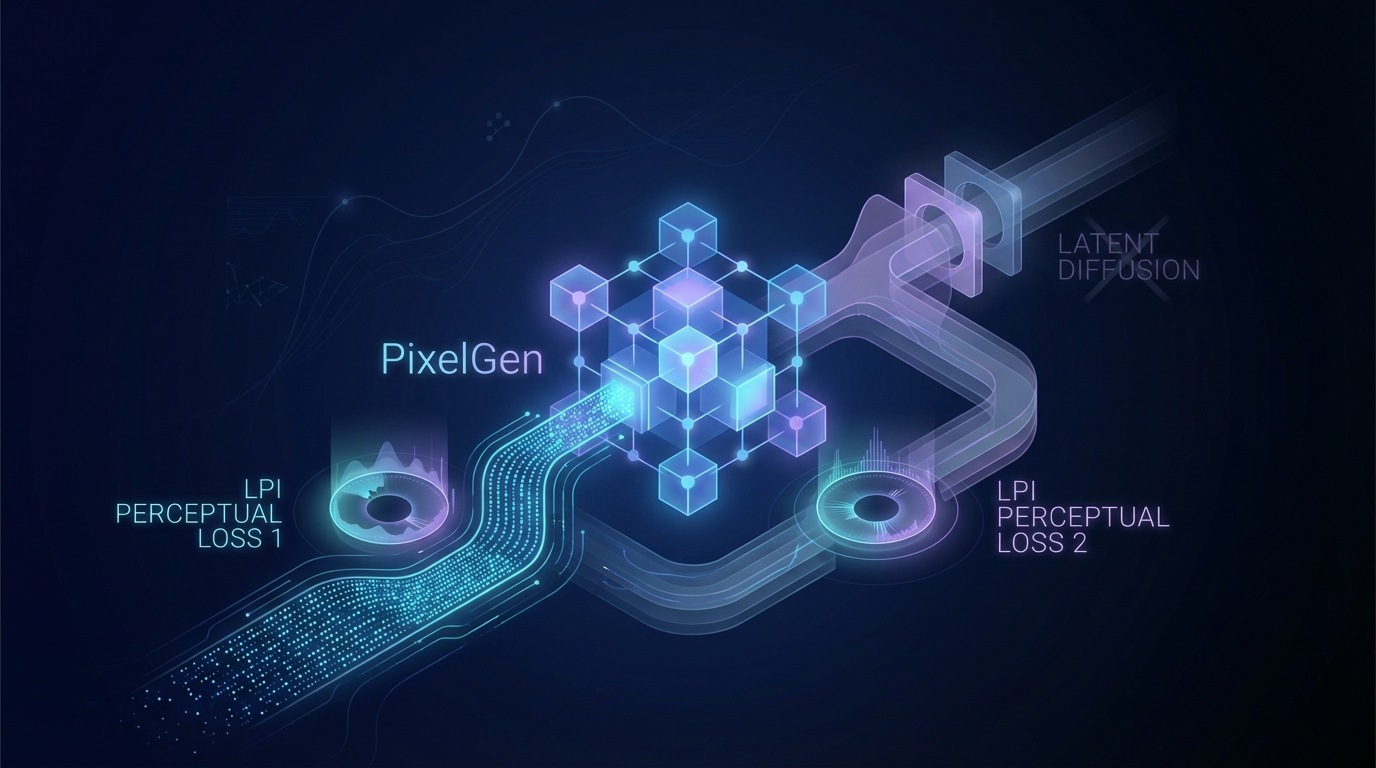

PixelGen:像素扩散在感知损失下超越潜在扩散

Gemini AI生成的图像

PixelGen 是一个新颖的像素扩散框架,通过直接在像素空间中优化,克服了传统两阶段潜在扩散模型的局限性。它采用了两种感知损失——LPIPS 用于局部模式,DINO 用于全局语义,从而提升图像质量。PixelGen 在 ImageNet-256 上达到了 5.11 的竞争性 FID,仅经过 80 个训练周期,并且在大规模文本到图像任务中表现出色,GenEval 得分达到 0.79。这种方法省去了变分自编码器 (VAE) 和辅助阶段,提供了一种简化且高效的生成模型。完整代码可在 GitHub 上获取。

PixelGen以创新的感知损失超越潜在扩散

PixelGen是一种新颖的像素扩散框架,通过引入感知监督,展示了比传统潜在扩散模型更优越的性能。这一进展使得在像素空间中直接生成图像成为可能,消除了与两阶段潜在扩散过程相关的伪影和瓶颈。

关键性能指标

在严格的测试中,PixelGen在ImageNet-256数据集上达到了5.11的Fréchet Inception Distance (FID)分数,且未使用无分类器引导,仅进行了80个训练周期。这一成绩标志着相较于现有潜在扩散基线的显著提升。

此外,PixelGen在文本到图像生成任务中展示了令人印象深刻的扩展能力,取得了0.79的GenEval分数。该框架的设计消除了对变分自编码器(VAEs)和潜在表示的需求,从而简化了生成过程。

可用性

开发者和研究人员可以在这个GitHub仓库中公开访问代码。

相关主题:

PixelGen像素扩散感知损失LPIPS损失DINO

📰 原始来源: https://arxiv.org/abs/2602.02493v1

所有权利和署名均属于原出版商。