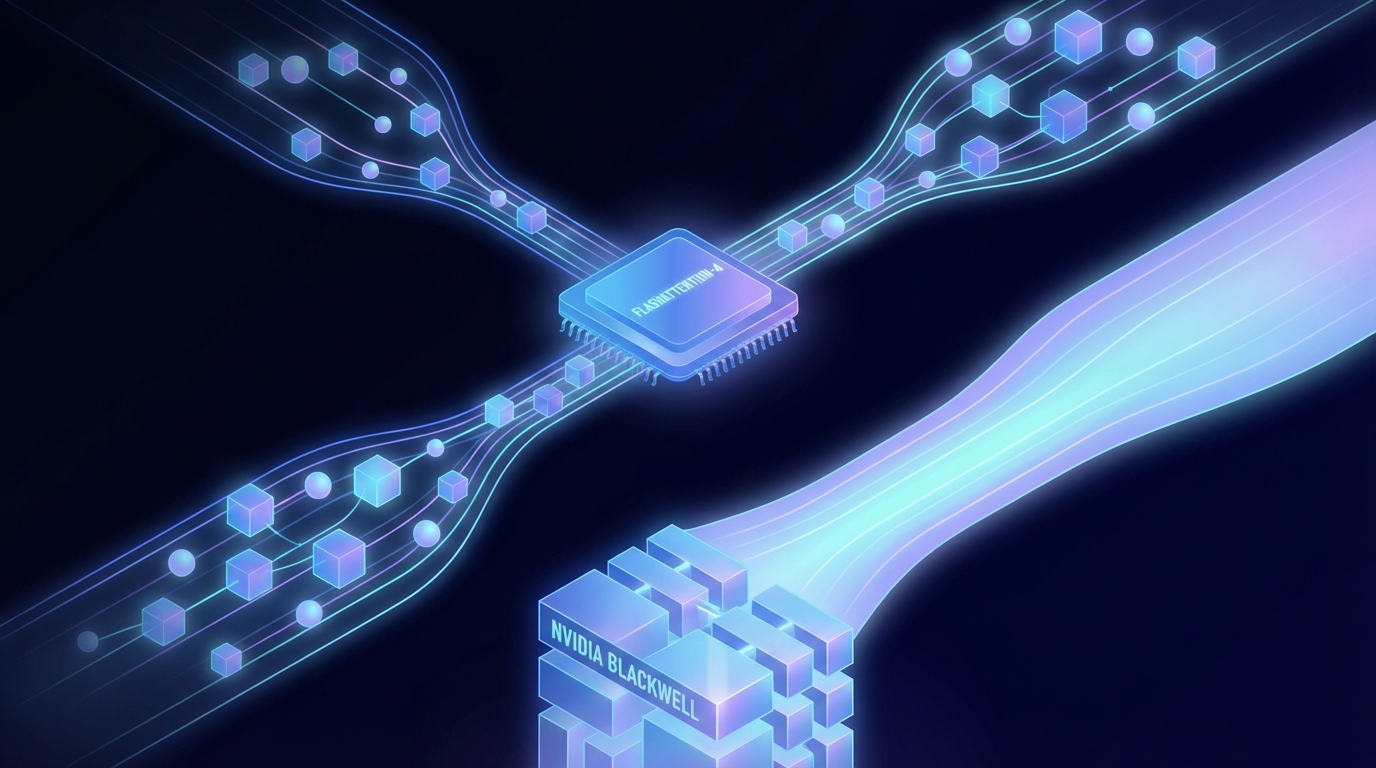

在NVIDIA Blackwell上通过FlashAttention-4克服计算和内存瓶颈

Gemini AI生成的图像

变换器架构在生成性人工智能的崛起中发挥了关键作用,使大型语言模型(LLMs)如GPT、DeepSeek和Llama得以实现。该架构提升了处理效率和语境理解,推动了自然语言处理任务的重大进展。这对人工智能应用的影响深远,因为变换器使得在各个领域(从客户服务到内容创作)实现更细致和灵活的互动成为可能。

在NVIDIA Blackwell上通过FlashAttention-4克服计算和内存瓶颈

NVIDIA推出了FlashAttention-4,这是一项旨在优化变换器模型计算和内存效率的进展,特别是针对像GPT和Llama这样的巨大语言模型(LLMs)。

FlashAttention-4解决了传统注意力机制中的挑战,随着模型规模的增长,这些机制常常面临内存使用和计算速度的限制。这一实现使得可以更高效地训练和部署更大的模型。

FlashAttention-4的主要特点包括:

- 改进的内存效率:减少注意力计算的内存占用,使得更大的模型能够适应现有硬件。

- 增强的速度:显著加快变换器模型的训练和推理过程。

- 与Blackwell的无缝集成:旨在充分利用即将推出的Blackwell GPU所提供的增强功能。

早期基准测试表明,使用FlashAttention-4的模型实现了更高的吞吐量,减少了训练所需的时间和资源。随着对强大AI模型需求的增加,这一进展可能会在自然语言理解和生成能力上带来显著改善。

相关主题:

NVIDIA Blackwell TransformerFlashAttention-4计算和内存瓶颈生成式人工智能大型语言模型