Jet-RL:通过统一训练和回放精度流实现在线FP8强化学习

Gemini AI生成的图像

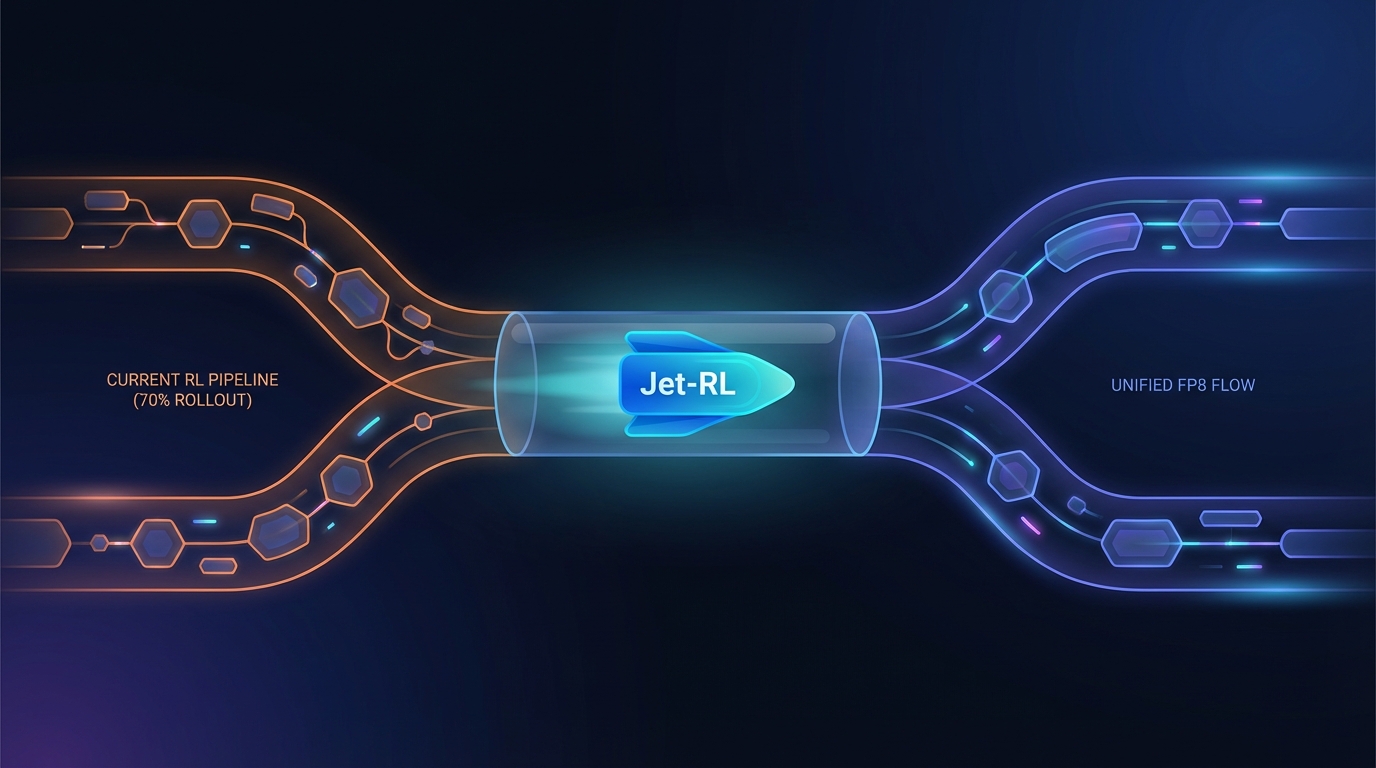

研究显示,当前大型语言模型的强化学习(RL)流程存在效率低下的问题,其中推理阶段占据了超过70%的训练时间。一项研究指出,常见的BF16与FP8组合策略导致了不稳定性和准确度损失。为此,Jet-RL应运而生,它在训练和推理过程中统一使用FP8精度,提升了效率,最高可达41%,并在对准确度影响极小的情况下稳定了收敛过程。

Jet-RL通过统一的FP8训练革命性地改进强化学习

Jet-RL是一个新颖的框架,通过在训练和推理阶段使用FP8精度来简化强化学习(RL)训练过程。这种方法提高了计算效率,解决了传统RL管道中的高资源消耗问题。

目前采用BF16精度进行训练、FP8进行推理的方法在长时间推理时常常会遭遇不稳定和准确性下降的问题。Jet-RL最小化了训练与推理之间的数值差异,消除了步骤间校准的需要。

Jet-RL的性能指标

大量实验确认了Jet-RL的有效性,展示了:

- 推理加速:推理时间最高加快33%。

- 训练加速:训练阶段最高加快41%。

- 端到端加速:相比传统的BF16训练,整体加速16%。

这些改进在保持各类任务的稳定收敛的同时,几乎没有准确性下降,标志着为大型语言模型(LLMs)开发者带来了重要的进步。

解决训练不稳定性

研究强调,BF16 + FP8策略中的不稳定性源于训练方法的离策略特性,阻碍了RL在复杂推理任务中的应用。通过采用Jet-RL的统一方法,实践者可以期待一个更可靠的训练过程,从而提升LLM在实际应用中的表现。

相关主题:

Jet-RLFP8强化学习滚动精度BF16

📰 原始来源: https://arxiv.org/abs/2601.14243v1

所有权利和署名均属于原出版商。