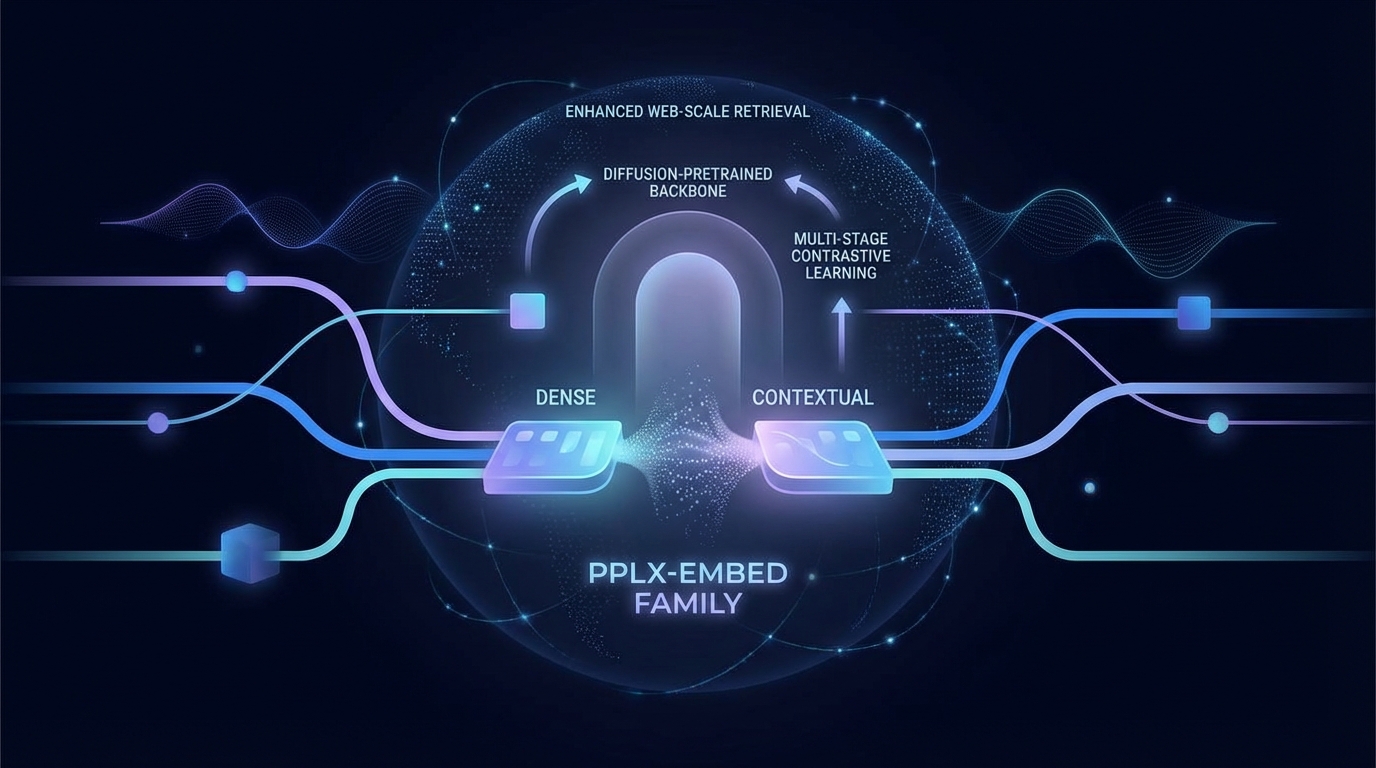

扩散预训练的稠密和上下文嵌入

Gemini AI生成的图像

新的pplx-embed多语言嵌入模型系列采用多阶段对比学习,基于扩散预训练的骨干网络,旨在提升网络规模检索的效果。此次发布了两个版本:pplx-embed-v1适用于标准任务,而pplx-embed-context-v1则专注于上下文嵌入。后者在ConTEB基准测试中表现出色,同时这两个模型在多个其他检索基准和内部评估中也取得了良好成绩,表明它们在大规模搜索应用中的可靠性。

新多语言嵌入模型将改变网页规模的检索

研究人员揭示了pplx-embed,这是一系列多语言嵌入模型,旨在增强网页规模的检索过程。这些模型利用多阶段对比学习方法,基于扩散预训练的语言模型,旨在高效捕捉长段落中的上下文。

pplx-embed模型采用双向注意机制,促进对文档上下文的全面理解。已经发布了两个变体:pplx-embed-v1,针对标准检索任务进行了优化,以及pplx-embed-context-v1,提供了上下文化的嵌入,将更广泛的文档上下文整合到单个段落的表示中。

性能亮点

pplx-embed-v1模型在多个著名基准测试中表现出色,包括:

- MTEB(多语言,v2)

- MTEB(代码)

- MIRACL

- BERGEN

- ToolRet

值得注意的是,pplx-embed-context-v1模型在评估上下文理解的ConTEB基准测试中取得了创纪录的成绩。

实际应用

除了正式的基准测试,pplx-embed-v1模型在模拟现实搜索场景的内部评估中也表现出强大的性能,评估了数千万文档上的有效性。这突显了其在生产环境中提升检索质量和效率的潜力。

相关主题:

扩散预训练pplx-embed多语言嵌入模型双向注意力检索质量

📰 原始来源: https://arxiv.org/abs/2602.11151v1

所有权利和署名均属于原出版商。