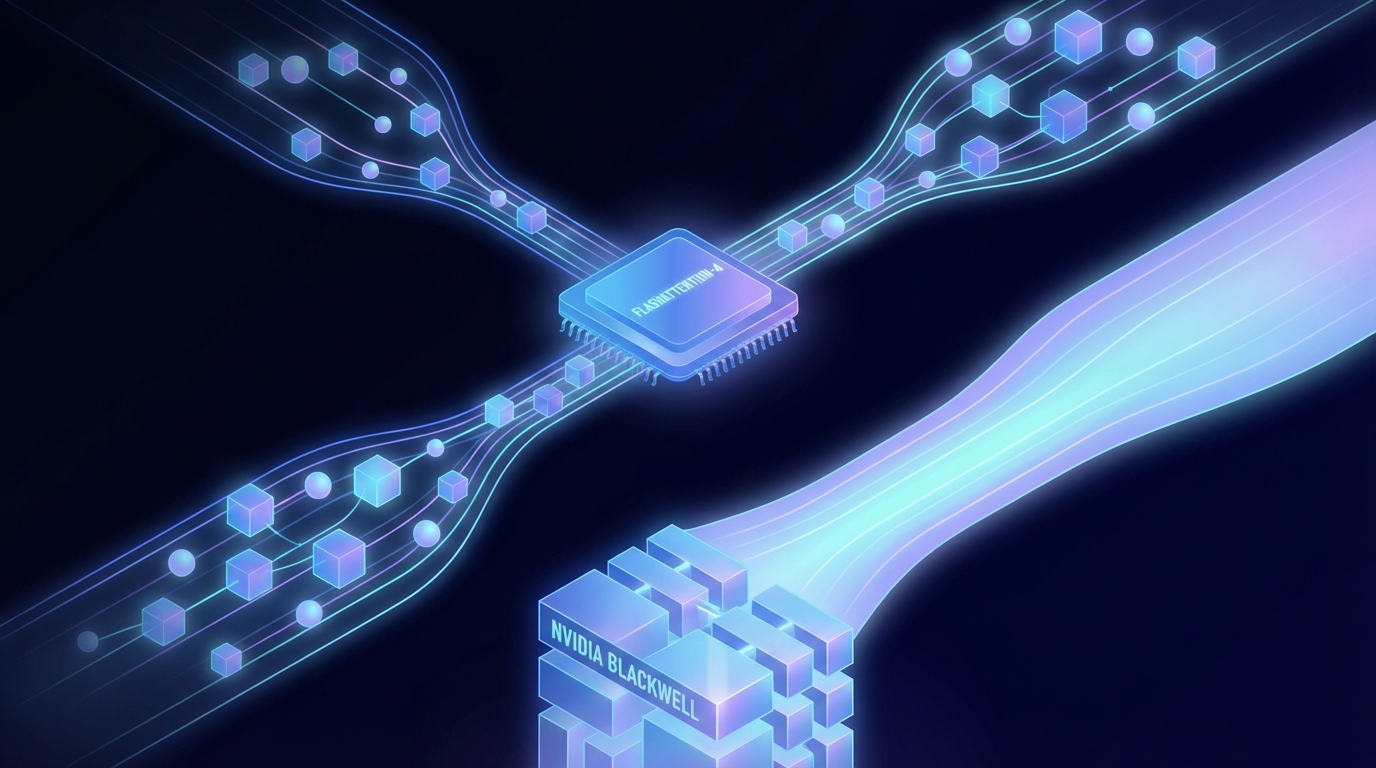

Superando Gargalos de Processamento e Memória com FlashAttention-4 na Arquitetura NVIDIA Blackwell

Imagem gerada por Gemini AI

A arquitetura Transformer é fundamental para a ascensão da inteligência artificial generativa, possibilitando o desenvolvimento de grandes modelos de linguagem (LLMs) como GPT, DeepSeek e Llama. Essa arquitetura melhora a eficiência de processamento e a compreensão contextual, resultando em avanços significativos nas tarefas de processamento de linguagem natural. As implicações para as aplicações de IA são profundas, já que os transformers permitem interações mais sutis e responsivas em diversos setores, desde atendimento ao cliente até criação de conteúdo.

Superando Gargalos de Computação e Memória com FlashAttention-4 na NVIDIA Blackwell

A NVIDIA apresentou o FlashAttention-4, um avanço destinado a otimizar a eficiência de computação e memória para modelos de transformadores, especialmente para grandes modelos de linguagem (LLMs) como o GPT e o Llama.

O FlashAttention-4 enfrenta desafios nas mecânicas de atenção tradicionais, que muitas vezes enfrentam limitações no uso de memória e na velocidade computacional à medida que os tamanhos dos modelos crescem. Esta implementação permite que modelos maiores sejam treinados e implantados de forma mais eficiente.

As principais características do FlashAttention-4 incluem:

- Eficiência de Memória Aprimorada: Reduz a carga de memória para cálculos de atenção, permitindo que modelos maiores se encaixem no hardware existente.

- Velocidade Aprimorada: Acelera significativamente os processos de treinamento e inferência para modelos de transformadores.

- Integração Fluida com Blackwell: Projetado para aproveitar ao máximo as melhorias oferecidas pelas próximas GPUs Blackwell.

Os primeiros benchmarks indicam que modelos que utilizam o FlashAttention-4 alcançam taxas de rendimento mais altas, reduzindo o tempo e os recursos necessários para o treinamento. À medida que a demanda por modelos de IA poderosos cresce, este avanço pode levar a melhorias significativas nas capacidades de compreensão e geração de linguagem natural.

Tópicos relacionados:

📰 Fonte original: https://developer.nvidia.com/blog/overcoming-compute-and-memory-bottlenecks-with-flashattention-4-on-nvidia-blackwell/

Todos os direitos e créditos pertencem ao editor original.