Jet-RL: Habilitando Aprendizado por Reforço On-Policy FP8 com Precisão Unificada de Treinamento e Execução

Imagem gerada por Gemini AI

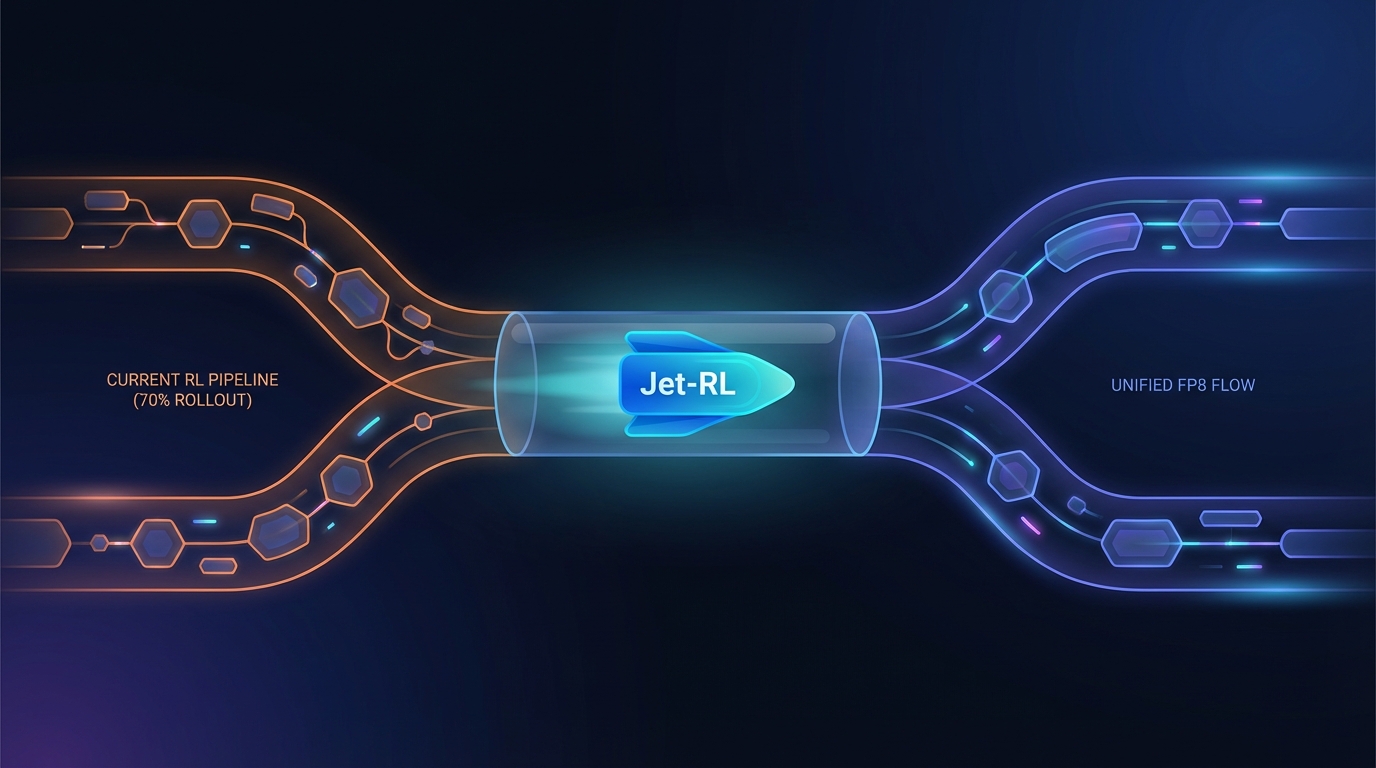

Pesquisas destacam as ineficiências das atuais pipelines de aprendizado por reforço (RL) para grandes modelos de linguagem, onde as fases de rollout consomem mais de 70% do tempo de treinamento. Um estudo revela que a estratégia comum de BF16 + FP8 resulta em instabilidade e perda de precisão. Com a introdução do Jet-RL, que utiliza uma precisão unificada em FP8 tanto para treinamento quanto para rollout, foi possível melhorar a eficiência em até 41% e estabilizar a convergência, com impacto mínimo na precisão.

Jet-RL Revoluciona o Aprendizado por Reforço com Treinamento Unificado em FP8

Jet-RL é uma nova estrutura que simplifica o processo de treinamento do aprendizado por reforço (RL) utilizando precisão FP8 tanto para as fases de treinamento quanto de rollout. Essa abordagem melhora a eficiência computacional, abordando o alto consumo de recursos em pipelines de RL tradicionais.

As metodologias atuais que utilizam precisão BF16 para treinamento e FP8 para rollout frequentemente sofrem de instabilidade e colapso de precisão durante rollouts de longo prazo. O Jet-RL minimiza discrepâncias numéricas entre treinamento e inferência, eliminando a necessidade de calibração entre etapas.

Métricas de Desempenho do Jet-RL

Experimentos extensivos confirmam a eficácia do Jet-RL, demonstrando:

- Aceleração de Rollout: Até 33% mais rápidos nos tempos de rollout.

- Aceleração de Treinamento: Até 41% mais rápidos nas fases de treinamento.

- Aceleração de Ponta a Ponta: 16% de aceleração geral em comparação ao treinamento tradicional em BF16.

Essas melhorias ocorrem enquanto se mantém uma convergência estável em várias tarefas, com degradação de precisão desprezível, marcando um avanço crucial para desenvolvedores que trabalham com grandes modelos de linguagem (LLMs).

Abordando a Instabilidade do Treinamento

A pesquisa destaca que a instabilidade na estratégia BF16 + FP8 se deve à natureza off-policy do método de treinamento, dificultando aplicações de RL em tarefas de raciocínio complexo. Ao adotar a abordagem unificada do Jet-RL, os profissionais podem esperar um processo de treinamento mais confiável, melhorando o desempenho dos LLMs em aplicações do mundo real.

Tópicos relacionados:

📰 Fonte original: https://arxiv.org/abs/2601.14243v1

Todos os direitos e créditos pertencem ao editor original.