Explorando a Colocação de Transformers em Autoencoders Variacionais para Geração de Dados Tabulares

Imagem gerada por Gemini AI

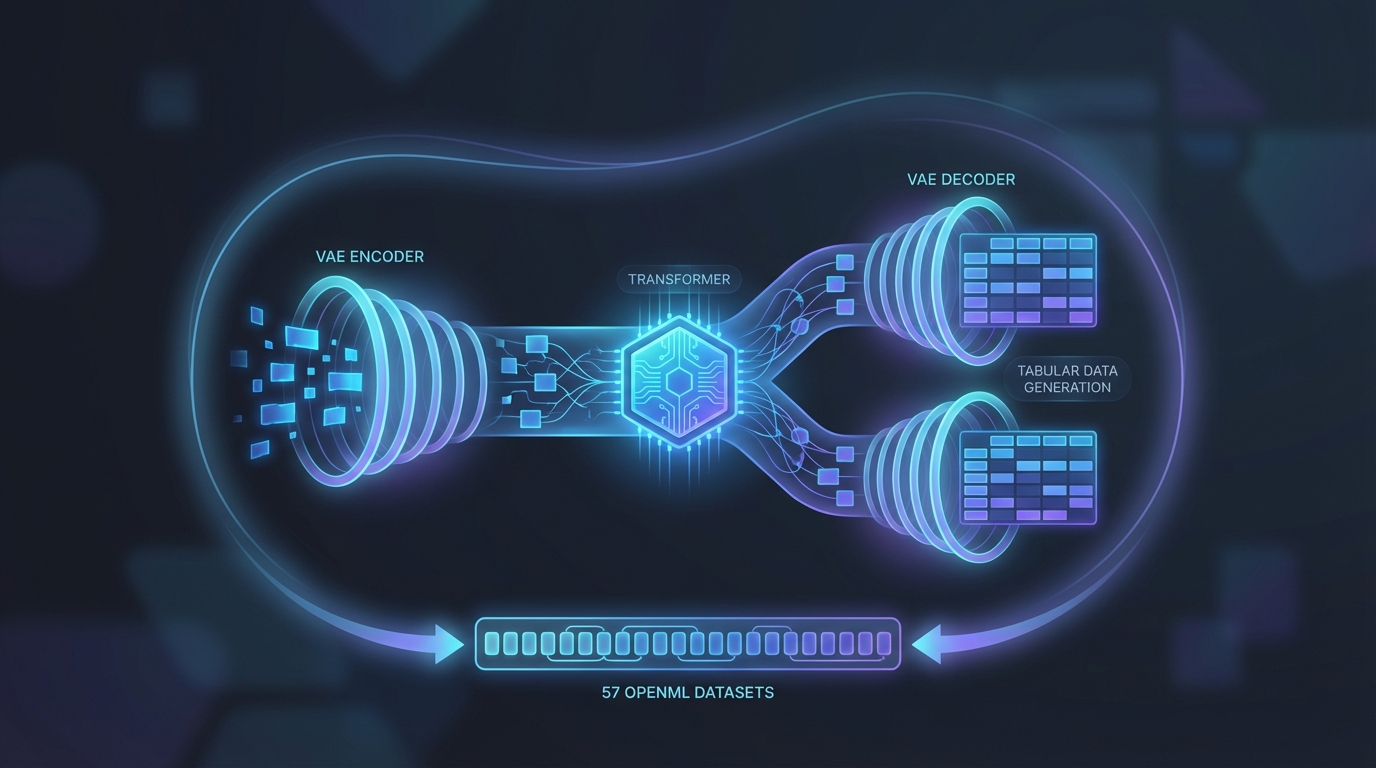

Um estudo investiga a integração de Transformers em Autoencoders Variacionais (VAEs) para aprimorar seu desempenho na modelagem de dados tabulares. Ao testar 57 conjuntos de dados do OpenML CC18, os pesquisadores descobriram que a inclusão de Transformers nos componentes latentes e no decodificador cria um trade-off entre fidelidade e diversidade. Além disso, observaram que a relação de entrada e saída do decodificador é quase linear, revelando padrões consistentes nos blocos de Transformer.

Transformers Melhoram Autoencoders Variacionais para Geração de Dados Tabulares

Pesquisas recentes revelam o potencial de integrar modelos Transformer aos Autoencoders Variacionais (VAEs) para a geração de dados tabulares. Analisando 57 conjuntos de dados da suíte OpenML CC18, o estudo fornece insights sobre as adaptações estruturais dos VAEs com Transformers.

Principais Descobertas do Estudo

O estudo destaca duas conclusões principais:

- Posicionamento do Transformer: A posição dos Transformers dentro das representações latentes e do decodificador cria um equilíbrio entre fidelidade e diversidade nos dados gerados.

- Similaridade de Blocos: Observa-se uma similaridade significativa entre blocos consecutivos do Transformer, particularmente no decodificador, onde a relação entrada-saída se aproxima da linearidade.

Essas descobertas sugerem que, embora os Transformers aumentem a capacidade gerativa dos VAEs, um posicionamento cuidadoso é essencial para equilibrar qualidade e variabilidade nos dados gerados.

Tópicos relacionados:

📰 Fonte original: https://arxiv.org/abs/2601.20854v1

Todos os direitos e créditos pertencem ao editor original.