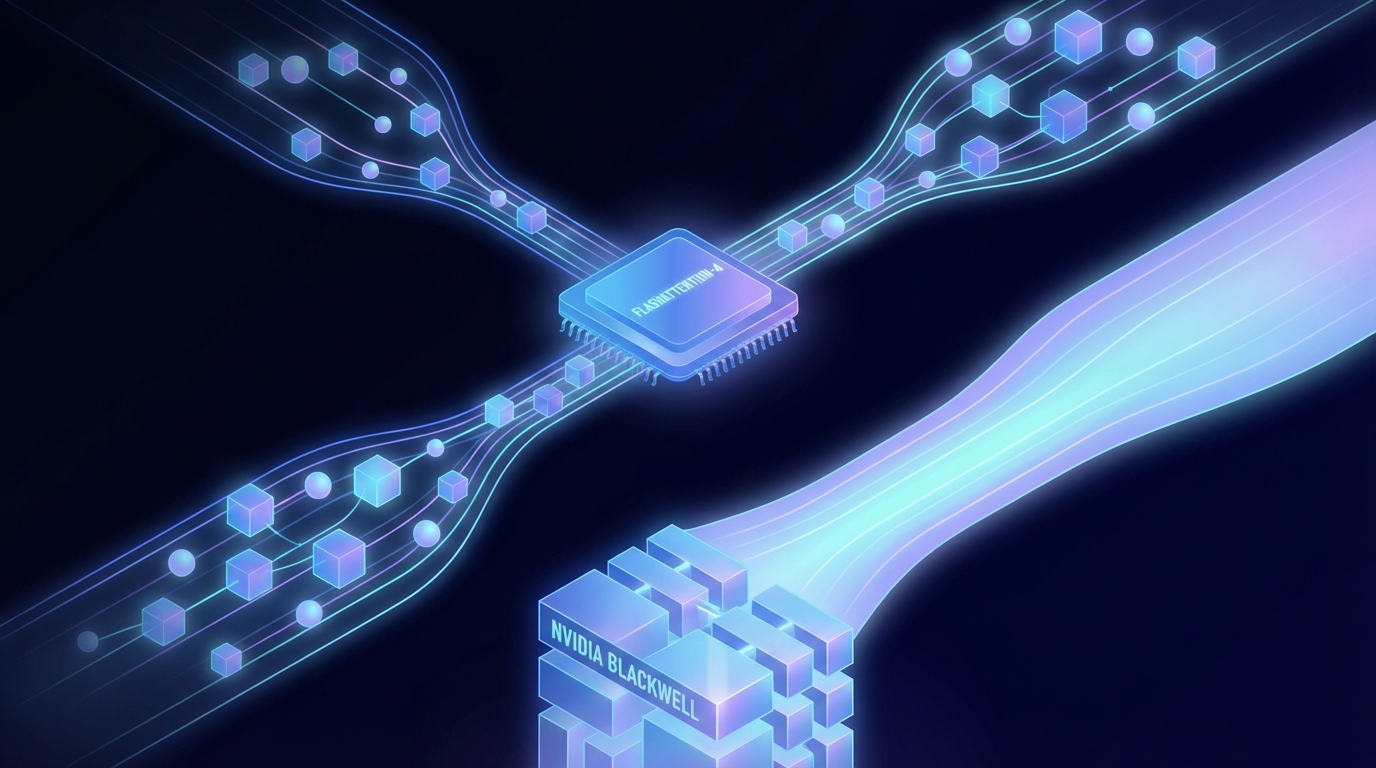

Surmonter les goulots d'étranglement en calcul et en mémoire avec FlashAttention-4 sur NVIDIA Blackwell

Image générée par Gemini AI

L'architecture des transformateurs joue un rôle clé dans l'essor de l'IA générative, facilitant le développement de modèles de langage de grande taille (LLM) tels que GPT, DeepSeek et Llama. Cette architecture améliore l'efficacité du traitement et la compréhension contextuelle, entraînant des avancées significatives dans les tâches de traitement du langage naturel. Les implications pour les applications de l'IA sont profondes, car les transformateurs permettent des interactions plus nuancées et réactives dans divers secteurs, allant du service client à la création de contenu.

Surmonter les goulots d'étranglement en calcul et en mémoire avec FlashAttention-4 sur NVIDIA Blackwell

NVIDIA a dévoilé FlashAttention-4, une avancée visant à optimiser l'efficacité en calcul et en mémoire pour les modèles de transformateurs, en particulier pour les grands modèles linguistiques (LLM) comme GPT et Llama.

FlashAttention-4 s'attaque aux défis des mécanismes d'attention traditionnels, qui rencontrent souvent des limitations en matière d'utilisation de la mémoire et de vitesse de calcul à mesure que les tailles des modèles augmentent. Cette mise en œuvre permet d'entraîner et de déployer des modèles plus grands de manière plus efficace.

Les caractéristiques clés de FlashAttention-4 incluent :

- Efficacité Mémoire Améliorée : Réduit l'empreinte mémoire pour les calculs d'attention, permettant à des modèles plus grands de s'adapter au matériel existant.

- Vitesse Améliorée : Accélère de manière significative les processus d'entraînement et d'inférence pour les modèles de transformateurs.

- Intégration Transparente avec Blackwell : Conçu pour tirer pleinement parti des améliorations offertes par les futurs GPU Blackwell.

Les premiers benchmarks indiquent que les modèles utilisant FlashAttention-4 atteignent des taux de débit plus élevés, réduisant le temps et les ressources nécessaires pour l'entraînement. À mesure que la demande pour des modèles d'IA puissants augmente, cette avancée pourrait conduire à des améliorations significatives dans les capacités de compréhension et de génération du langage naturel.

Sujets connexes :

📰 Source originale : https://developer.nvidia.com/blog/overcoming-compute-and-memory-bottlenecks-with-flashattention-4-on-nvidia-blackwell/

Tous les droits et crédits appartiennent à l'éditeur original.