PixelGen : La diffusion de pixels surpasse la diffusion latente grâce à la perte perceptuelle

Image générée par Gemini AI

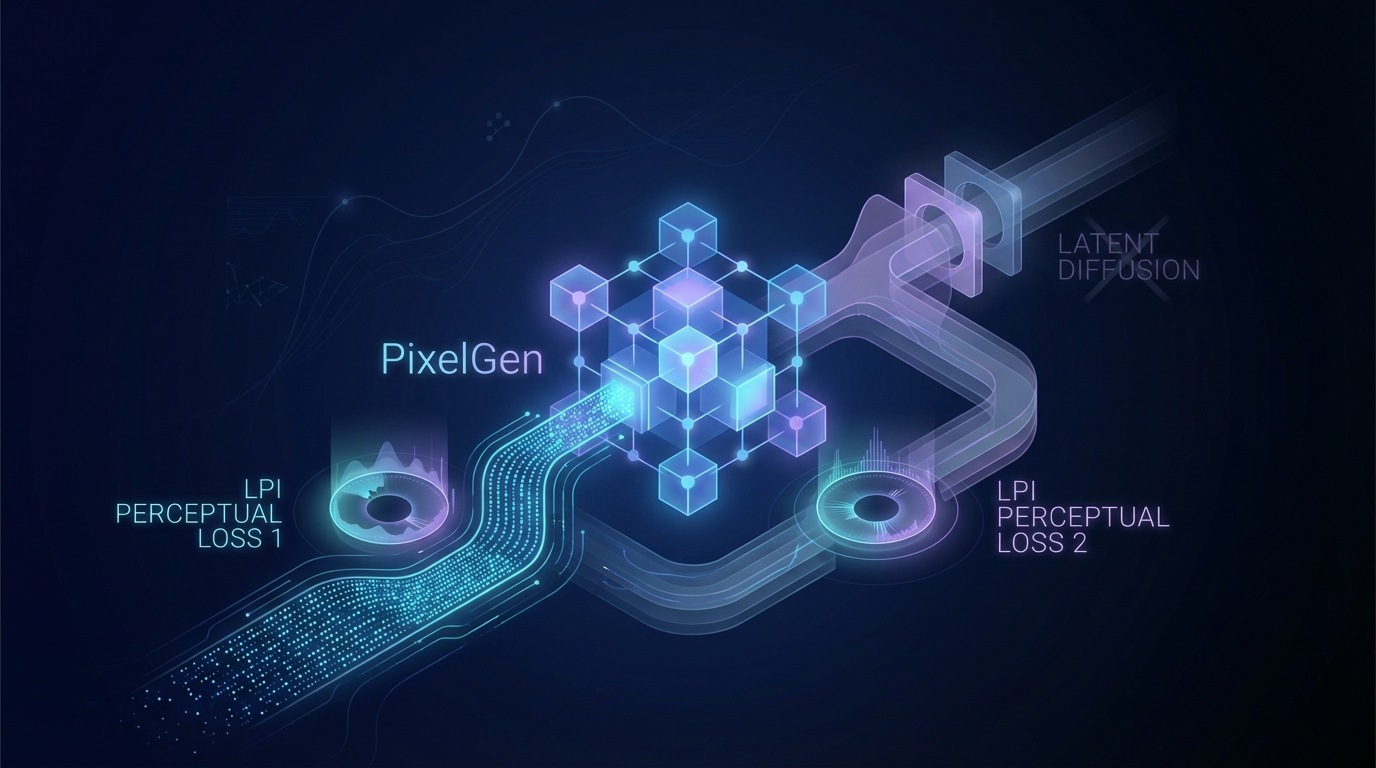

PixelGen est un nouveau cadre de diffusion de pixels qui contourne les limitations des modèles de diffusion latente traditionnels en optimisant directement dans l'espace pixel. Il utilise deux pertes perceptuelles—LPIPS pour les motifs locaux et DINO pour la sémantique globale—afin d'améliorer la qualité des images. PixelGen atteint un FID compétitif de 5,11 sur ImageNet-256 avec seulement 80 époques d'entraînement et démontre de solides performances dans des tâches de génération d'images à partir de texte à grande échelle, comme en témoigne un score GenEval de 0,79. Cette approche élimine le besoin de VAE et d'étapes auxiliaires, offrant ainsi un modèle génératif à la fois simplifié et efficace. Le code complet est disponible sur GitHub.

PixelGen Surpasse la Diffusion Latente grâce à une Perte Perceptuelle Innovante

PixelGen, un nouveau cadre de diffusion de pixels, a démontré des performances supérieures par rapport aux modèles de diffusion latente traditionnels en intégrant une supervision perceptuelle. Cette avancée permet une génération d'images directe dans l'espace pixel, éliminant les artefacts et les goulets d'étranglement associés aux processus de diffusion latente en deux étapes.

Métriques de Performance Clés

Lors de tests rigoureux, PixelGen a atteint un score de Fréchet Inception Distance (FID) de 5.11 sur le jeu de données ImageNet-256, sans utiliser de guidance sans classificateur et en n'effectuant que 80 époques d'entraînement. Cela constitue une amélioration significative par rapport aux références de diffusion latente existantes.

De plus, PixelGen a montré des capacités d'évolutivité impressionnantes dans les tâches de génération de texte à image, atteignant un score GenEval de 0.79. La conception du cadre élimine le besoin d'autoencodeurs variationnels (VAE) et de représentations latentes, simplifiant ainsi le processus génératif.

Disponibilité

Les développeurs et chercheurs peuvent accéder au code publiquement sur ce dépôt GitHub.

Sujets connexes :

📰 Source originale : https://arxiv.org/abs/2602.02493v1

Tous les droits et crédits appartiennent à l'éditeur original.