Jet-RL : Activation de l'apprentissage par renforcement FP8 en politique avec un entraînement unifié et un flux de précision de déploiement

Image générée par Gemini AI

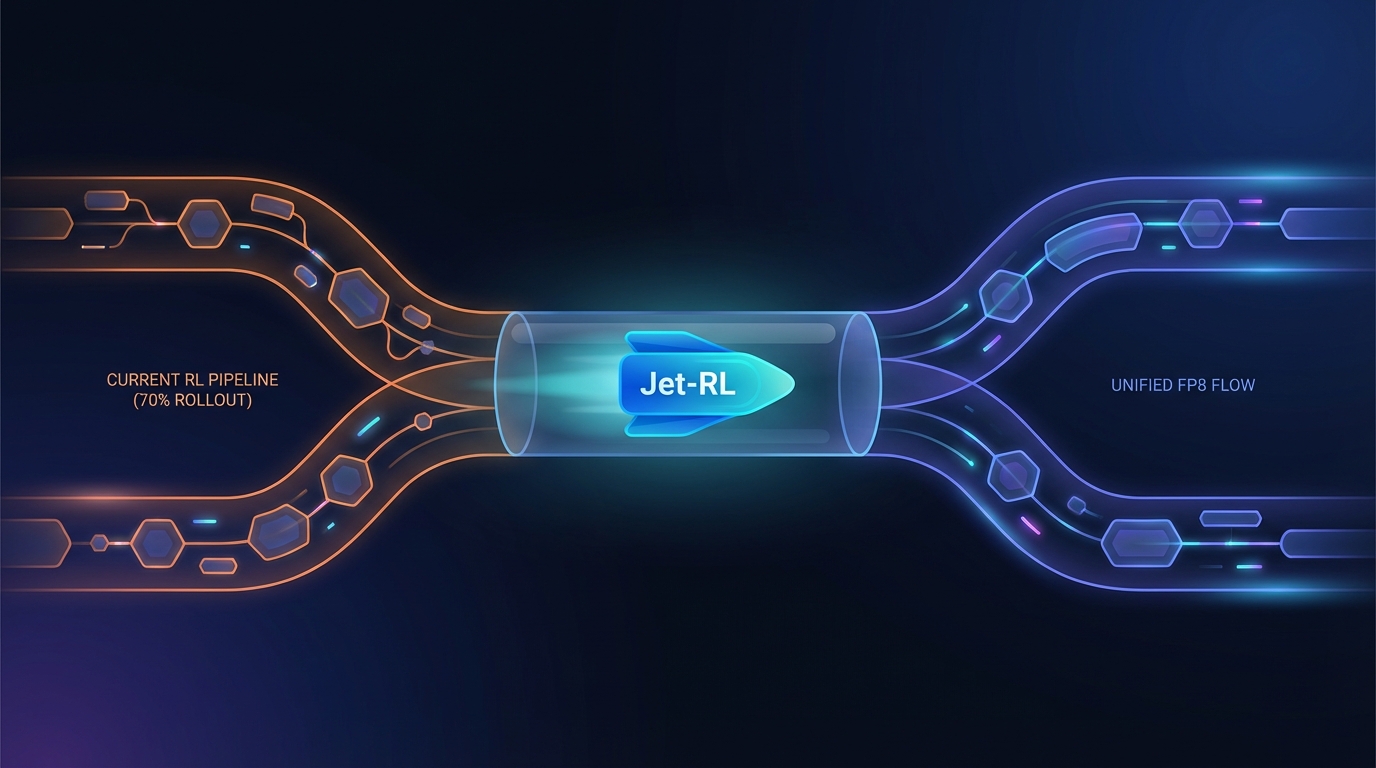

Des recherches mettent en lumière les inefficacités des pipelines actuels d'apprentissage par renforcement (RL) pour les grands modèles de langage, où les phases de déploiement représentent plus de 70 % du temps d'entraînement. Une étude révèle que la stratégie courante utilisant une combinaison de BF16 et FP8 entraîne une instabilité et une perte de précision. En introduisant Jet-RL, qui utilise une précision FP8 unifiée pour l'entraînement et le déploiement, on améliore l'efficacité jusqu'à 41 % et on stabilise la convergence avec un impact minimal sur la précision.

Jet-RL Révolutionne l'Apprentissage par Renforcement avec un Entraînement Unifié en FP8

Jet-RL est un cadre novateur qui rationalise le processus d'entraînement en apprentissage par renforcement (RL) en utilisant la précision FP8 pour les phases d'entraînement et de déploiement. Cette approche améliore l'efficacité computationnelle, répondant à la consommation élevée de ressources dans les pipelines RL traditionnels.

Les méthodologies actuelles utilisant la précision BF16 pour l'entraînement et FP8 pour le déploiement souffrent souvent d'instabilité et d'effondrement de précision lors de déploiements à long terme. Jet-RL minimise les écarts numériques entre l'entraînement et l'inférence, éliminant ainsi le besoin de calibration entre les étapes.

Métriques de Performance de Jet-RL

Des expériences approfondies confirment l'efficacité de Jet-RL, mettant en avant :

- Accélération du Déploiement : Des temps de déploiement jusqu'à 33 % plus rapides.

- Accélération de l'Entraînement : Des phases d'entraînement jusqu'à 41 % plus rapides.

- Accélération de Bout en Bout : 16 % d'accélération globale par rapport à l'entraînement traditionnel en BF16.

Ces améliorations se produisent tout en maintenant une convergence stable à travers diverses tâches, avec une dégradation de précision négligeable, marquant un avancement crucial pour les développeurs travaillant avec de grands modèles linguistiques (LLM).

Répondre à l'Instabilité de l'Entraînement

La recherche met en lumière que l'instabilité de la stratégie BF16 + FP8 est due à la nature hors politique de la méthode d'entraînement, entravant les applications RL dans des tâches de raisonnement complexes. En adoptant l'approche unifiée de Jet-RL, les praticiens peuvent s'attendre à un processus d'entraînement plus fiable, améliorant la performance des LLM dans des applications réelles.

Sujets connexes :

📰 Source originale : https://arxiv.org/abs/2601.14243v1

Tous les droits et crédits appartiennent à l'éditeur original.