Exploration du placement des transformateurs dans les autoencodeurs variationnels pour la génération de données tabulaires

Image générée par Gemini AI

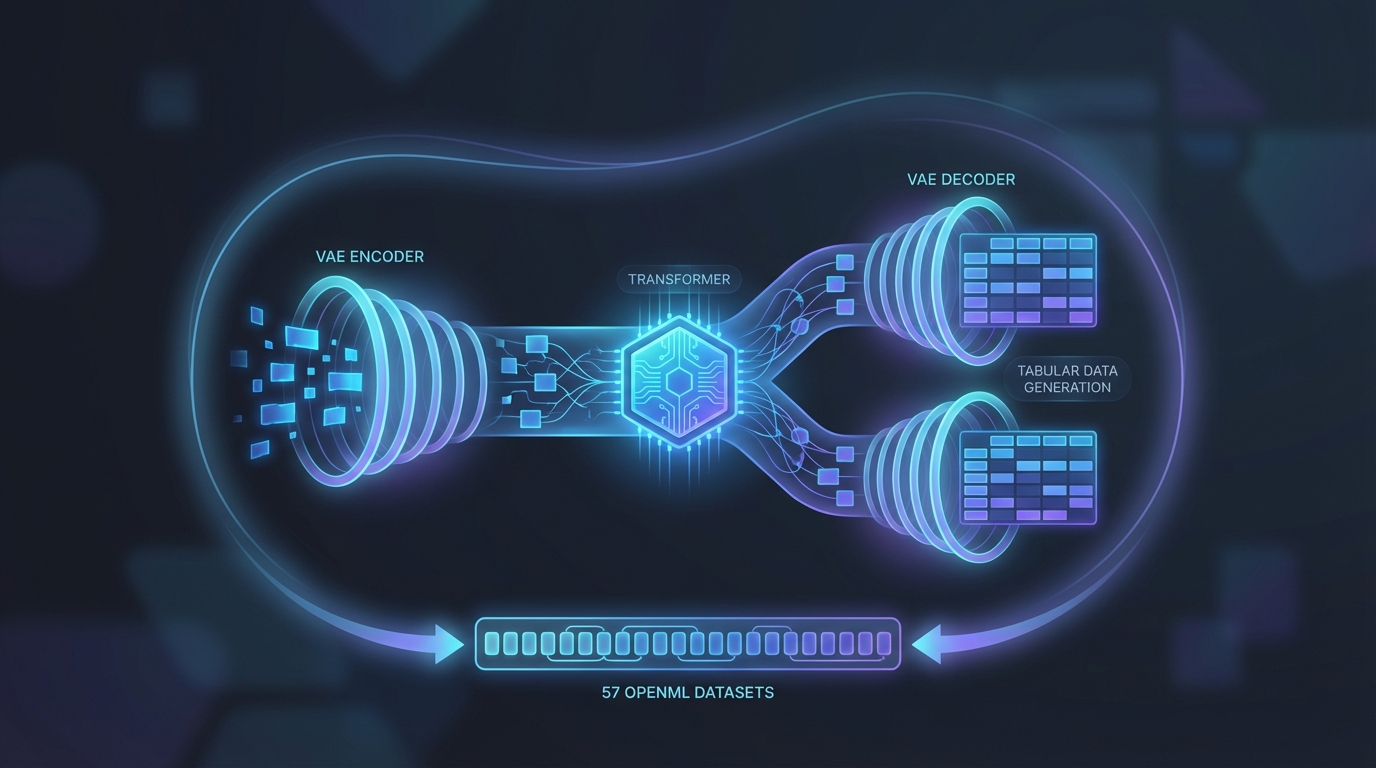

Une étude examine l'intégration des Transformers dans les Autoencodeurs Variationnels (VAEs) afin d'améliorer leurs performances dans la modélisation des données tabulaires. En testant 57 jeux de données du OpenML CC18, les chercheurs ont constaté que l'insertion de Transformers dans les composants latents et de décodage engendre un compromis entre fidélité et diversité. Par ailleurs, ils ont observé que la relation entrée-sortie du décodeur est presque linéaire, mettant en lumière des schémas cohérents au sein des blocs de Transformers.

Les Transformers améliorent les Autoencodeurs Variationnels pour la génération de données tabulaires

Des recherches récentes révèlent le potentiel d'intégration des modèles Transformer dans les Autoencodeurs Variationnels (VAE) pour générer des données tabulaires. En analysant 57 ensembles de données de la suite OpenML CC18, l'étude fournit des informations sur les adaptations structurelles des VAE avec les Transformers.

Principales conclusions de l'étude

L'étude met en avant deux conclusions principales :

- Placement des Transformers : Le positionnement des Transformers au sein des représentations latentes et décodeurs crée un compromis entre fidélité et diversité des données générées.

- Similarité des blocs : Une similarité significative est observée entre les blocs consécutifs du Transformer, en particulier dans le décodeur, où la relation entrée-sortie s'approche de la linéarité.

Ces résultats suggèrent que bien que les Transformers améliorent la capacité générative des VAE, un placement soigneux est essentiel pour équilibrer qualité et variabilité des données générées.

Sujets connexes :

📰 Source originale : https://arxiv.org/abs/2601.20854v1

Tous les droits et crédits appartiennent à l'éditeur original.