Dépendance à la taille de l'ensemble des méthodes de post-traitement en apprentissage profond visant à minimiser un score (in)juste : exemples motivants et solution de preuve de concept

Image générée par Gemini AI

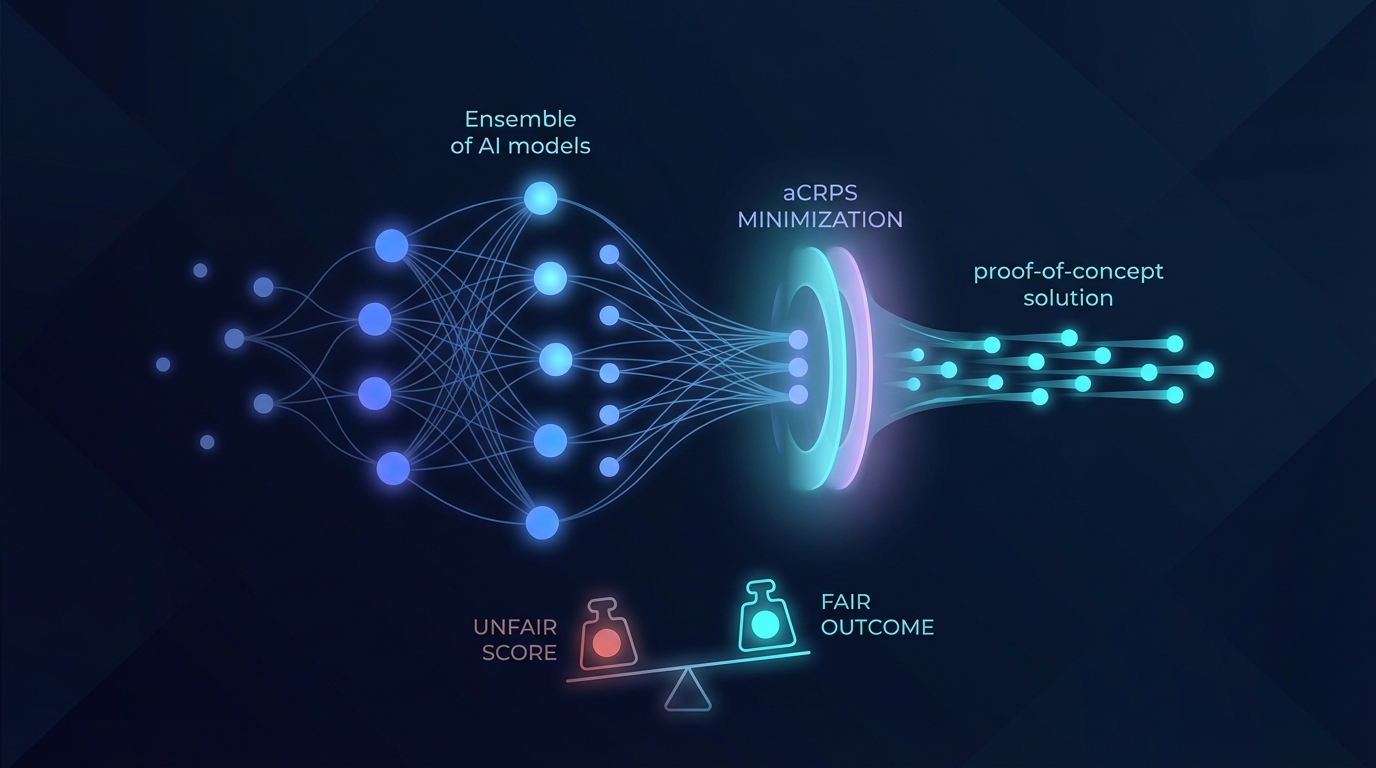

L'article aborde les défis liés à l'utilisation du score de probabilité continue classé ajusté (aCRPS) pour l'entraînement des prévisions d'ensemble, notamment lorsque des dépendances structurelles entre les membres sont introduites. Il met en lumière deux approches problématiques : la calibration linéaire des membres et une méthode d'apprentissage profond susceptible de créer des problèmes de sur-dispersion. Les auteurs proposent les "transformers de trajectoire", adaptant le cadre PoET pour maintenir l'indépendance conditionnelle dans les prévisions. Cette méthode réduit efficacement les biais systématiques et améliore la fiabilité des prévisions hebdomadaires de température moyenne issues du système ECMWF, quel que soit la taille de l'ensemble (3 contre 9 membres lors de l'entraînement ; 9 contre 100 en temps réel).

Une nouvelle recherche met en évidence la dépendance à la taille de l'ensemble dans les méthodes de post-traitement en apprentissage profond

Des résultats récents révèlent que l'efficacité de certaines méthodes de post-traitement en apprentissage profond dans les prévisions d'ensemble peut être significativement influencée par la taille de l'ensemble. L'étude se concentre sur des scores équitables, en particulier le score de probabilité continue classé ajusté (aCRPS), conçu pour évaluer les prévisions d'ensemble sans biais concernant la taille de l'ensemble.

La recherche examine deux approches visant à minimiser l'aCRPS attendu pour des ensembles finis :

- Calibration linéaire membre par membre : Cette méthode associe les membres de l'ensemble grâce à une dépendance partagée sur la moyenne de l'ensemble échantillon.

- Apprentissage profond avec attention auto-référentielle : Cette technique relie les membres de l'ensemble en utilisant des mécanismes d'attention auto-référentielle à travers la dimension de l'ensemble.

Les deux méthodes ont montré une sensibilité à la taille de l'ensemble, indiquant que les améliorations de l'aCRPS pourraient être trompeuses, souvent accompagnées d'une fiabilité systématique et d'une surdispersion dans les prévisions.

Les transformateurs de trajectoire comme solution

Pour aborder ces problèmes, les chercheurs ont introduit les transformateurs de trajectoire, une adaptation de preuve de concept du cadre de Post-traitement des ensembles avec des transformateurs (PoET). Cette approche utilise l'attention auto-référentielle à travers les délais tout en maintenant l'indépendance conditionnelle nécessaire pour les évaluations aCRPS.

Appliqués aux prévisions hebdomadaires de température moyenne à 2 mètres du système de prévision sub-saisonnier de l'ECMWF, les transformateurs de trajectoire ont efficacement réduit les biais systématiques du modèle et amélioré la fiabilité des prévisions, quelle que soit la taille de l'ensemble utilisée lors de l'entraînement.

Sujets connexes :

📰 Source originale : https://arxiv.org/abs/2602.15830v1

Tous les droits et crédits appartiennent à l'éditeur original.