Dataset Multi-RADS de rapports de radiologie synthétiques et évaluation comparative de 41 modèles de langage à poids ouverts et propriétaires

Image générée par Gemini AI

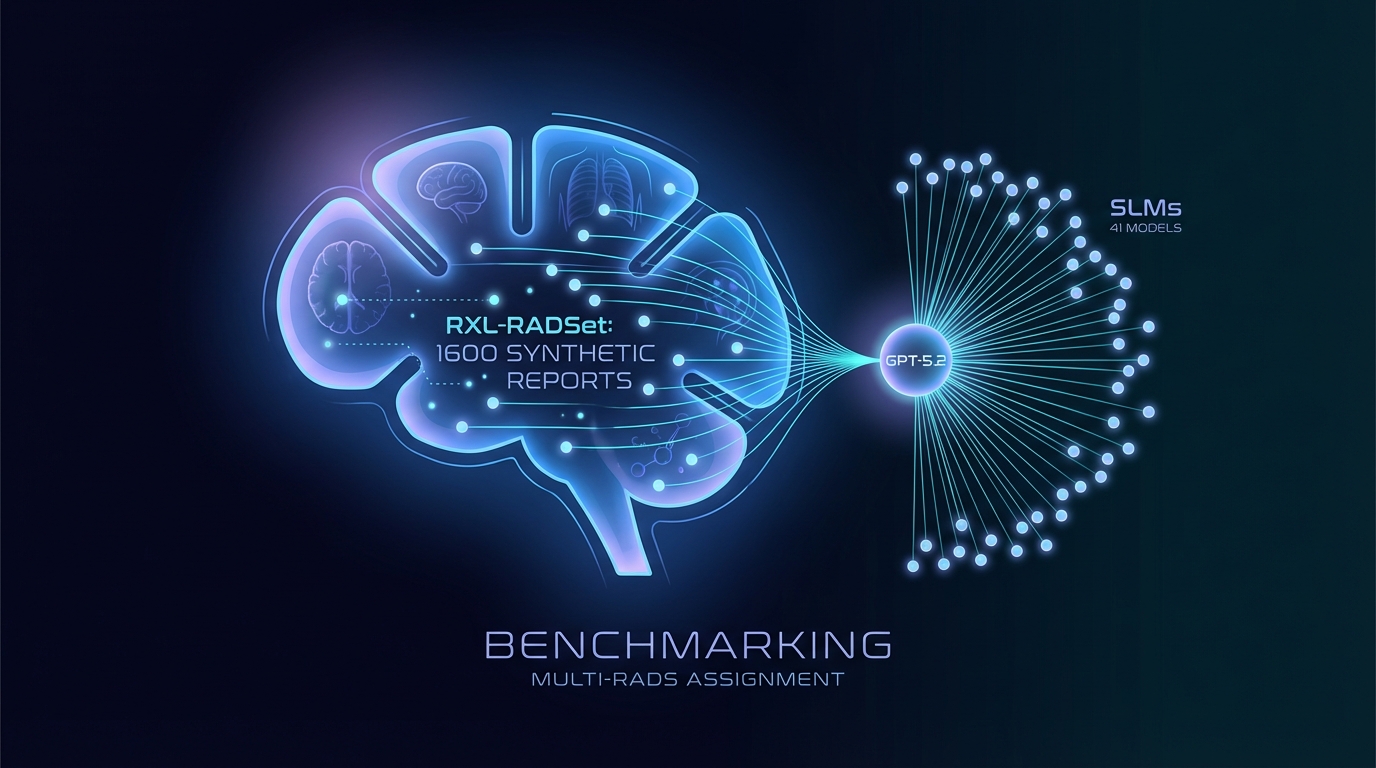

Des chercheurs ont développé RXL-RADSet, un ensemble de données composé de 1 600 rapports de radiologie synthétiques, afin d'améliorer l'attribution automatisée des systèmes de classification RADS. Cette étude compare 41 petits modèles de langage (SLMs) avec GPT-5.2 en termes de précision et de validité. GPT-5.2 a atteint une validité de 99,8 % et une précision de 81,1 %, surpassant ainsi les SLMs, qui ont affiché une validité de 96,8 % et une précision de 61,1 %. Les performances se sont améliorées avec la taille des modèles et des invites guidées, mais des défis persistent pour les cadres RADS plus complexes.

Données de Référence Multi-RADS Publiées pour les Modèles de Langue en Radiologie

Un nouveau jeu de données visant à améliorer la communication des risques en radiologie a été lancé, présentant un benchmark de rapports radiologiques synthétiques à travers plusieurs Systèmes de Reporting et de Données (RADS). Connu sous le nom de RXL-RADSet, il comprend 1 600 rapports synthétiques vérifiés par des radiologues, conçus pour évaluer la performance de divers modèles de langue dans l'attribution automatisée de RADS.

Évaluation de la Performance des Modèles de Langue

L'étude a évalué 41 modèles de langue petits et quantifiés (SLMs) avec des tailles de paramètres allant de 0,135 à 32 milliards, en plus du modèle propriétaire GPT-5.2. Les principaux critères d'évaluation étaient la validité et la précision des attributions de RADS.

Les résultats ont indiqué que GPT-5.2 a atteint 99,8% de validité et 81,1% de précision sur 1 600 prédictions. En revanche, les SLMs regroupés ont produit une validité de 96,8% et une précision de 61,1% sur un total de 65 600 prédictions. Les SLMs les plus performants dans la plage de 20 à 32 milliards de paramètres ont approché 99% de validité et atteint des taux de précision moyens à élevés dans les 70%.

L'analyse a révélé une tendance selon laquelle la performance s'améliorait avec la taille du modèle, notant particulièrement un point d'inflexion entre les modèles de moins de 1 milliard de paramètres et ceux de 10 milliards ou plus. Cependant, la complexité des cadres RADS a eu un impact significatif sur la performance, la complexité plus élevée entraînant des défis de classification plutôt que des sorties invalides.

Une incitation guidée a amélioré à la fois la validité et la précision, les scores de validité atteignant 99,2% comparativement à 96,7% avec une incitation zéro-shot.

Sujets connexes :

📰 Source originale : https://arxiv.org/abs/2601.03232v1

Tous les droits et crédits appartiennent à l'éditeur original.