Superando cuellos de botella en computación y memoria con FlashAttention-4 en NVIDIA Blackwell

Imagen generada por Gemini AI

La arquitectura de transformadores es fundamental en el auge de la inteligencia artificial generativa, permitiendo el desarrollo de modelos de lenguaje de gran tamaño (LLMs) como GPT, DeepSeek y Llama. Esta arquitectura mejora la eficiencia en el procesamiento y la comprensión contextual, lo que ha llevado a avances significativos en las tareas de procesamiento del lenguaje natural. Las implicaciones para las aplicaciones de IA son profundas, ya que los transformadores permiten interacciones más matizadas y receptivas en diversos sectores, desde el servicio al cliente hasta la creación de contenido.

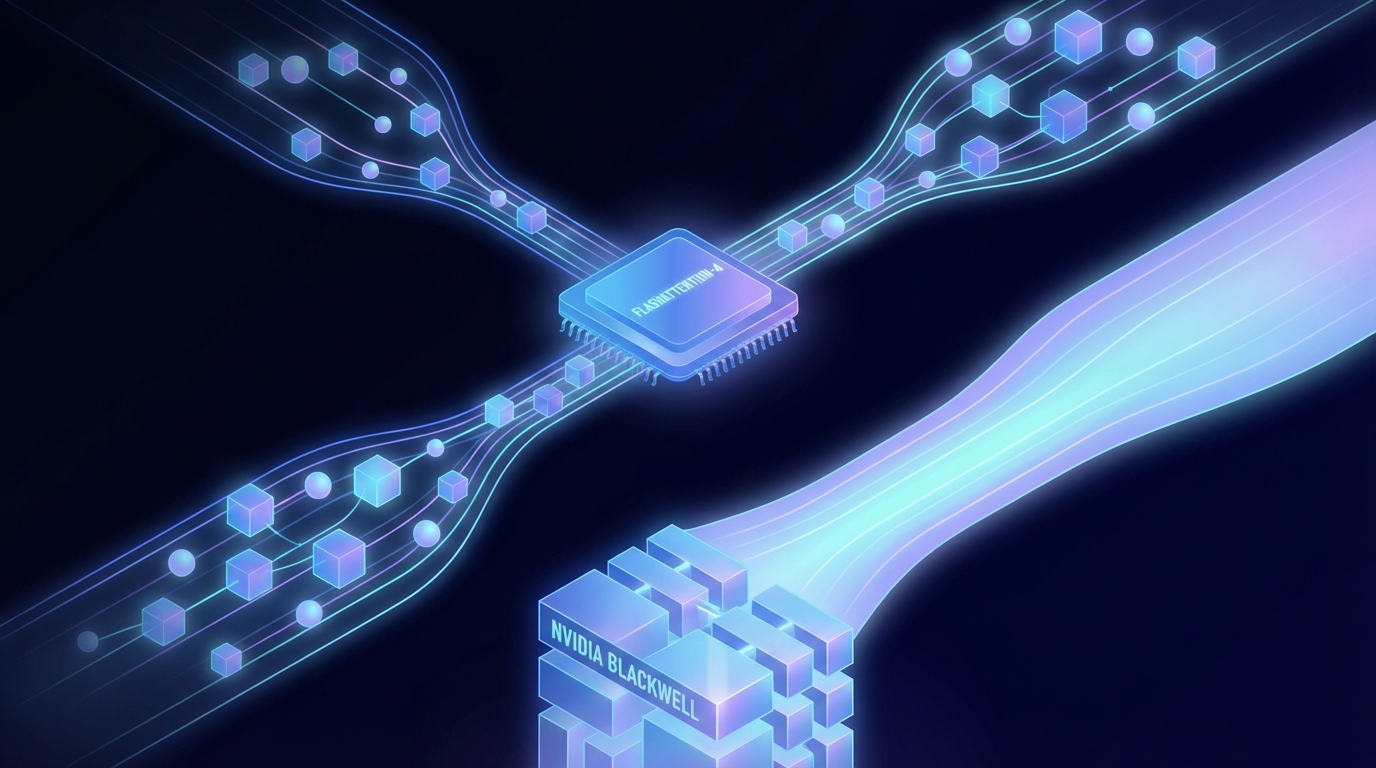

Superando los Cuellos de Botella de Cómputo y Memoria con FlashAttention-4 en NVIDIA Blackwell

NVIDIA ha presentado FlashAttention-4, un avance destinado a optimizar la eficiencia de cómputo y memoria para modelos de transformadores, particularmente para modelos de lenguaje grande (LLMs) como GPT y Llama.

FlashAttention-4 aborda los desafíos en los mecanismos de atención tradicionales, que a menudo enfrentan limitaciones en el uso de memoria y la velocidad de cómputo a medida que aumentan los tamaños de los modelos. Esta implementación permite que modelos más grandes se entrenen y desplieguen de manera más eficiente.

Las características clave de FlashAttention-4 incluyen:

- Eficiencia de Memoria Mejorada: Reduce la huella de memoria para los cálculos de atención, permitiendo que modelos más grandes se ajusten al hardware existente.

- Velocidad Mejorada: Acelera significativamente los procesos de entrenamiento e inferencia para modelos de transformadores.

- Integración Perfecta con Blackwell: Diseñado para aprovechar al máximo las mejoras ofrecidas por las próximas GPUs Blackwell.

Las primeras pruebas indican que los modelos que utilizan FlashAttention-4 logran tasas de rendimiento más altas, reduciendo el tiempo y los recursos necesarios para el entrenamiento. A medida que la demanda de modelos de IA potentes aumenta, este avance podría llevar a mejoras significativas en las capacidades de comprensión y generación del lenguaje natural.

Temas relacionados:

📰 Fuente original: https://developer.nvidia.com/blog/overcoming-compute-and-memory-bottlenecks-with-flashattention-4-on-nvidia-blackwell/

Todos los derechos y créditos pertenecen al editor original.