Jet-RL: Facilitando el Aprendizaje por Refuerzo On-Policy FP8 con un Entrenamiento Unificado y Flujo de Precisión en la Ejecución

Imagen generada por Gemini AI

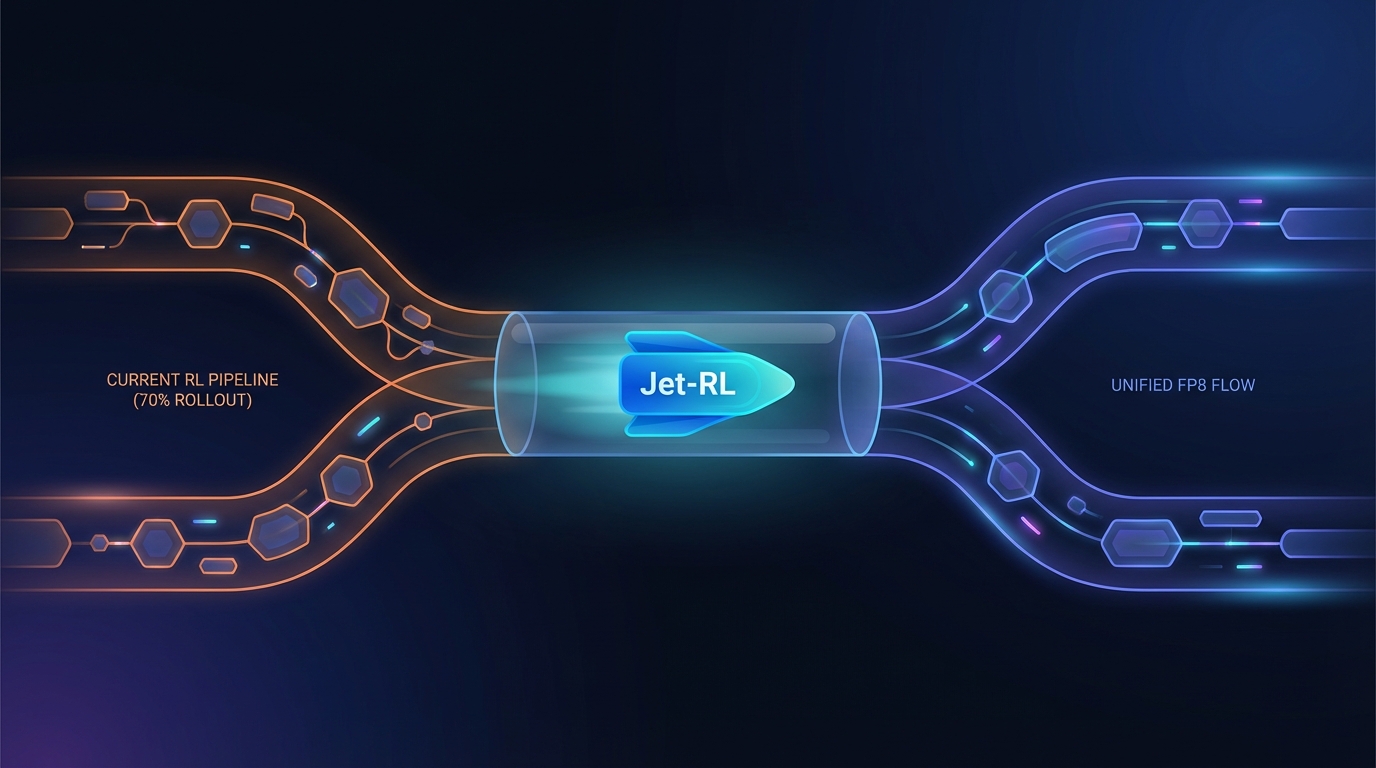

Investigaciones destacan las ineficiencias de los actuales flujos de trabajo de aprendizaje por refuerzo (RL) para modelos de lenguaje grandes, donde las fases de ejecución consumen más del 70% del tiempo de entrenamiento. Un estudio revela que la estrategia común de BF16 + FP8 provoca inestabilidad y pérdida de precisión. Al introducir Jet-RL, que utiliza una precisión FP8 unificada tanto para el entrenamiento como para la ejecución, se logra una mejora en la eficiencia de hasta un 41% y se estabiliza la convergencia con un impacto mínimo en la precisión.

Jet-RL Revoluciona el Aprendizaje por Refuerzo con Entrenamiento Unificado en FP8

Jet-RL es un marco novedoso que simplifica el proceso de entrenamiento en aprendizaje por refuerzo (RL) al utilizar precisión FP8 tanto para las fases de entrenamiento como de despliegue. Este enfoque mejora la eficiencia computacional, abordando el alto consumo de recursos en las tuberías tradicionales de RL.

Las metodologías actuales que utilizan precisión BF16 para el entrenamiento y FP8 para el despliegue a menudo sufren de inestabilidad y colapso en la precisión durante los despliegues de largo horizonte. Jet-RL minimiza las discrepancias numéricas entre el entrenamiento y la inferencia, eliminando la necesidad de calibración entre pasos.

Métricas de Rendimiento de Jet-RL

Extensos experimentos confirman la efectividad de Jet-RL, mostrando:

- Aceleración en el Despliegue: Hasta un 33% más rápidos en los tiempos de despliegue.

- Aceleración en el Entrenamiento: Hasta un 41% más rápidos en las fases de entrenamiento.

- Aceleración de Extremo a Extremo: 16% de aceleración general en comparación con el entrenamiento tradicional en BF16.

Estas mejoras se producen mientras se mantiene una convergencia estable en diversas tareas, con una degradación de precisión negligible, marcando un avance crucial para los desarrolladores que trabajan con modelos de lenguaje grandes (LLMs).

Abordando la Inestabilidad en el Entrenamiento

La investigación destaca que la inestabilidad en la estrategia BF16 + FP8 se debe a la naturaleza fuera de política del método de entrenamiento, obstaculizando las aplicaciones de RL en tareas de razonamiento complejo. Al adoptar el enfoque unificado de Jet-RL, los profesionales pueden esperar un proceso de entrenamiento más confiable, mejorando el rendimiento de los LLM en aplicaciones del mundo real.

Temas relacionados:

📰 Fuente original: https://arxiv.org/abs/2601.14243v1

Todos los derechos y créditos pertenecen al editor original.