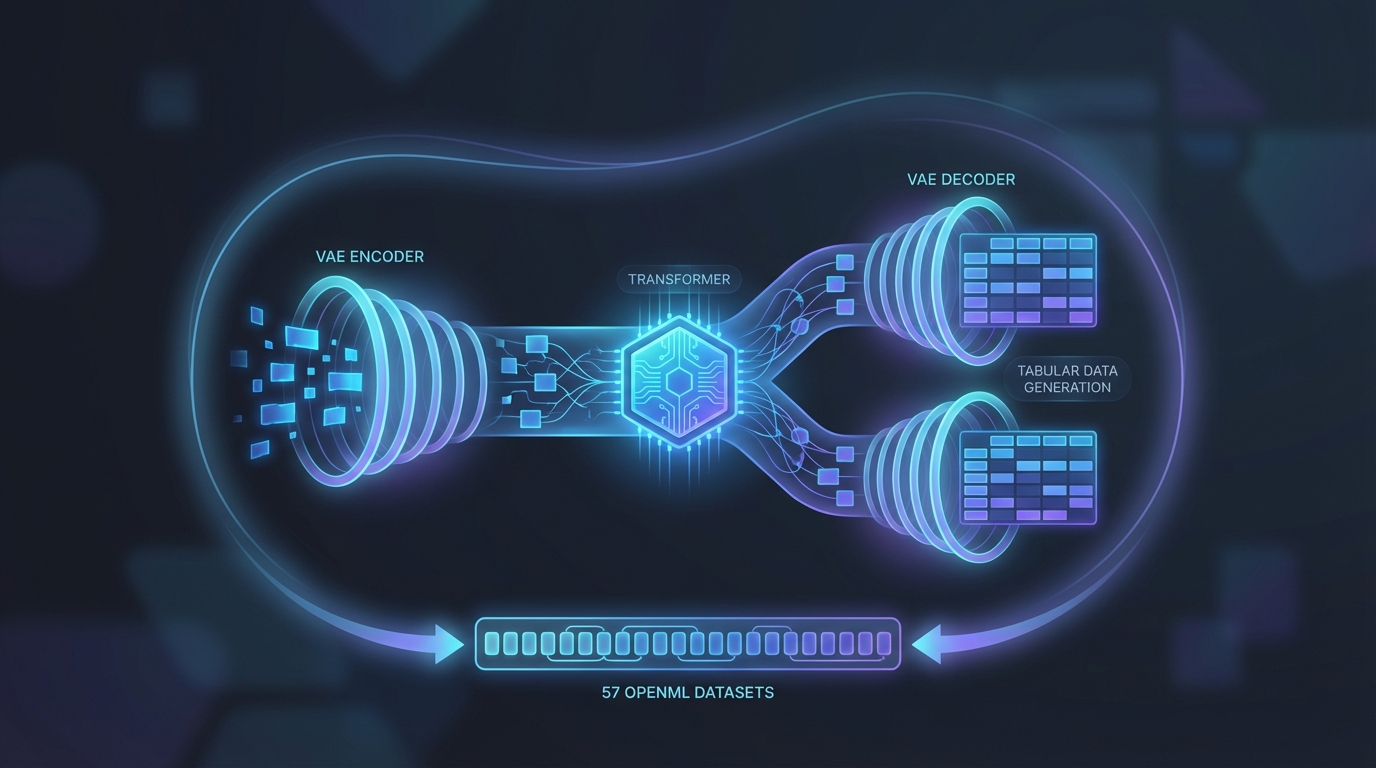

Exploración de la colocación de transformadores en autoencoders variacionales para la generación de datos tabulares

Imagen generada por Gemini AI

Un estudio investiga la integración de Transformadores en Autoencoders Variacionales (VAEs) para mejorar su rendimiento en la modelización de datos tabulares. Al evaluar 57 conjuntos de datos de OpenML CC18, los investigadores descubrieron que al incorporar Transformadores en los componentes latentes y en el decodificador se genera un equilibrio entre la fidelidad y la diversidad. Además, observaron que la relación entre la entrada y la salida del decodificador es casi lineal, lo que revela patrones consistentes en los bloques de Transformadores.

Transformadores Mejoran Autoencoders Variacionales para la Generación de Datos Tabulares

Investigaciones recientes revelan el potencial de integrar modelos de Transformadores en Autoencoders Variacionales (VAEs) para la generación de datos tabulares. Al analizar 57 conjuntos de datos de la suite OpenML CC18, el estudio proporciona información sobre las adaptaciones estructurales de los VAEs con Transformadores.

Hallazgos Clave del Estudio

El estudio destaca dos conclusiones principales:

- Ubicación del Transformador: Posicionar los Transformadores dentro de las representaciones latentes y del decodificador crea un equilibrio entre la fidelidad y la diversidad en los datos generados.

- Similitud de Bloques: Se observa una similitud significativa entre bloques consecutivos del Transformador, particularmente en el decodificador, donde la relación entrada-salida se aproxima a la linealidad.

Estos hallazgos sugieren que, si bien los Transformadores mejoran la capacidad generativa de los VAEs, una colocación cuidadosa es esencial para equilibrar la calidad y la variabilidad en los datos generados.

Temas relacionados:

📰 Fuente original: https://arxiv.org/abs/2601.20854v1

Todos los derechos y créditos pertenecen al editor original.