Untersuchung der Platzierung von Transformatoren in Variational Autoencoders zur Generierung tabellarischer Daten

Von Gemini AI generiertes Bild

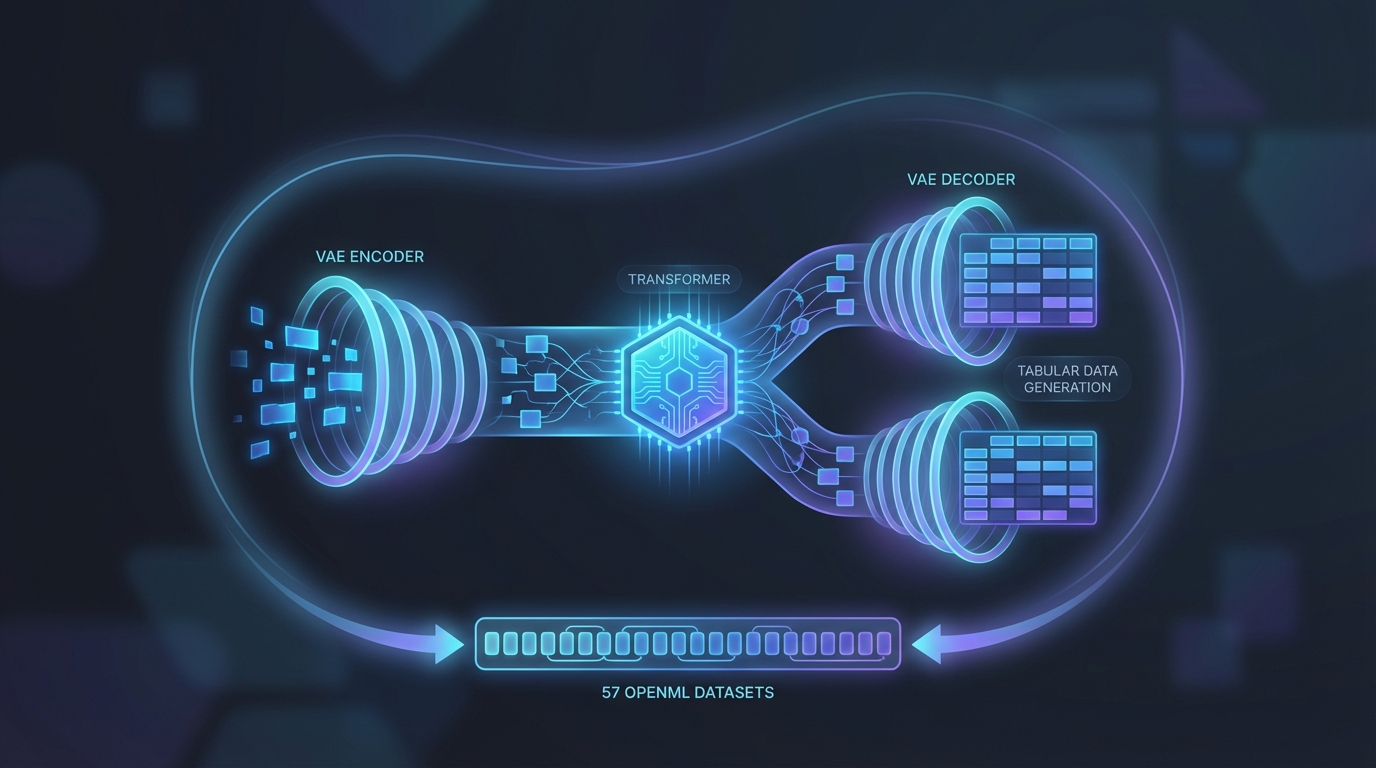

Eine Studie untersucht die Integration von Transformern in Variational Autoencoders (VAEs), um deren Leistung bei der Modellierung tabellarischer Daten zu verbessern. In Tests mit 57 OpenML CC18-Datensätzen fanden die Forscher heraus, dass die Platzierung von Transformern in den latenten und dekodierenden Komponenten einen Kompromiss zwischen Genauigkeit und Vielfalt schafft. Zudem stellten sie fest, dass die Eingabe-Ausgabe-Beziehung des Decoders nahezu linear ist, was auf konsistente Muster in den Transformer-Blöcken hinweist.

Transformatoren verbessern Variational Autoencoders für die Generierung tabellarischer Daten

Aktuelle Forschung zeigt das Potenzial der Integration von Transformermodellen in Variational Autoencoders (VAEs) zur Generierung tabellarischer Daten. Die Analyse von 57 Datensätzen aus dem OpenML CC18-Suite bietet Einblicke in die strukturellen Anpassungen von VAEs mit Transformatoren.

Wichtigste Ergebnisse der Studie

Die Studie hebt zwei Hauptschlussfolgerungen hervor:

- Platzierung der Transformatoren: Die Positionierung von Transformatoren innerhalb der latenten und Dekodierer-Repräsentationen schafft einen Kompromiss zwischen Treue und Vielfalt der generierten Daten.

- Blockähnlichkeit: Eine signifikante Ähnlichkeit wird zwischen aufeinanderfolgenden Blöcken des Transformers beobachtet, insbesondere im Dekodierer, wo die Eingangs-Ausgangs-Beziehung linear approximiert.

Diese Ergebnisse deuten darauf hin, dass, während Transformatoren die generative Kapazität von VAEs verbessern, eine sorgfältige Platzierung entscheidend ist, um Qualität und Variabilität der generierten Daten auszubalancieren.

Verwandte Themen:

📰 Originalquelle: https://arxiv.org/abs/2601.20854v1

Alle Rechte und Urheberrechte liegen beim ursprünglichen Herausgeber.