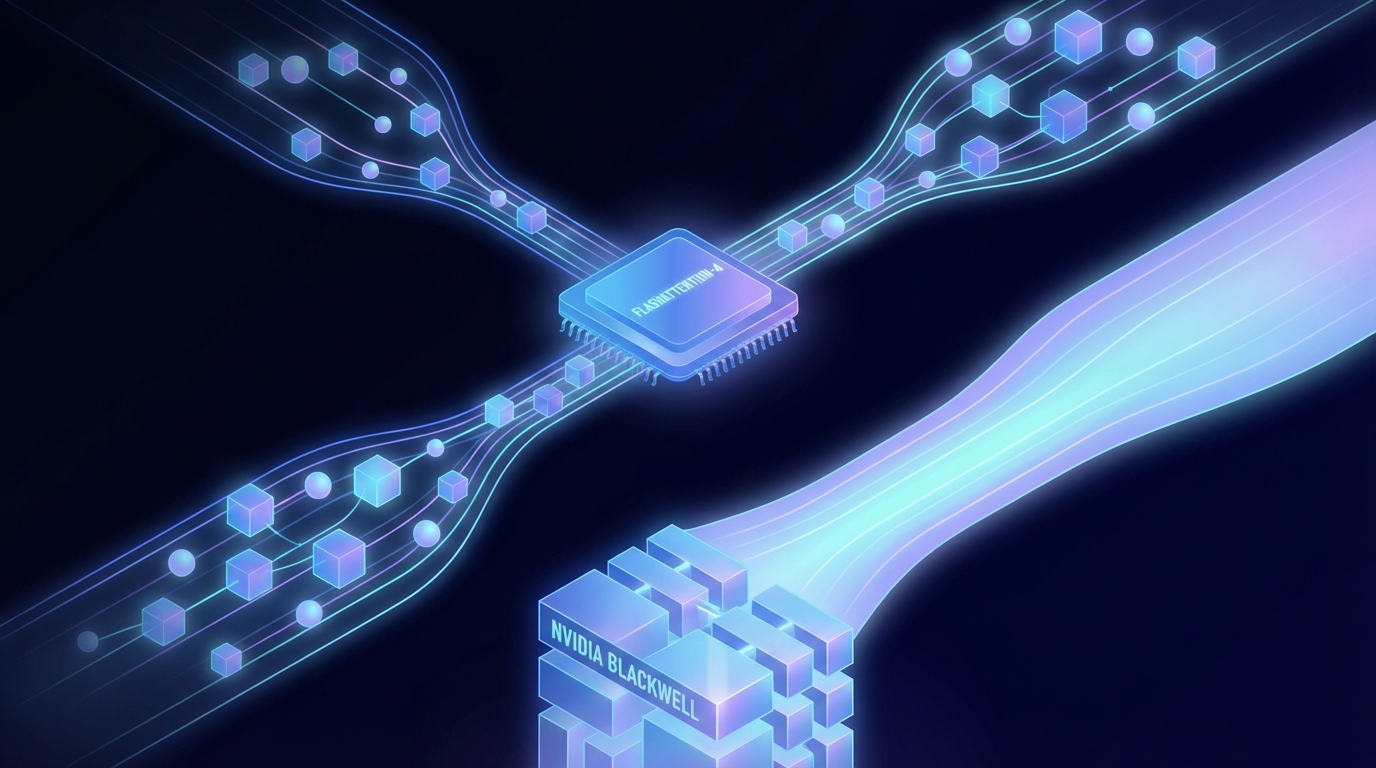

Überwindung von Rechen- und Speicherengpässen mit FlashAttention-4 auf NVIDIA Blackwell

Von Gemini AI generiertes Bild

Die Transformer-Architektur spielt eine entscheidende Rolle im Aufstieg der generativen KI und ermöglicht es großen Sprachmodellen (LLMs) wie GPT, DeepSeek und Llama. Diese Architektur verbessert die Verarbeitungseffizienz und das Kontextverständnis, was zu erheblichen Fortschritten bei Aufgaben der natürlichen Sprachverarbeitung führt. Die Auswirkungen auf KI-Anwendungen sind tiefgreifend, da Transformer nuanciertere und reaktionsschnellere Interaktionen in verschiedenen Bereichen ermöglichen, von Kundenservice bis hin zur Inhaltserstellung.

Überwindung von Rechen- und Speicherengpässen mit FlashAttention-4 auf NVIDIA Blackwell

NVIDIA hat FlashAttention-4 vorgestellt, eine Weiterentwicklung, die darauf abzielt, die Rechen- und Speichereffizienz für Transformermodelle, insbesondere für große Sprachmodelle (LLMs) wie GPT und Llama, zu optimieren.

FlashAttention-4 geht Herausforderungen traditioneller Aufmerksamkeitsmechanismen an, die oft an Einschränkungen in der Speichernutzung und der Rechengeschwindigkeit leiden, wenn die Modellgrößen zunehmen. Diese Implementierung ermöglicht es, größere Modelle effizienter zu trainieren und bereitzustellen.

Zu den Hauptmerkmalen von FlashAttention-4 gehören:

- Verbesserte Speichereffizienz: Reduziert den Speicherbedarf für Aufmerksamkeitsberechnungen, sodass größere Modelle auf bestehende Hardware passen.

- Erhöhte Geschwindigkeit: Beschleunigt die Trainings- und Inferenzprozesse für Transformermodelle erheblich.

- Nahtlose Integration mit Blackwell: Entwickelt, um die Verbesserungen der kommenden Blackwell-GPUs vollständig auszuschöpfen.

Frühe Benchmarks zeigen, dass Modelle, die FlashAttention-4 nutzen, höhere Durchsatzraten erreichen und die benötigte Zeit und Ressourcen für das Training reduzieren. Mit der steigenden Nachfrage nach leistungsstarken KI-Modellen könnte diese Weiterentwicklung zu erheblichen Verbesserungen in den Fähigkeiten des Verstehens und der Generierung natürlicher Sprache führen.

Verwandte Themen:

📰 Originalquelle: https://developer.nvidia.com/blog/overcoming-compute-and-memory-bottlenecks-with-flashattention-4-on-nvidia-blackwell/

Alle Rechte und Urheberrechte liegen beim ursprünglichen Herausgeber.