Multi-RADS-Synthetische Radiologieberichtsdatensatz und direkte Vergleichsstudie von 41 offenen und proprietären Sprachmodellen

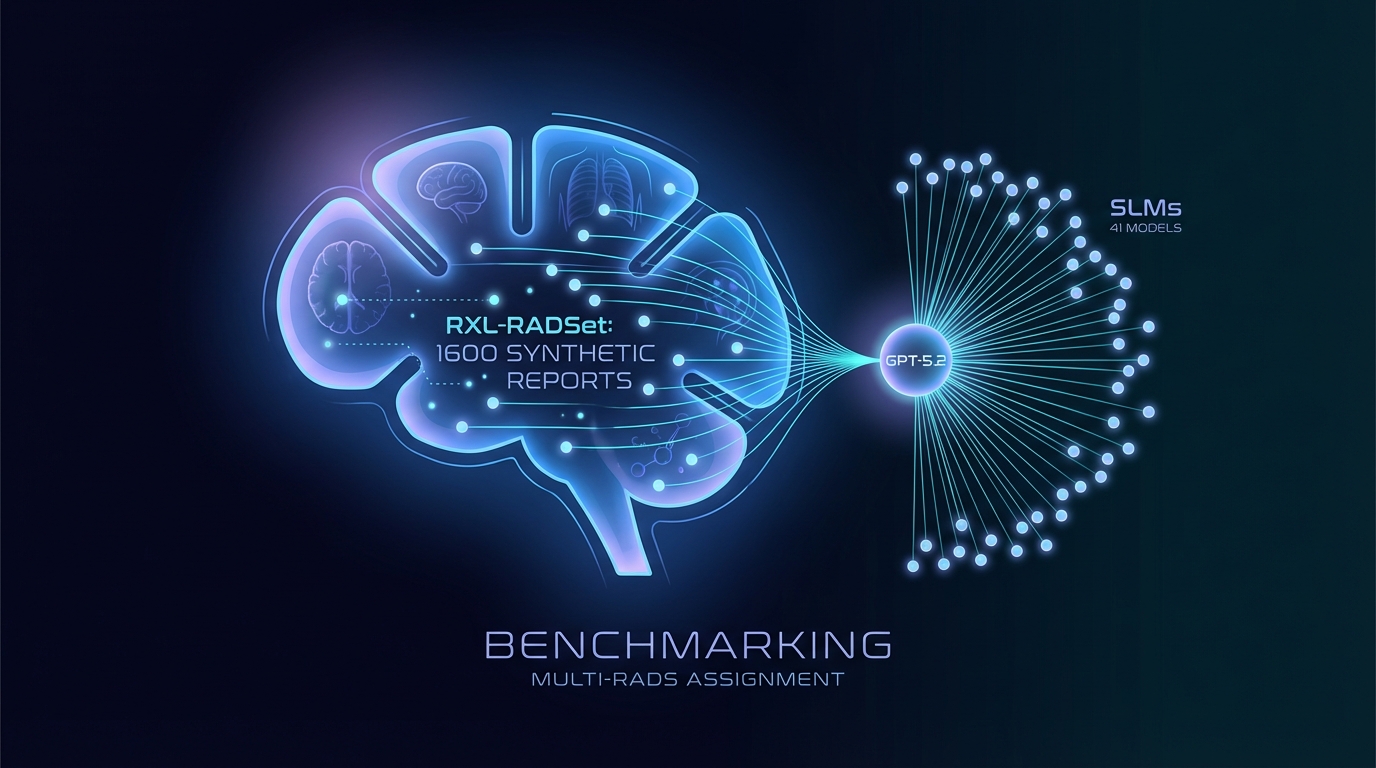

Von Gemini AI generiertes Bild

Forscher haben RXL-RADSet entwickelt, einen Benchmark mit 1.600 synthetischen Radiologieberichten, um die automatisierte Zuordnung von RADS zu verbessern. Dieser Vergleich umfasst 41 kleine Sprachmodelle (SLMs) und GPT-5.2 hinsichtlich Genauigkeit und Validität. GPT-5.2 erzielte eine Validität von 99,8 % und eine Genauigkeit von 81,1 %, was es den SLMs überlegen machte, die eine Validität von 96,8 % und eine Genauigkeit von 61,1 % aufwiesen. Die Leistung verbesserte sich mit der Größe des Modells und gezielten Eingabeaufforderungen, jedoch bestehen weiterhin Herausforderungen bei komplexen RADS-Rahmenwerken.

Multi-RADS-Benchmark-Datensatz für Sprachmodelle in der Radiologie veröffentlicht

Ein neuer Datensatz, der darauf abzielt, die Risikokommunikation in der Radiologie zu verbessern, wurde veröffentlicht. Er enthält einen Benchmark synthetischer Radiologie-Berichte aus mehreren Reporting- und Datensystemen (RADS). Bekannt als RXL-RADSet, umfasst er 1.600 synthetische Berichte, die von Radiologen verifiziert wurden, und wurde entwickelt, um die Leistung verschiedener Sprachmodelle bei der automatisierten RADS-Zuordnung zu bewerten.

Leistungsbewertung der Sprachmodelle

Die Studie bewertete 41 quantisierte kleine Sprachmodelle (SLMs) mit Parametergrößen von 0,135 bis 32 Milliarden, neben dem proprietären Modell GPT-5.2. Die primären Metriken zur Bewertung waren die Gültigkeit und Genauigkeit der RADS-Zuordnungen.

Die Ergebnisse zeigten, dass GPT-5.2 eine Gültigkeit von 99,8 % und eine Genauigkeit von 81,1 % bei insgesamt 1.600 Vorhersagen erreichte. Im Gegensatz dazu produzierten die zusammengefassten SLMs eine Gültigkeit von 96,8 % und eine Genauigkeit von 61,1 % aus insgesamt 65.600 Vorhersagen. Die leistungsstärksten SLMs im Bereich von 20-32 Milliarden Parametern erreichten nahezu 99 % Gültigkeit und erzielten mittlere bis hohe Genauigkeitsraten von 70 %.

Die Analyse zeigte einen Trend, bei dem die Leistung mit der Modellgröße zunahm, insbesondere mit einem Wendepunkt zwischen Modellen mit weniger als 1 Milliarde Parametern und solchen mit 10 Milliarden oder mehr. Allerdings hatte die Komplexität der RADS-Rahmenbedingungen einen erheblichen Einfluss auf die Leistung, wobei eine höhere Komplexität zu Klassifizierungsherausforderungen anstelle von ungültigen Ausgaben führte.

Geführtes Prompting verbesserte sowohl die Gültigkeit als auch die Genauigkeit, wobei die Gültigkeitswerte 99,2 % erreichten im Vergleich zu 96,7 % bei Zero-Shot-Prompting.

Verwandte Themen:

📰 Originalquelle: https://arxiv.org/abs/2601.03232v1

Alle Rechte und Urheberrechte liegen beim ursprünglichen Herausgeber.