Jet-RL: Ermöglichung von On-Policy FP8-Verstärkungslernen durch einheitliches Training und präzisen Ablauffluss

Von Gemini AI generiertes Bild

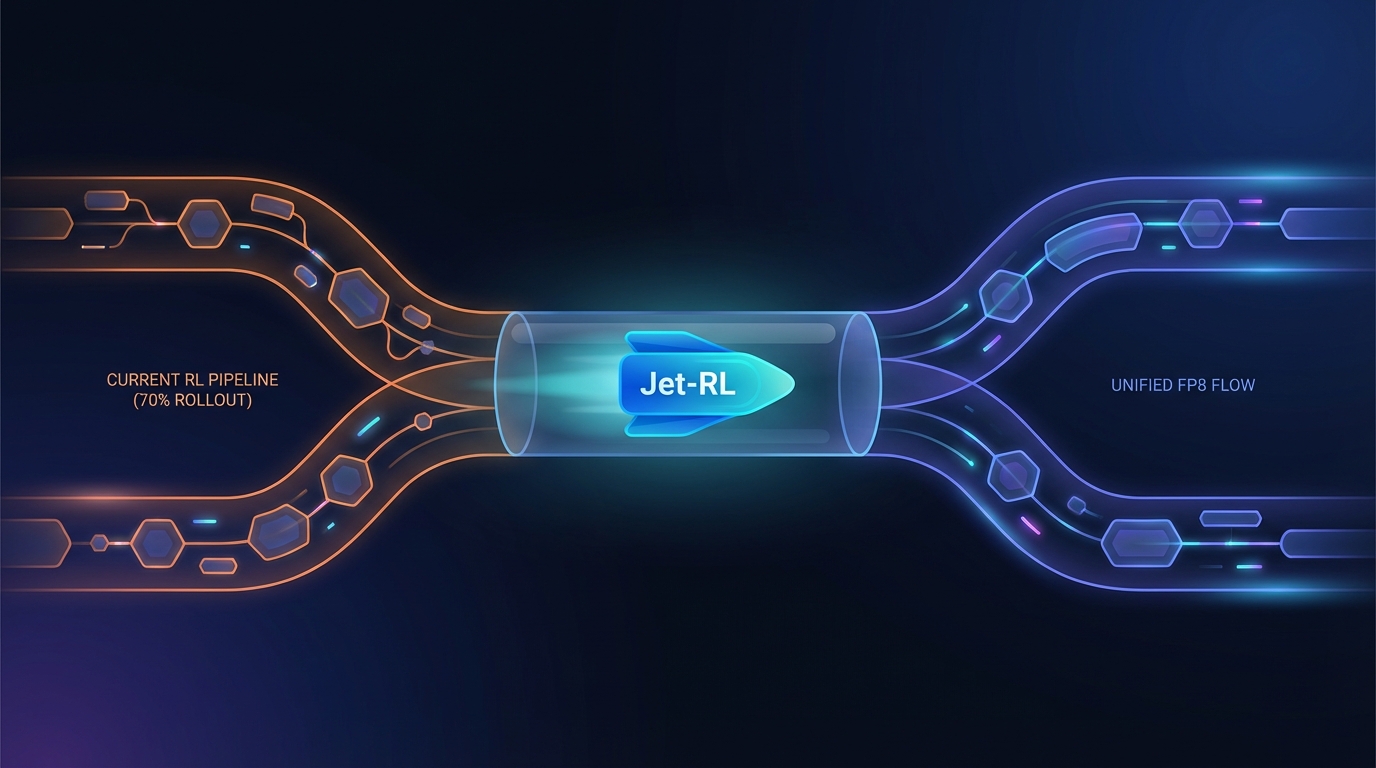

Forschung zeigt die Ineffizienzen der aktuellen Reinforcement-Learning (RL)-Pipelines für große Sprachmodelle, bei denen die Rollout-Phasen über 70 % der Trainingszeit in Anspruch nehmen. Eine Studie hat ergeben, dass die gängige Strategie mit BF16 und FP8 zu Instabilität und Genauigkeitsverlust führt. Mit der Einführung von Jet-RL, das eine einheitliche FP8-Präzision für Training und Rollouts verwendet, kann die Effizienz um bis zu 41 % gesteigert und die Konvergenz stabilisiert werden, ohne dabei die Genauigkeit wesentlich zu beeinträchtigen.

Jet-RL Revolutioniert das Verstärkende Lernen mit Vereinheitlichtem FP8-Training

Jet-RL ist ein neuartiges Framework, das den Trainingsprozess im verstärkenden Lernen (RL) durch die Nutzung von FP8-Präzision sowohl in den Trainings- als auch in den Rollout-Phasen optimiert. Dieser Ansatz verbessert die rechnerische Effizienz und geht dem hohen Ressourcenverbrauch in traditionellen RL-Pipelines entgegen.

Aktuelle Methoden, die BF16-Präzision für das Training und FP8 für den Rollout verwenden, leiden oft unter Instabilität und einem Zusammenbruch der Genauigkeit während langer Rollouts. Jet-RL minimiert numerische Diskrepanzen zwischen Training und Inferenz und beseitigt die Notwendigkeit für eine Kalibrierung zwischen den Schritten.

Leistungskennzahlen von Jet-RL

Umfangreiche Experimente bestätigen die Effektivität von Jet-RL und zeigen:

- Rollout-Beschleunigung: Bis zu 33% schnellere Rollout-Zeiten.

- Training-Beschleunigung: Bis zu 41% schnellere Trainingsphasen.

- End-to-End-Beschleunigung: 16% Gesamtbeschleunigung im Vergleich zum traditionellen BF16-Training.

Diese Verbesserungen treten auf, während eine stabile Konvergenz über verschiedene Aufgaben hinweg aufrechterhalten wird, mit vernachlässigbarem Genauigkeitsverlust, was einen entscheidenden Fortschritt für Entwickler darstellt, die mit großen Sprachmodellen (LLMs) arbeiten.

Bewältigung von Trainingsinstabilität

Die Forschung hebt hervor, dass die Instabilität der BF16 + FP8-Strategie auf die off-policy Natur der Trainingsmethode zurückzuführen ist, was RL-Anwendungen in komplexen Denkaufgaben behindert. Durch die Annahme des vereinheitlichten Ansatzes von Jet-RL können Praktiker einen zuverlässigeren Trainingsprozess erwarten, der die Leistung von LLMs in realen Anwendungen verbessert.

Verwandte Themen:

📰 Originalquelle: https://arxiv.org/abs/2601.14243v1

Alle Rechte und Urheberrechte liegen beim ursprünglichen Herausgeber.