Ensemblegrößenabhängigkeit von Deep-Learning-Post-Processing-Methoden zur Minimierung eines (un)fairen Scores: Motivierende Beispiele und eine Proof-of-Concept-Lösung

Von Gemini AI generiertes Bild

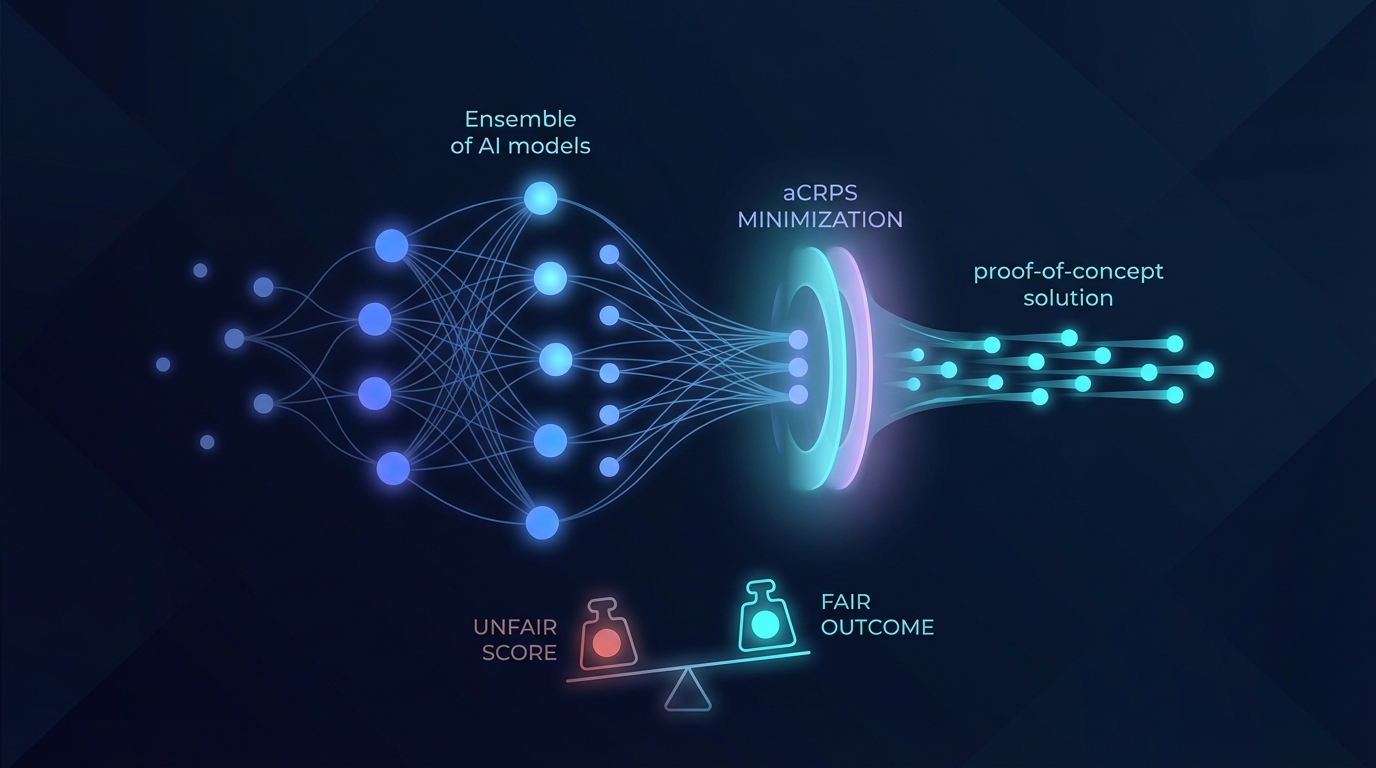

Der Artikel behandelt die Herausforderungen bei der Verwendung des angepassten kontinuierlichen Rang-Wahrscheinlichkeitswerts (aCRPS) zur Schulung von Ensembleprognosen, insbesondere wenn strukturelle Abhängigkeiten zwischen den Mitgliedern eingeführt werden. Er hebt zwei problematische Ansätze hervor: die lineare Kalibrierung der Mitglieder und eine tiefenlernbasierte Methode, die zu Überdispersion führen kann. Die Autoren schlagen "Trajektorien-Transformatoren" vor, die das PoET-Framework anpassen, um die bedingte Unabhängigkeit in den Prognosen aufrechtzuerhalten. Diese Methode reduziert systematische Verzerrungen effektiv und verbessert die Zuverlässigkeit der wöchentlichen Mitteltemperaturprognosen des ECMWF-Systems, unabhängig von der Größe des Ensembles (3 vs. 9 Mitglieder in der Schulung; 9 vs. 100 in Echtzeit).

Neue Forschung hebt die Abhängigkeit von der Ensemble-Größe bei der Nachbearbeitung von Deep Learning hervor

Neueste Erkenntnisse zeigen, dass die Effektivität bestimmter Nachbearbeitungsmethoden des Deep Learning in der Ensemble-Prognose erheblich von der Größe des Ensembles beeinflusst werden kann. Die Studie konzentriert sich auf faire Bewertungen, insbesondere den angepassten kontinuierlichen Rang-Wahrscheinlichkeitswert (aCRPS), der entwickelt wurde, um Ensemble-Prognosen ohne Verzerrung hinsichtlich der Ensemble-Größe zu bewerten.

Die Forschung untersucht zwei Ansätze, die darauf abzielen, den erwarteten aCRPS für endliche Ensembles zu minimieren:

- Lineare Kalibrierung Mitglied für Mitglied: Diese Methode koppelt Ensemble-Mitglieder durch eine gemeinsame Abhängigkeit vom Stichprobenmittel des Ensembles.

- Deep Learning mit Selbst-Attention von Transformern: Diese Technik verbindet Ensemble-Mitglieder mithilfe von Selbst-Attention-Mechanismen über die Ensemble-Dimension hinweg.

Beide Methoden zeigten eine Sensitivität gegenüber der Ensemble-Größe, was darauf hindeutet, dass Verbesserungen im aCRPS irreführend sein könnten, oft begleitet von systematischer Unzuverlässigkeit und Überdispersion in den Prognosen.

Trajektorien-Transformer als Lösung

Um diese Probleme anzugehen, führten die Forscher Trajektorien-Transformer ein, eine Proof-of-Concept-Adaption des Rahmens Post-processing Ensembles with Transformers (PoET). Dieser Ansatz verwendet Selbst-Attention über Vorlaufzeiten, während die erforderliche bedingte Unabhängigkeit für aCRPS-Bewertungen gewahrt bleibt.

Angewandt auf wöchentliche Mittelwerte der 2-Meter-Temperaturprognosen des ECMWF-Subseasonal-Prognosesystems reduzierten Trajektorien-Transformer effektiv systematische Modellverzerrungen und verbesserten die Zuverlässigkeit der Prognosen, unabhängig von der im Training verwendeten Ensemble-Größe.

Verwandte Themen:

📰 Originalquelle: https://arxiv.org/abs/2602.15830v1

Alle Rechte und Urheberrechte liegen beim ursprünglichen Herausgeber.