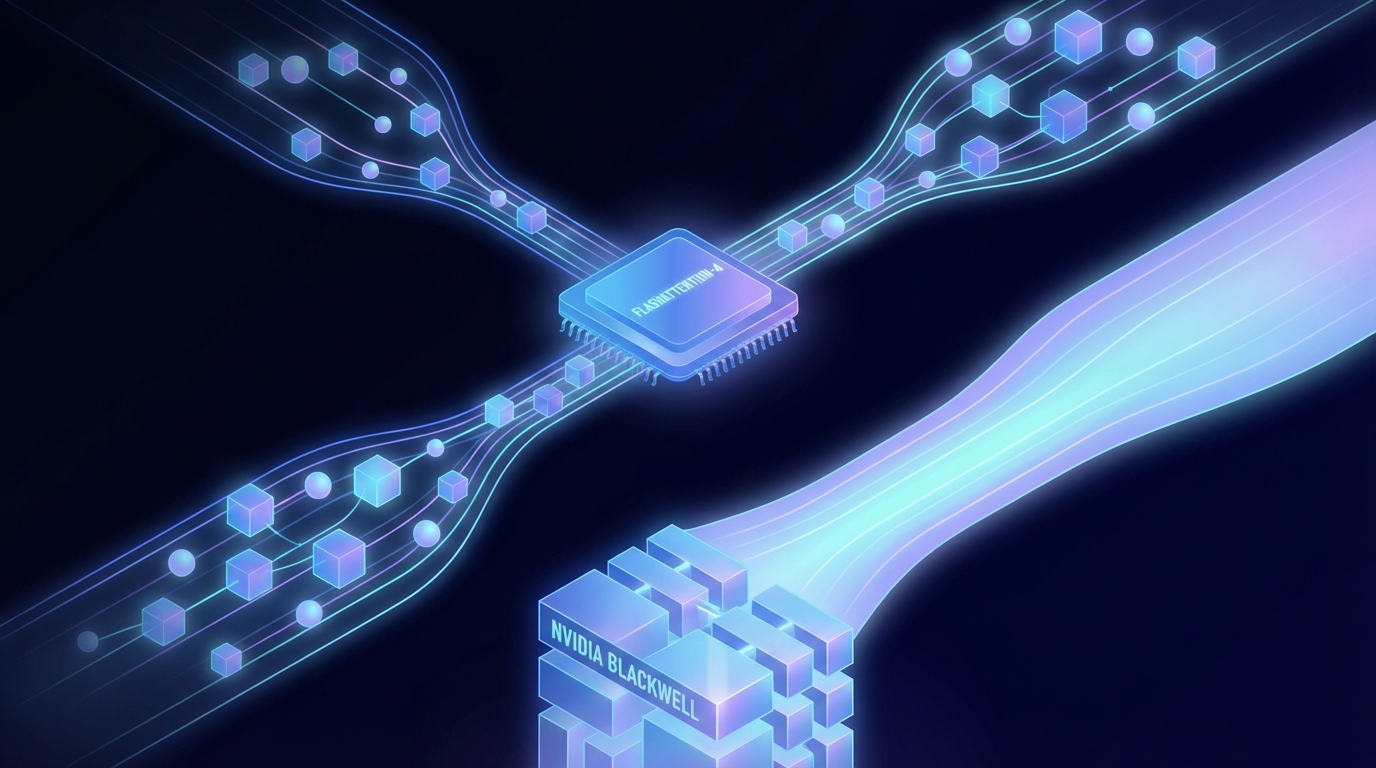

Преодоление узких мест в вычислениях и памяти с помощью FlashAttention-4 на NVIDIA Blackwell

Изображение создано Gemini AI

Архитектура трансформеров играет ключевую роль в развитии генеративного ИИ, обеспечивая работу крупных языковых моделей (LLM), таких как GPT, DeepSeek и Llama. Эта архитектура повышает эффективность обработки данных и понимания контекста, что приводит к значительным достижениям в задачах обработки естественного языка. Последствия для приложений ИИ весьма значительны, так как трансформеры позволяют реализовать более тонкие и отзывчивые взаимодействия в различных секторах, от обслуживания клиентов до создания контента.

Преодоление узких мест в вычислениях и памяти с FlashAttention-4 на NVIDIA Blackwell

NVIDIA представила FlashAttention-4, нововведение, направленное на оптимизацию вычислительной и памятьевой эффективности для трансформерных моделей, особенно для крупных языковых моделей (LLM), таких как GPT и Llama.

FlashAttention-4 решает проблемы традиционных механизмов внимания, которые часто сталкиваются с ограничениями в использовании памяти и скорости вычислений по мере роста размеров моделей. Эта реализация позволяет обучать и развертывать более крупные модели более эффективно.

Ключевые особенности FlashAttention-4 включают:

- Улучшенная памятьевая эффективность: Снижает объем памяти, необходимой для вычислений внимания, позволяя более крупным моделям помещаться в существующее оборудование.

- Увеличенная скорость: Значительно ускоряет процессы обучения и вывода для трансформерных моделей.

- Бесшовная интеграция с Blackwell: Разработан для полного использования улучшений, предлагаемых предстоящими графическими процессорами Blackwell.

Ранние бенчмарки показывают, что модели, использующие FlashAttention-4, достигают более высоких скоростей обработки, сокращая время и ресурсы, необходимые для обучения. Поскольку спрос на мощные AI модели растет, это нововведение может привести к значительным улучшениям в понимании и генерации естественного языка.

Связанные темы:

📰 Первоисточник: https://developer.nvidia.com/blog/overcoming-compute-and-memory-bottlenecks-with-flashattention-4-on-nvidia-blackwell/

Все права и авторство принадлежат первоначальному издателю.