Jet-RL: Обеспечение онлайнового обучения с подкреплением FP8 с использованием единого обучения и точности выполнения выработки

Изображение создано Gemini AI

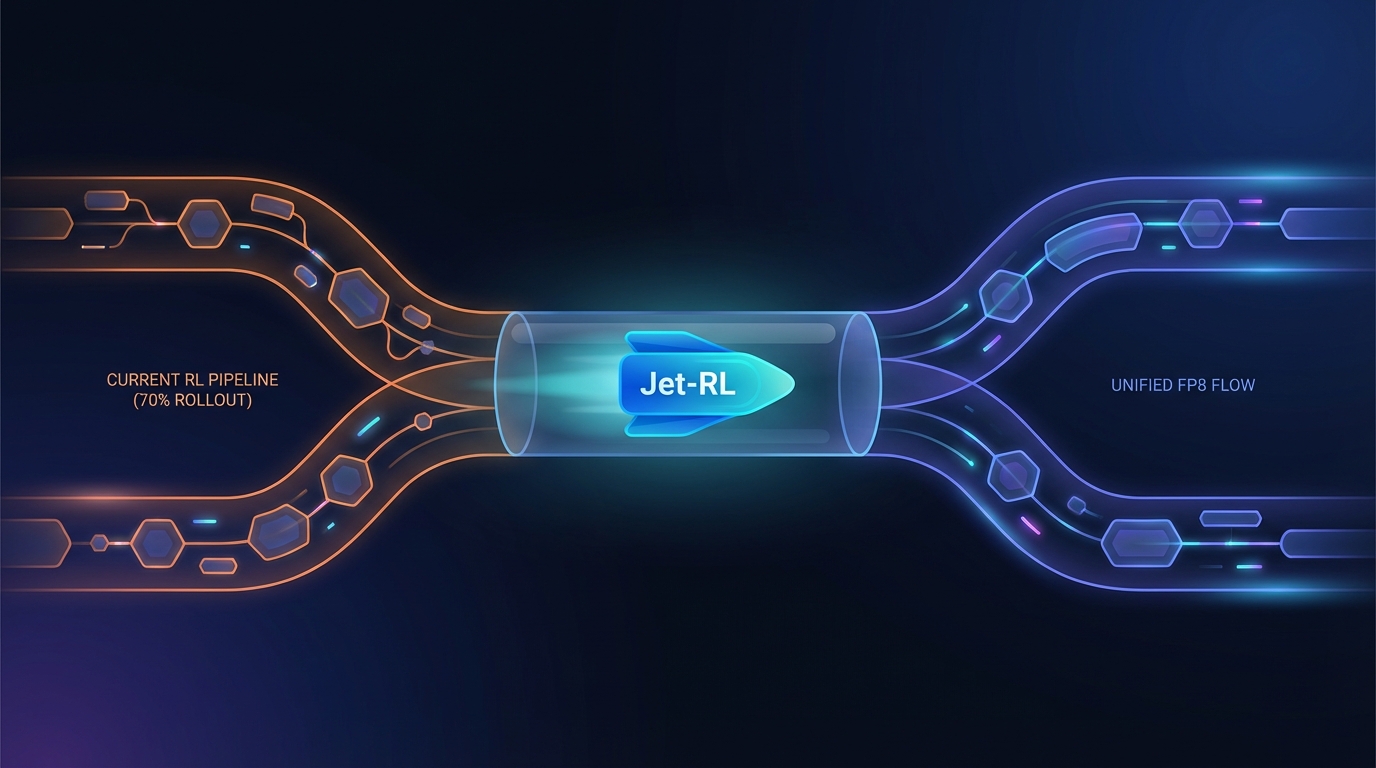

Исследования подчеркивают неэффективность существующих пайплайнов обучения с подкреплением (RL) для крупных языковых моделей, где фазы развертывания занимают более 70% времени обучения. В одном из исследований выявлено, что распространенная стратегия BF16 + FP8 приводит к нестабильности и потере точности. В ответ на это был представлен Jet-RL, который использует унифицированную точность FP8 как для обучения, так и для развертывания. Это позволяет повысить эффективность на 41% и стабилизировать сходимость с минимальным влиянием на точность.

Jet-RL Революционизирует Обучение с Подкреплением с Помощью Унифицированного Обучения FP8

Jet-RL — это новая рамочная система, которая упрощает процесс обучения с подкреплением (RL), используя точность FP8 как для фаз обучения, так и для выполнения. Этот подход повышает вычислительную эффективность, решая проблему высокого потребления ресурсов в традиционных RL-процессах.

Текущие методологии, использующие точность BF16 для обучения и FP8 для выполнения, часто сталкиваются с нестабильностью и потерей точности во время долгосрочных выполнений. Jet-RL минимизирует численные расхождения между обучением и выводом, устраняя необходимость в калибровке между шагами.

Показатели Производительности Jet-RL

Обширные эксперименты подтверждают эффективность Jet-RL, демонстрируя:

- Ускорение Выполнения: До 33% быстрее выполнение.

- Ускорение Обучения: До 41% быстрее фазы обучения.

- Общее Ускорение: 16% общего ускорения по сравнению с традиционным обучением BF16.

Эти улучшения достигаются при сохранении стабильной сходимости по различным задачам, с незначительным ухудшением точности, что является важным шагом вперед для разработчиков, работающих с большими языковыми моделями (LLM).

Решение Проблем Нестабильности Обучения

Исследование подчеркивает, что нестабильность в стратегии BF16 + FP8 обусловлена офф-политической природой метода обучения, что затрудняет применение RL в сложных задачах рассуждения. Применяя унифицированный подход Jet-RL, практики могут ожидать более надежный процесс обучения, что улучшит производительность LLM в реальных приложениях.

Связанные темы:

📰 Первоисточник: https://arxiv.org/abs/2601.14243v1

Все права и авторство принадлежат первоначальному издателю.