Исследование размещения трансформеров в вариационных автокодировщиках для генерации табличных данных

Изображение создано Gemini AI

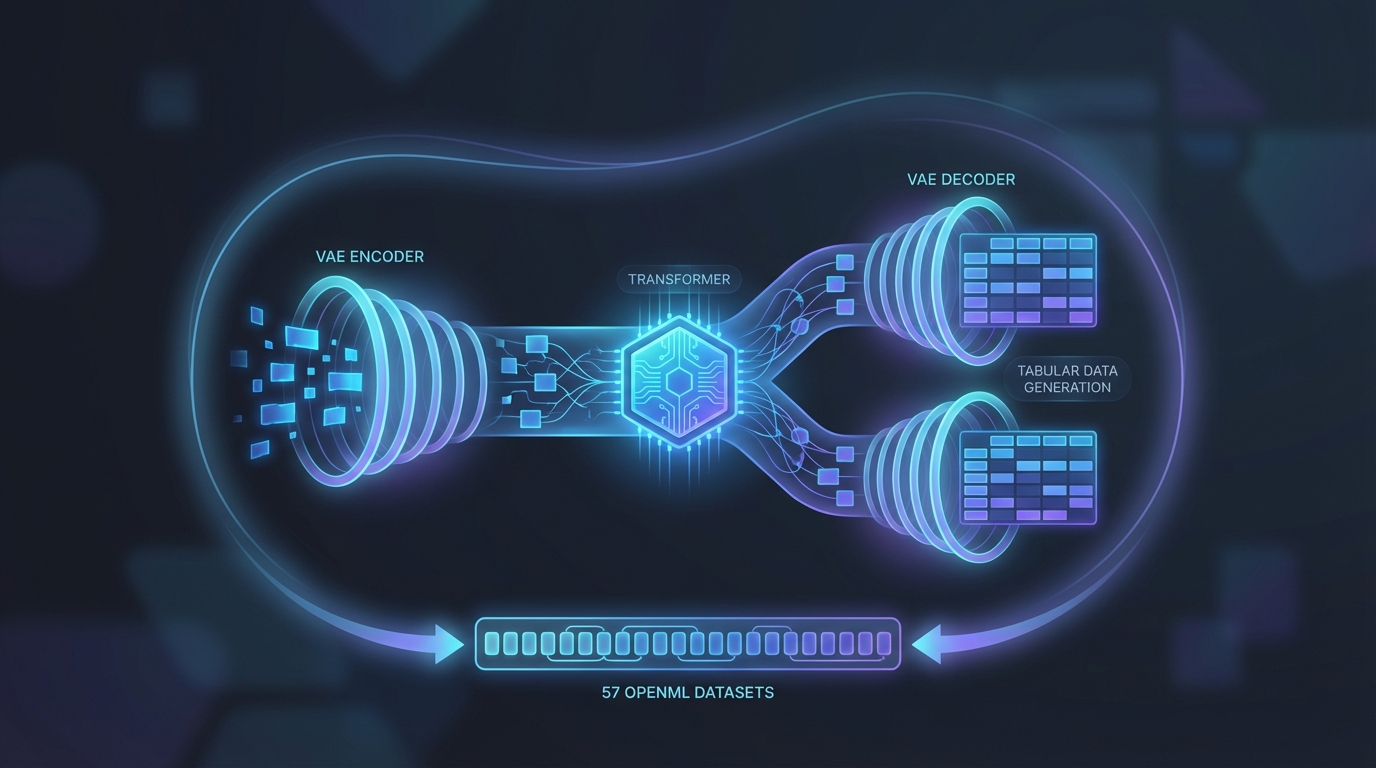

Исследование посвящено интеграции трансформеров в вариационные автокодировщики (ВАК) с целью повышения их эффективности в моделировании табличных данных. В ходе тестирования на 57 наборах данных OpenML CC18 ученые обнаружили, что размещение трансформеров в латентных и декодирующих компонентах создает компромисс между точностью и разнообразием. Кроме того, они отметили, что взаимосвязь между входом и выходом декодера почти линейна, что свидетельствует о наличии устойчивых паттернов в блоках трансформеров.

Трансформеры улучшают вариационные автокодировщики для генерации табличных данных

Недавние исследования показывают потенциал интеграции моделей трансформеров в вариационные автокодировщики (ВАЭ) для генерации табличных данных. Анализируя 57 наборов данных из набора OpenML CC18, исследование предоставляет понимание структурных адаптаций ВАЭ с трансформерами.

Ключевые выводы исследования

В исследовании выделяются два основных вывода:

- Расположение трансформеров: Размещение трансформеров в латентных и декодерных представлениях создает компромисс между точностью и разнообразием генерируемых данных.

- Сходство блоков: Значительное сходство наблюдается между последовательными блоками трансформера, особенно в декодере, где соотношение вход-выход приближается к линейности.

Эти выводы свидетельствуют о том, что хотя трансформеры и усиливают генеративные возможности ВАЭ, тщательное размещение имеет решающее значение для балансировки качества и изменчивости генерируемых данных.

Связанные темы:

📰 Первоисточник: https://arxiv.org/abs/2601.20854v1

Все права и авторство принадлежат первоначальному издателю.