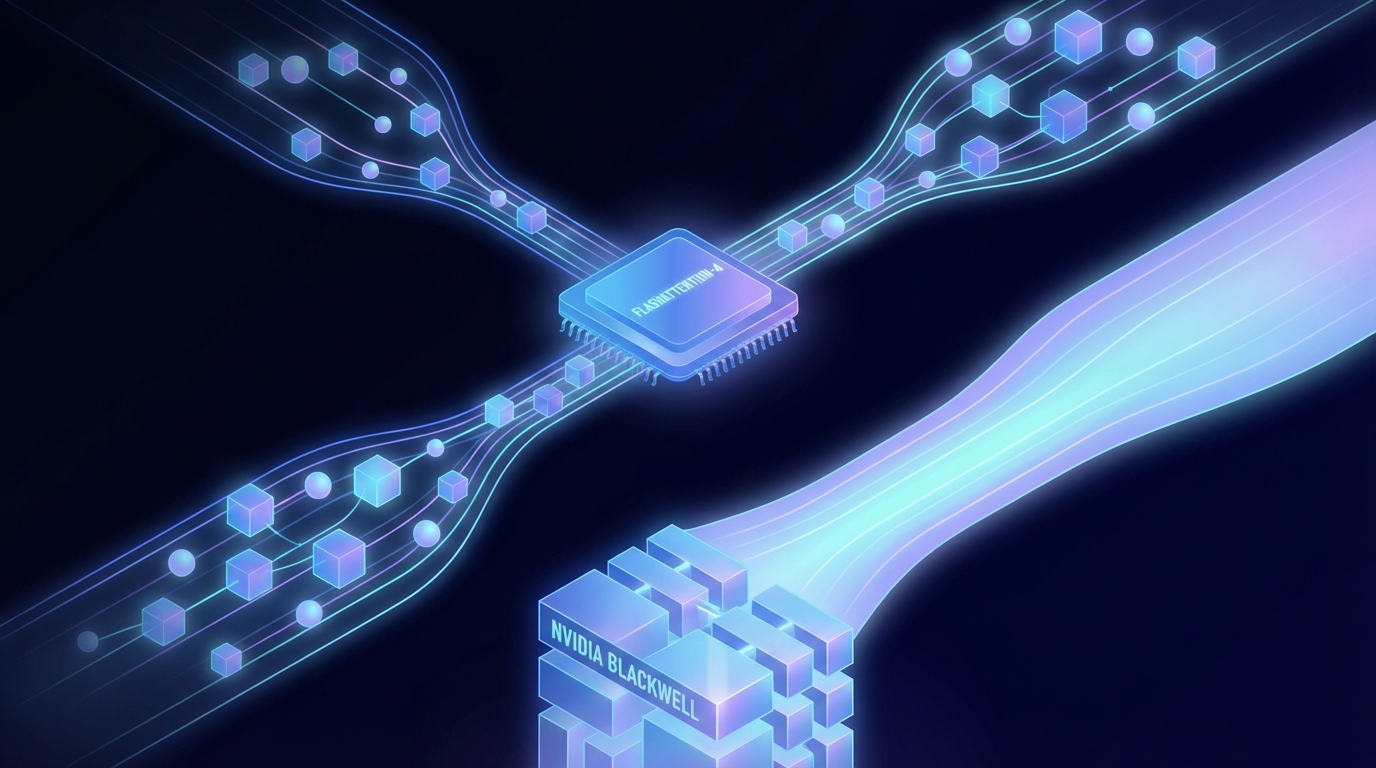

Superare i colli di bottiglia di calcolo e memoria con FlashAttention-4 su NVIDIA Blackwell

Immagine generata da Gemini AI

L'architettura dei Transformer è fondamentale per l'ascesa dell'AI generativa, rendendo possibili modelli di linguaggio di grandi dimensioni (LLM) come GPT, DeepSeek e Llama. Questa architettura migliora l'efficienza di elaborazione e la comprensione del contesto, portando a notevoli progressi nelle attività di elaborazione del linguaggio naturale. Le implicazioni per le applicazioni dell'intelligenza artificiale sono profonde, poiché i transformer consentono interazioni più sfumate e reattive in vari settori, dal servizio clienti alla creazione di contenuti.

Superare i Collo di Bottiglia di Calcolo e Memoria con FlashAttention-4 su NVIDIA Blackwell

NVIDIA ha svelato FlashAttention-4, un'innovazione mirata a ottimizzare l'efficienza di calcolo e memoria per i modelli transformer, in particolare per i modelli di linguaggio di grandi dimensioni (LLM) come GPT e Llama.

FlashAttention-4 affronta le sfide delle tradizionali meccaniche di attenzione, che spesso si trovano ad affrontare limiti nell'uso della memoria e nella velocità di calcolo man mano che le dimensioni dei modelli crescono. Questa implementazione consente di addestrare e distribuire modelli più grandi in modo più efficiente.

Le caratteristiche principali di FlashAttention-4 includono:

- Miglior Efficienza della Memoria: Riduce l'impronta di memoria per i calcoli di attenzione, consentendo a modelli più grandi di adattarsi all'hardware esistente.

- Velocità Maggiore: Accelera significativamente i processi di addestramento e inferenza per i modelli transformer.

- Integrazione Perfetta con Blackwell: Progettato per sfruttare appieno i miglioramenti offerti dalle prossime GPU Blackwell.

I primi benchmark indicano che i modelli che utilizzano FlashAttention-4 raggiungono tassi di throughput più elevati, riducendo il tempo e le risorse necessarie per l'addestramento. Con l'aumento della domanda di modelli AI potenti, questo progresso potrebbe portare a significativi miglioramenti nelle capacità di comprensione e generazione del linguaggio naturale.

Argomenti correlati:

📰 Fonte originale: https://developer.nvidia.com/blog/overcoming-compute-and-memory-bottlenecks-with-flashattention-4-on-nvidia-blackwell/

Tutti i diritti e i crediti appartengono all'editore originale.