Jet-RL: Abilitare l'apprendimento per rinforzo on-policy FP8 con flusso di precisione unificato per addestramento e rollout

Immagine generata da Gemini AI

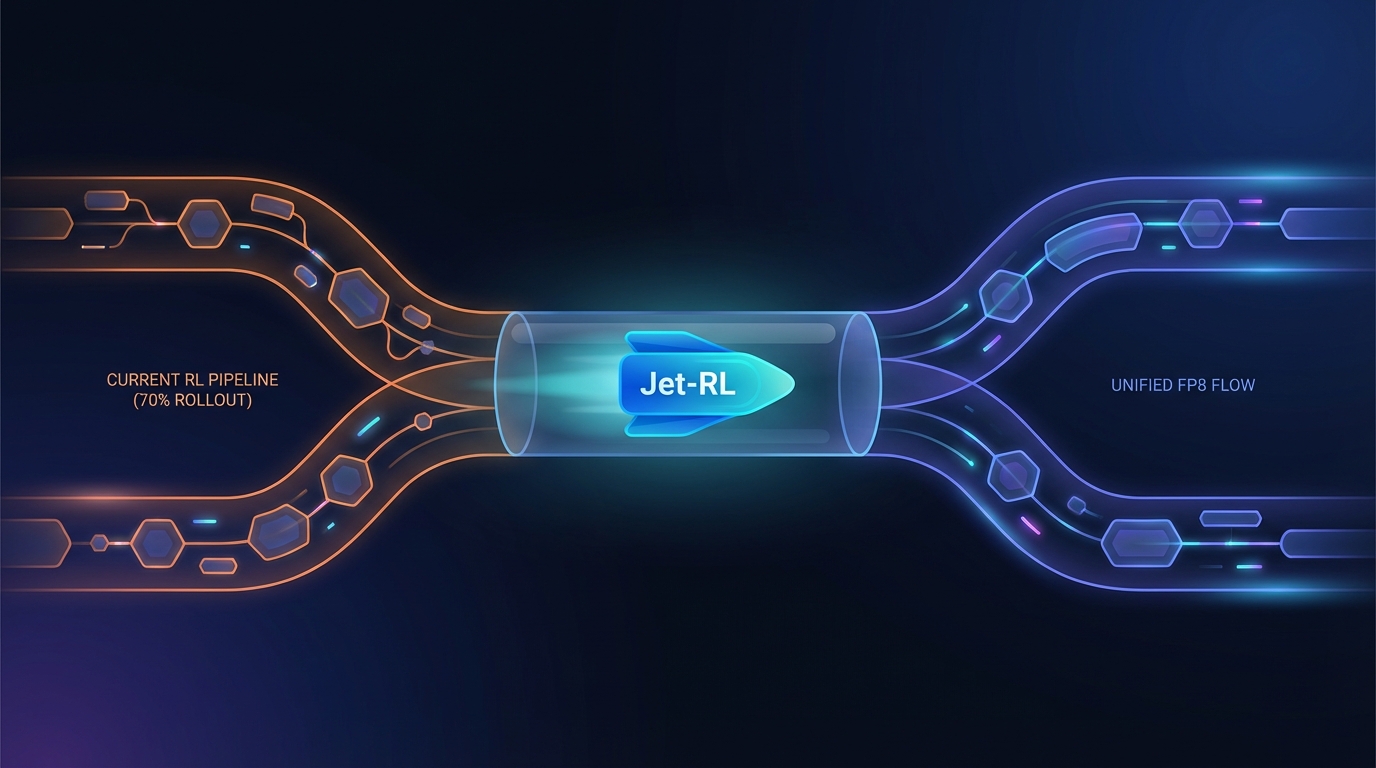

La ricerca mette in luce le inefficienze degli attuali pipeline di apprendimento per rinforzo (RL) per i grandi modelli linguistici, dove le fasi di rollout occupano oltre il 70% del tempo di addestramento. Uno studio ha evidenziato che la comune strategia BF16 + FP8 porta a instabilità e perdita di precisione. È stato quindi introdotto Jet-RL, che utilizza una precisione FP8 unificata per l'addestramento e il rollout, migliorando l'efficienza fino al 41% e stabilizzando la convergenza con un impatto minimo sulla precisione.

Jet-RL Rivoluziona il Reinforcement Learning con un Addestramento Unificato in FP8

Jet-RL è un nuovo framework che semplifica il processo di addestramento nel reinforcement learning (RL) utilizzando la precisione FP8 sia per le fasi di addestramento che di rollout. Questo approccio migliora l'efficienza computazionale, affrontando l'alto consumo di risorse nei pipeline RL tradizionali.

Le metodologie attuali che utilizzano la precisione BF16 per l'addestramento e FP8 per il rollout spesso soffrono di instabilità e collasso dell'accuratezza durante i rollout a lungo termine. Jet-RL minimizza le discrepanze numeriche tra addestramento e inferenza, eliminando la necessità di calibrazione inter-step.

Metrica di Prestazione di Jet-RL

Esperimenti approfonditi confermano l'efficacia di Jet-RL, mostrando:

- Aumento della Velocità di Rollout: Fino al 33% di tempi di rollout più veloci.

- Aumento della Velocità di Addestramento: Fino al 41% di fasi di addestramento più veloci.

- Aumento della Velocità End-to-End: 16% di accelerazione complessiva rispetto all'addestramento tradizionale in BF16.

Questi miglioramenti si verificano mantenendo una convergenza stabile su vari compiti, con una degradazione dell'accuratezza trascurabile, segnando un avanzamento cruciale per gli sviluppatori che lavorano con modelli di linguaggio di grandi dimensioni (LLM).

Affrontare l'Instabilità dell'Addestramento

La ricerca evidenzia che l'instabilità nella strategia BF16 + FP8 è dovuta alla natura off-policy del metodo di addestramento, ostacolando le applicazioni RL in compiti di ragionamento complesso. Adottando l'approccio unificato di Jet-RL, i professionisti possono aspettarsi un processo di addestramento più affidabile, migliorando le prestazioni degli LLM nelle applicazioni del mondo reale.

Argomenti correlati:

📰 Fonte originale: https://arxiv.org/abs/2601.14243v1

Tutti i diritti e i crediti appartengono all'editore originale.