Esplorazione della posizione dei trasformer negli autoencoder variationali per la generazione di dati tabulari

Immagine generata da Gemini AI

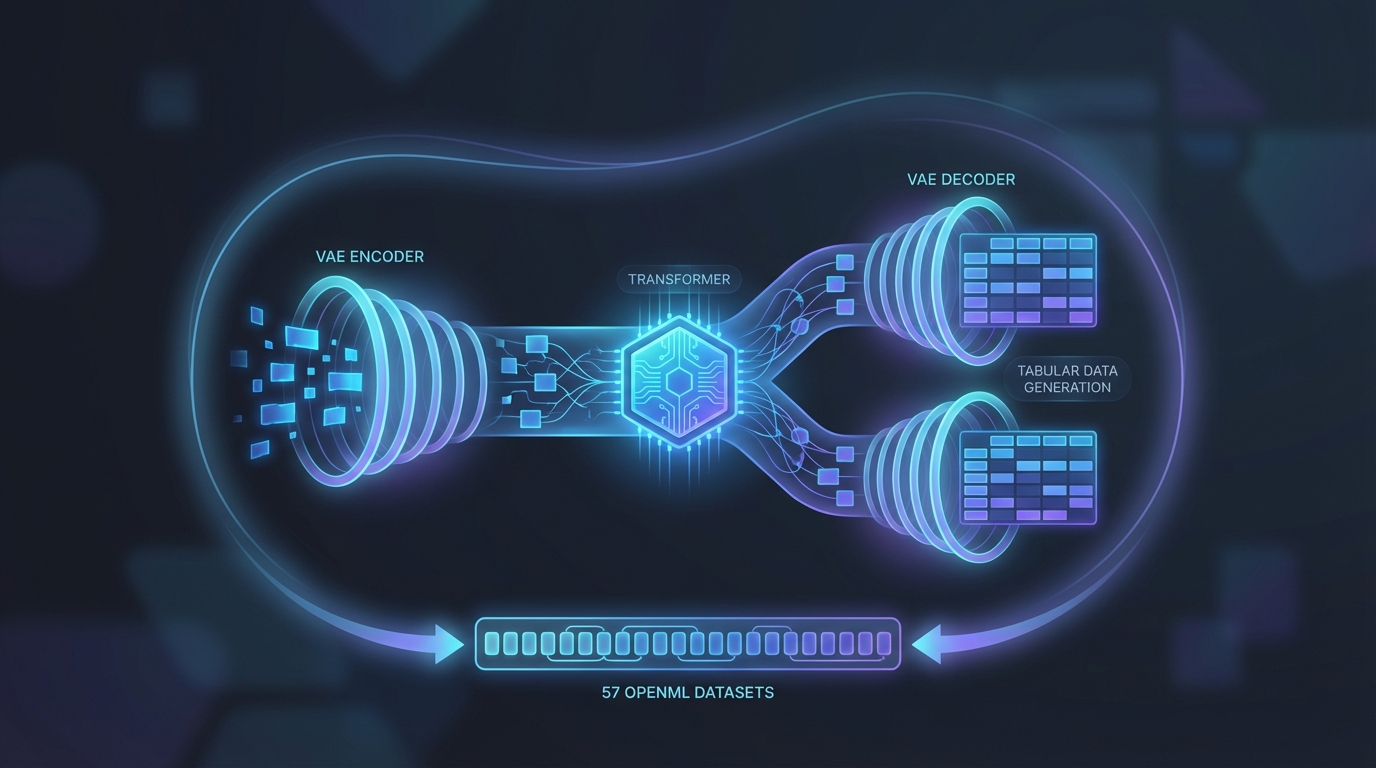

Uno studio indaga l'integrazione dei Transformers nei Variational Autoencoders (VAEs) per migliorarne le prestazioni nella modellazione di dati tabulari. Testando 57 dataset dell'OpenML CC18, i ricercatori hanno scoperto che posizionare i Transformers nei componenti latenti e nel decoder crea un compromesso tra fedeltà e diversità. Inoltre, hanno osservato che la relazione input-output del decoder è pressoché lineare, rivelando schemi costanti all'interno dei blocchi Transformer.

I Trasformatori Potenziano gli Autoencoder Variationali per la Generazione di Dati Tabulari

Recenti ricerche rivelano il potenziale dell'integrazione dei modelli Transformer negli Autoencoder Variationali (VAE) per la generazione di dati tabulari. Analizzando 57 set di dati della suite OpenML CC18, lo studio fornisce approfondimenti sulle adattazioni strutturali dei VAE con i Trasformatori.

Risultati Chiave dello Studio

Lo studio evidenzia due conclusioni principali:

- Posizionamento dei Trasformatori: Posizionare i Trasformatori all'interno delle rappresentazioni latenti e del decodificatore crea un compromesso tra fedeltà e diversità nei dati generati.

- Similarità dei Blocchi: Si osserva una notevole similarità tra blocchi consecutivi del Trasformatore, in particolare nel decodificatore, dove la relazione input-output approssima la linearità.

Questi risultati suggeriscono che, sebbene i Trasformatori migliorino la capacità generativa dei VAE, è fondamentale un posizionamento attento per bilanciare qualità e variabilità nei dati generati.

Argomenti correlati:

📰 Fonte originale: https://arxiv.org/abs/2601.20854v1

Tutti i diritti e i crediti appartengono all'editore originale.