Dipendenza dalla dimensione dell'ensemble nei metodi di post-elaborazione del deep learning che minimizzano un punteggio (non) equo: esempi motivanti e una soluzione di prova del concetto

Immagine generata da Gemini AI

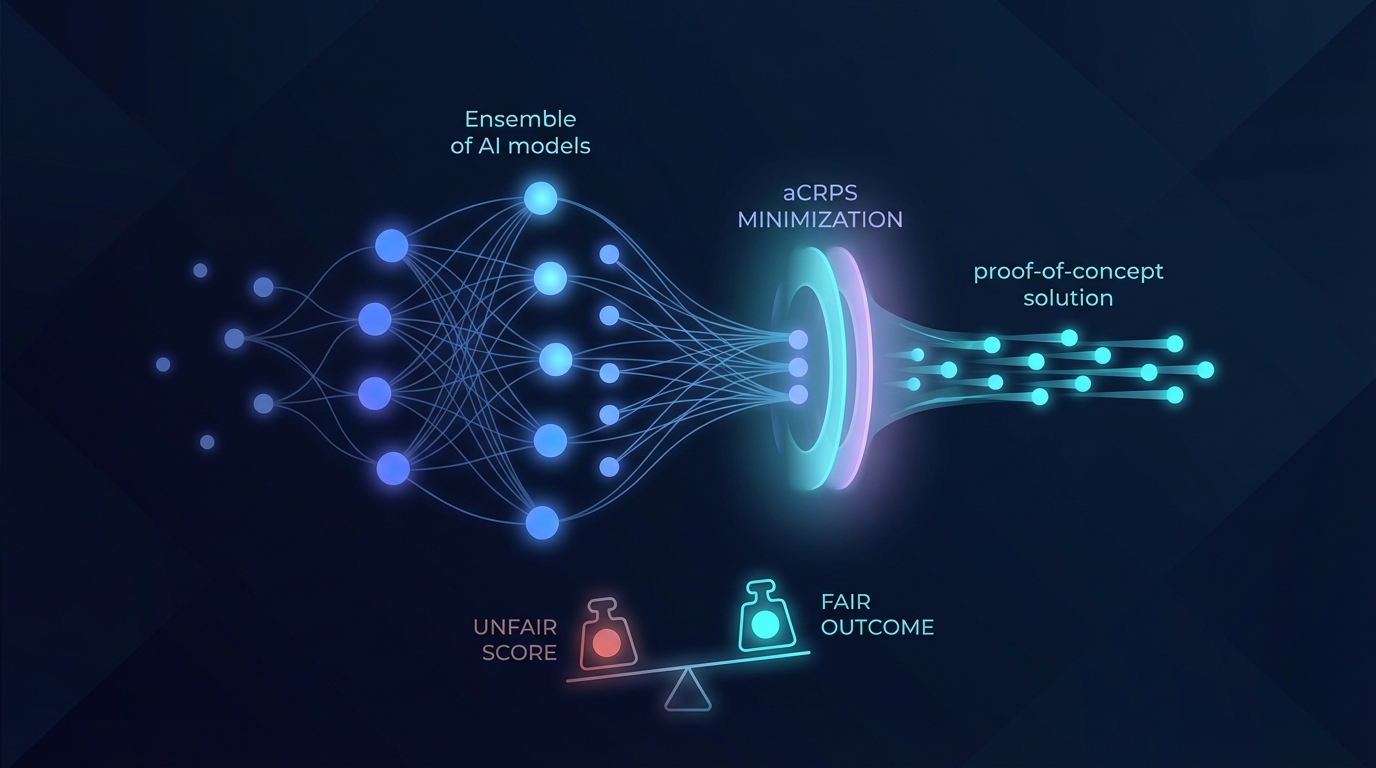

L'articolo affronta le sfide nell'utilizzo del punteggio di probabilità continua regolato (aCRPS) per l'addestramento delle previsioni in ensemble, in particolare quando si introducono dipendenze strutturali tra i membri. Vengono evidenziati due approcci problematici: la calibrazione lineare dei membri e un metodo di deep learning che può generare problemi di sovradispersione. Gli autori propongono i "trasformatori di traiettoria", adattando il framework PoET per mantenere l'indipendenza condizionale nelle previsioni. Questo metodo riduce efficacemente i bias sistematici e migliora l'affidabilità delle previsioni della temperatura media settimanale provenienti dal sistema ECMWF, indipendentemente dalle dimensioni dell'ensemble (3 contro 9 membri in fase di addestramento; 9 contro 100 in tempo reale).

Nuove Ricerche Sottolineano la Dipendenza dalla Dimensione dell'Insieme nei Metodi di Post-Elaborazione del Deep Learning

I recenti risultati rivelano che l'efficacia di alcuni metodi di post-elaborazione del deep learning nelle previsioni di ensemble può essere significativamente influenzata dalla dimensione dell'insieme. Lo studio si concentra sui punteggi equi, in particolare sull'ajustato punteggio di probabilità continua classificato (aCRPS), progettato per valutare le previsioni di ensemble senza pregiudizi riguardo alla dimensione dell'insieme.

La ricerca esamina due approcci mirati a minimizzare l'aCRPS atteso per ensemble finiti:

- Calibrazione Lineare Membro per Membro: Questo metodo collega i membri dell'ensemble attraverso una dipendenza condivisa dalla media campionaria dell'ensemble.

- Deep Learning con Auto-attenzione dei Trasformatori: Questa tecnica collega i membri dell'ensemble utilizzando meccanismi di auto-attenzione lungo la dimensione dell'ensemble.

Entrambi i metodi hanno dimostrato sensibilità alla dimensione dell'insieme, indicando che i miglioramenti nell'aCRPS potrebbero essere fuorvianti, spesso accompagnati da inaffidabilità sistematica e sovradispersione nelle previsioni.

Trasformatori di Traiettoria come Soluzione

Per affrontare questi problemi, i ricercatori hanno introdotto i trasformatori di traiettoria, un adattamento proof-of-concept del framework Post-processing Ensembles with Transformers (PoET). Questo approccio impiega auto-attenzione attraverso i tempi di guida, mantenendo l'indipendenza condizionale necessaria per le valutazioni dell'aCRPS.

Applicati alle previsioni settimanali della temperatura media a 2 metri dal sistema di previsione sub-stagionale dell'ECMWF, i trasformatori di traiettoria hanno ridotto efficacemente i bias sistematici del modello e migliorato l'affidabilità delle previsioni, indipendentemente dalla dimensione dell'ensemble utilizzata nell'addestramento.

Argomenti correlati:

📰 Fonte originale: https://arxiv.org/abs/2602.15830v1

Tutti i diritti e i crediti appartengono all'editore originale.